Мы прожили с Copilot год, и вот что из этого вышло

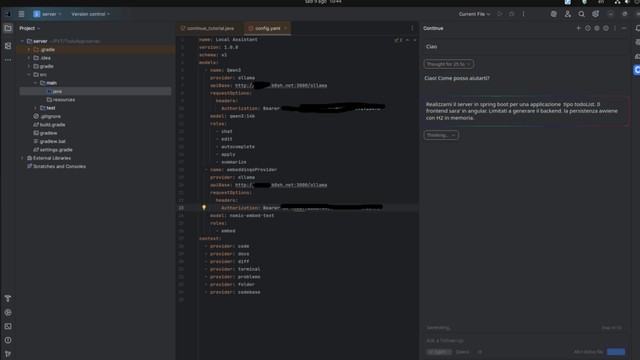

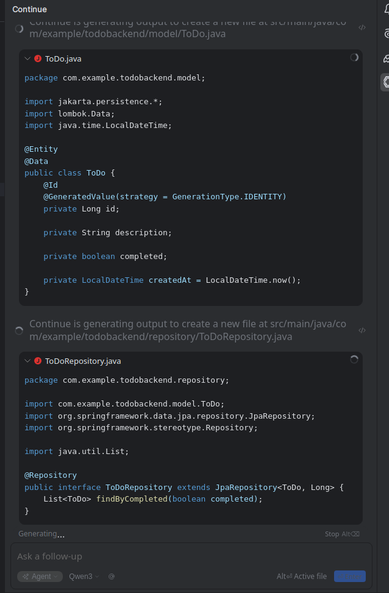

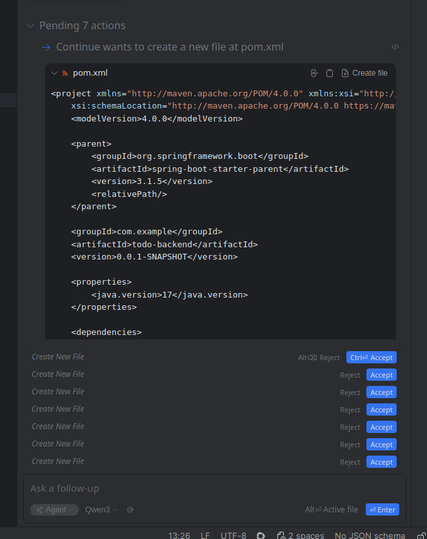

Я год экспериментировал с on-premise Copilot — прямо над нашими разработчиками, — чтобы проверить: а правда ли эта штука разгоняет разработку на десятки процентов? Делюсь реальными метриками скорости и точности, разбираю, как оно работает на примере нашей инсталляции, и показываю результаты. По пути расскажу про все подводные камни: где ИИ стал турбоускорителем, а где подставил подножку и превратился в скрытую ловушку.

#copilot #ии #ииассистент #разработка #k2_cloud #к2_облако #искусственный_интеллект #continuedev #tabbyml #refactai