bfloat16

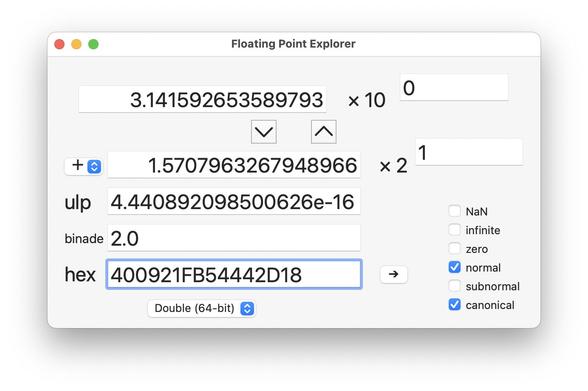

bfloat16은 구글 브레인에서 개발한 16비트 부동소수점 형식으로, 32비트 IEEE 754 단정도 부동소수점의 지수부(8비트)를 유지하면서 가수부를 8비트로 줄여 머신러닝 연산의 속도와 저장 효율을 높인다. 인텔, AMD, NVIDIA, 구글 TPU, AWS Inferentia 등 다양한 CPU, GPU, AI 가속기에서 지원하며, PyTorch, TensorFlow, CUDA 등 주요 라이브러리에서도 활용된다. bfloat16은 넓은 수치 범위를 유지하면서도 낮은 정밀도로 빠른 혼합 정밀도 연산에 적합해 AI 모델 학습과 추론에 널리 쓰인다.

https://en.wikipedia.org/wiki/Bfloat16_floating-point_format

#bfloat16 #floatingpoint #machinelearning #hardware #tensorflow