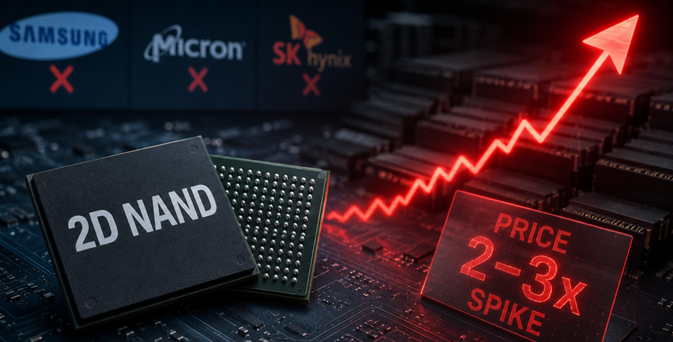

US Top News and Analysis | Seagate leads memory sell-off as CEO says it would 'take too long' to build new factories

AI generated summary, Read the full article for complete information.

Seagate’s stock fell more than 8% on Monday, sparking a broader sell‑off in the memory‑chip sector after CEO Dave Mosley told a JPMorgan conference that building new factories or adding production lines would take too long to meet the soaring demand driven by the AI boom. Mosley warned that while Seagate can offer four‑to‑five‑quarter supply visibility, the current demand far outstrips what can be produced within those timelines. The comments dragged Micron down 5% and pulled SanDisk and Western Digital around 7% lower, underscoring investor anxiety over the long lead times and limited capacity of memory makers despite a recent surge in AI‑related investment. The article also notes CME Group’s launch of a new futures market for semiconductors, aimed at helping traders hedge the rising cost of computing power.

Read more: https://www.cnbc.com/2026/05/18/seagate-memory-chip-stocks-ai.html

#Seagate #DaveMosley #JPMorgan #micron #SanDisk #WesternDigital #CMEGroup #