cocktail peanut (@cocktailpeanut)

완전 오프라인 로컬 모델이 사람처럼 사고하고 장기 기억을 다룰 수 있다는 점을 매우 인상적인 성과로 소개한다. 로컬 AI의 추론과 메모리 능력에 대한 강한 기대를 드러내는 내용이다.

cocktail peanut (@cocktailpeanut)

완전 오프라인 로컬 모델이 사람처럼 사고하고 장기 기억을 다룰 수 있다는 점을 매우 인상적인 성과로 소개한다. 로컬 AI의 추론과 메모리 능력에 대한 강한 기대를 드러내는 내용이다.

cocktail peanut (@cocktailpeanut)

DS4.c 서버와 DS4-WebUI를 터미널 없이 1클릭으로 설치·실행할 수 있는 런처가 함께 제공된다고 알린다. Pinokio를 통해 스택 전체를 쉽게 실행할 수 있으며, 최소 128GB RAM이 필요하다.

Show HN: Airplane AI – Local NDA Safe AI Powered by Gemma

Airplane AI는 완전 오프라인에서 작동하는 AI 챗 애플리케이션으로, 사용자의 데이터가 절대 외부로 전송되지 않아 GDPR 및 NDA 규정을 완벽히 준수한다. macOS 샌드박스 내에서 실행되며 네트워크 접근 권한이 없고, 모든 AI 연산은 사용자의 기기 내 CPU와 GPU에서 처리된다. 구독 없이 14일 무료 체험 후 단일 구매 방식으로 제공되며, 민감한 법률 문서, 의료 기록, 학생 데이터 등도 안전하게 처리할 수 있다. 기존 클라우드 기반 AI 서비스와 달리 데이터 유출 위험이 없고, 법무팀이나 DPO가 쉽게 검증할 수 있는 구조를 갖추고 있다.

Pietro Schirano (@skirano)

Codex 앱이 매우 개방적이라 원하는 모델을 무엇이든 실행할 수 있고 로컬 모델도 지원한다고 소개했다. Ollama를 통해 Gemma 4를 앱에서 사용하는 설정 방법도 공유했다.

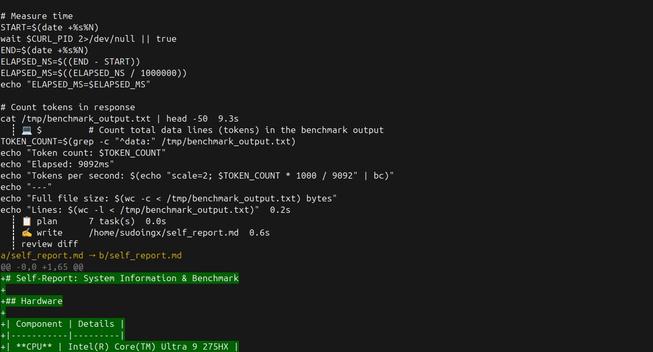

Sudo su (@sudoingX)

27B 로컬 모델이 자신의 벤치마크 보고서를 직접 작성하는 사례를 소개한다. Carnice-v2 27B가 하드웨어, 모델 파일, llama.cpp 커밋을 찾아 자기 평가를 수행하는 등 로컬 에이전트형 AI의 가능성을 보여준다.

watching a 27b local model write its own benchmark report just now and i'm sitting with this for a sec. gave carnice-v2 27b (kaios SFT on qwen 3.6 dense, trained on hermes agent traces) a self-report card task, find your hardware, find your model file, find the llama.cpp commit

Ivan Fioravanti ᯅ (@ivanfioravanti)

Qwen3.6 27B가 현재까지 가장 선호하는 로컬 모델이라고 언급했다. 로컬 환경에서 사용하는 대형 언어모델 선택에 대한 실사용 의견이다.

TestingCatalog News (@testingcatalog)

Atomic Chat을 이용해 OpenClaw를 양자화된 로컬 모델로 구동할 수 있게 됐다는 업데이트다. 설정은 다소 복잡하지만 더 큰 컨텍스트 윈도우를 활용할 수 있으며, Mac Mini와 Gemma 4, OpenClaw 조합이 언급됐다.

Khi xây dựng hệ thống giám sát & kiểm soát phiên bản AI agent, làm thế nào để quản lý tính phi xác định? Nếu lưu trữ prompt, seed, temperature và model hash thì có đủ để tạo "commit" xác thực? #AI #PhiVersioning #LocalModel #NonDeterministic #CôngNghệ #AuditTrail

https://www.reddit.com/r/LocalLLaMA/comments/1pv11fn/how_do_you_handle_versioning_nondeterministic/

Những người chạy tác nhân với mô hình cục bộ, phần nào luôn cảm thấy hacky? Đây là việc áp dụng kiến thức kinh doanh phù hợp cho mỗi khách hàng. #MôHìnhCụcBộ #TácNhân #TríTuệNhânTạo #AI #LocalModel #Agent #BusinessKnowledge #KiếnThứcKinhDoanh

Cập nhật cách cài đặt **Whisper AI** trên Windows để chuyển đổi âm thanh thành văn bản! Không cần dùng điện toán đám mây, không trả phí ứng dụng – hoàn hảo cho lập trình viên, nhà sản xuất podcast. Dữ liệu và bản ghi được bảo mật cục bộ, hỗ trợ chuyển đổi và dịch nhiều file âm thanh. Tham khảo hướng dẫn chi tiết để tự quản lý hiệu quả. #AI #SpeechToText #Privacy #LocalModel #CôngNghệAI #ĐổiText #BảoMậtDữLiệu

https://www.reddit.com/r/LocalLLaMA/comments/1p6iytz/local_whisper_model_for_speechtote