Ein Projekt-Agent, der Aufgaben erstellt und Risiken erkennt

Dieser Artikel hat besonders viele Abonnent:innen interessiert. (+)

https://t3n.de/news/oxford-professorin-unternehmen-ki-euphorie-1731036/

Dieser Artikel hat besonders viele Abonnent:innen interessiert. (+)

Windows 11 integriert KI-Agenten in Taskleiste und Suche

Ab Mai 2026 können Nutzer KI-Agenten direkt aus der Taskleiste starten und überwachen. Die Integration ist optional und steht auch Drittanbietern offen.

https://agentenlog.de/posts/2026-04-22-windows-11-ai-agent-support

Ein Github-Projekt namens „Colleague Skill“ ging viral, dessen Macher behaupten, Fähigkeiten und sogar Persönlichkeiten von Unternehmensmitarbeitern „destillieren“ und mittels KI-Agenten nachbilden zu können. (+)

Das #Digitalministerium treibt den Einsatz agentischer KI voran, auch bei sensiblen Anträgen. Doch zentrale Fragen sind ungeklärt:

Wer haftet bei Fehlern?

Wer kontrolliert die Systeme?

Und wie bleibt menschliche Prüfung gewährleistet?

#netzpolitik.org

#KI #KIAgenten #GovTech #Digitalstaat #Grundrechte #DeutschlandStack https://netzpolitik.org/2026/deutschland-stack-und-zivilgesellschaft-digitalministerium-sendet-widerspruechliche-signale/?via=nl

Deutschland-Stack und Zivilgesellschaft: Digitalministerium sendet widersprüchliche Signale

Das Digitalministerium hatte die Zivilgesellschaft aufgerufen, sich beim Deutschland-Stack einzubringen. Doch in beiden Konsultationsphasen wurde deren Expertise nicht gefragt. Dabei bringt die Zivilgesellschaft Fragen ein, die sonst untergehen. Das zeigt der Workshop zu

Meta überwacht in den USA Mausbewegungen, Klicks und Tastatureingaben seiner Mitarbeiter, um KI-Agenten für die Bedienung von Software zu trainieren.

Die Model Capability Initiative zeichnet Interaktionsdaten und Screenshots auf. Ziel ist die Entwicklung autonomer KI-Agenten. Europäische Angestellte sind aufgrund strenger Datenschutzgesetze von dieser Datenerfassung ausgenommen.

#Meta #KIAgenten #Datenschutz #KI #News

https://www.all-ai.de/news/beitrage2026/meta-leak-ueberwachung-mitarbeiter

Was aus dem KI-Versprechen von 2016 wurde #TenYearsAfter #2016

Im Juni 2016 habe ich den Beitrag „Schlauer Arbeiten – Chancen und Risiken kognitiver Lösungen am Arbeitsplatz“ geschrieben. Der Titel klingt nach Konferenz-Sprech, aber dahinter steckt eine sehr konkretes „Problem“, das mich auch heute noch „nervt“: Seitdem es E-Mail gibt, haben wir keine wirkliche Innovation beim Arbeiten gesehen. Die E-Mail-Flut wurde mehr, nicht weniger. Wir arbeiteten sie stupide sequentiell ab. Wertvolles Wissen verschimmelte in persönlichen Postfächern. Und die Unterbrechungskultur fraß die Konzentration auf.

Diese Diagnose war 2016 richtig. Und sie ist 2026 immer noch richtig. Daran hat sich erschreckend wenig geändert. Zum Beginn der Hannovermesse blicke ich zehn Jahre zurück.

Eine persönliche Einschränkung vorab, die wichtig ist: Ich bin kein Programmierer, kein ausgebildeter Wirtschaftsinformatiker. In den Maschinenraum der IT schaue ich von außen hinein – ich kann KI-Technologie nicht wirklich technisch bewerten. Was ich bin: Historiker, Journalist und Marketer. Damals war ich bei IBM mitverantwortlich für die Vermarktung bestimmter Produkte und Technologien – also durchaus Teil des Versprechens, das ich hier beschreibe. Und ich bin Endanwender, der Technologie schlicht danach bewertet, wie einfach sie zu bedienen ist und welchen konkreten Nutzen sie bringt. Aus dieser Perspektive schreibe ich hier.

Watson als Heilsversprechen – im Büro und am Krankenbett

Die Hoffnung, die wir 2016 gegen Überflutung durch E-Mails entgegen setzten, hieß IBM Watson, mehr oder weniger eine Dachmarke, ein Marketingbegriff, unter dem sich vielfältige Produkte befanden. Das Heilsversprechen war, dass kognitive Systeme, Künstliche Intelligenz die Routinearbeiten übernehmen würde: E-Mails priorisieren, Dokumente heraussuchen, Meetings anberaumen, Anfragen beantworten.

Watson sollte der persönliche Assistent werden, der dem Wissensarbeiter die Routinearbeit abnimmt, Ablenkungen minimieren wert, damit der wieder denken kann. In einem Beitrag vom Mai 2016 zitierte ich die Vision: Die digitale Revolution könne uns „zurück zu Menschen machen, die in Zusammenarbeit mit hyper-intelligenten Systemen arbeiten.“

Das größere Versprechen war aber aus meiner Sicht ein anderes: Watson werde die Krebsmedizin revolutionieren. IBM demonstrierte kognitive Systeme am MD Anderson Cancer Center und Memorial Sloan Kettering – Watson sollte Patientenakten analysieren, Behandlungsoptionen vorschlagen, Ärzte entlasten. 2017/2018 flog das Projekt beim MD Anderson spektakulär auseinander: über 60 Millionen Dollar verbrannt, und Watson hatte Behandlungsempfehlungen ausgespielt, die Onkologen als unsicher oder schlicht falsch einstuften.

Jahre später bekam ich selbst Krebs. Ich hätte mir eine bessere Früherkennung und Behandlung gewünscht. Krebsdiagnose mit Künstlicher Intelligenz war da nicht in Sicht. Als Betroffener schaue ich auf das Versprechen, KI könne bei Krebsdiagnose und -behandlung helfen, mit einer anderen Haltung als auf Fragen der Büroeffizienz. Hier geht es nicht um Komfort oder Produktivität. Hier hoffe ich als Patient, dass Patientinnen und Patienten wirklich geholfen wird – nicht als Marketingversprechen, sondern als gelebte Wirklichkeit in Klinik und Praxis.

Lars und ich planen bei #9vor9 von einer der kommenden Ausgaben auf die heutige Situation zu schauen: Was bringen ChatGPT & Co heute für meine Gesundheit. Please stay tuend.

Wer die KI-Wette gewonnen hat – und wann

Watson hat das Versprechen nicht eingelöst. Zu proprietär, zu teuer, nicht im Alltag der Menschen angekommen. Der Durchbruch von KI kam erst Jahre später – und nicht durch IBM. Im November 2022 veröffentlichte OpenAI ChatGPT. Innerhalb von Wochen hatte ein System die Massennutzung erreicht, von der Watson jahrelang geträumt hatte. Nicht als Enterprise-Lösung für Konzerne, sondern als Interface für jeden, der einen Browser hat. Anthropic Claude, Google Gemini, Meta Llama, Mistral folgten. Der Markt explodierte. Watson verschwand aus den Schlagzeilen.

Brain Fry statt einfacher Entlastung

2016 war die Hoffnung: KI nimmt mir die Routinearbeit ab, und ich kann mich auf das Wesentliche konzentrieren. Was ist tatsächlich eingetreten? Wie ich erst vor wenigen Tagen beschrieben habe: Ich nutze täglich KI-Tools – für Zusammenfassungen, Blogbeiträge, Recherchen. Entlastet fühle ich mich manchmal. Aber gleichzeitig ist ein neues Phänomen entstanden, das Forschende „Brain Fry“ nennen: mentale Erschöpfung durch permanentes Prüfen, Bewerten und Nachbessern von KI-Outputs. Prompt schreiben, Output lesen, korrigieren, neu prompten – eine Endlosschleife aus Prüfen und Entscheiden. Die KI kennt keine Pausen. Der Mensch schon – oder sollte es zumindest.

Von Assistenten zu Agenten – oder: Wer räumt hier eigentlich auf?

Und jetzt, 2026, geht die Entwicklung noch einen entscheidenden Schritt weiter. Während ChatGPT und Claude zunächst als reaktive Werkzeuge funktionierten – ich frage, die KI antwortet – versprechen KI-Agenten nun, proaktiv zu handeln. Das ist der Schritt, den Watson 2016 eigentlich gemeint hatte, den er aber nie wirklich gegangen ist.

Microsoft Copilot priorisiert heute den E-Mail-Eingang, fasst Meetings zusammen, schlägt Antworten vor. Genau das, was ich 2016 erwartet hatte – und was damals nicht kam. Bei Kyndryl, wo ich heute arbeite, ist Copilot seit 2025/2026 in Ansätzen in meinem Arbeitsalltag angekommen, Zehn Jahre nach meinem Beitrag zu „Schlauer Arbeiten“. Claude in der Cowork-Version – die ich selbst benutze – kann Dateien auf meiner Festplatte sichten, sortieren, bearbeiten, ohne dass ich jeden einzelnen Schritt manuell ausführe. Andere Agenten buchen Meetings, schreiben Code, durchsuchen Datenbanken, veröffentlichen Inhalte. Das Ziel von 2016 – die Routinearbeit verschwindet – wird greifbar.

Aber hier liegt die neue Frage, die 2016 noch nicht gestellt werden musste: Was genau tut der Agent gerade? Was hat er entschieden? Wo hat er eingegriffen? Die Entlastung durch Agenten funktioniert nur, wenn man sie im Blick behält. Wer das nicht tut, verliert nicht nur Kontrolle über einzelne Aufgaben – er verliert das Verständnis dafür, was in seinem Namen getan wird. Ein Agent, dem man zu viel Freiraum lässt, kann E-Mails beantworten, die er nicht beantworten sollte. Dateien verschieben, die man noch gebraucht hätte. Entscheidungen treffen, die eigentlich Menschen vorbehalten sind.

Die Frage lautet nicht mehr nur „Wie nutze ich KI?“, sondern „Wie behalte ich die Kontrolle über das, was KI in meinem Namen tut?“ Der Mensch muss in der Schleife bleiben. „Human in the loop“ war 2016 eine Formulierung aus der KI-Forschung. Heute ist es eine praktische Notwendigkeit für jeden, der mit Agenten arbeitet.

Die Risiken von 2016 – und was wirklich eintraf

In meinem Beitrag von 2016 habe ich zwei Risiken benannt. Das erste: Jobverlust durch KI. Diese Diskussion wird heute schärfer geführt als damals – mit mehr Evidenz auf beiden Seiten, aber noch keiner Klarheit.

Das zweite Risiko hat mich beim Wiederlesen am meisten getroffen. Ich schrieb damals: „Ich habe viel mehr Angst vor skrupellosen Menschen, die die Maschinen und Technologien gebrauchen und missbrauchen. Da liegt meiner Ansicht zumindest derzeit das viel größere Risiko.“

Das war 2016 geschrieben, lange bevor Deepfakes zur Wahlkampfwaffe wurden, bevor Desinformation durch generative KI industriell wurde, bevor Milliardäre KI-Plattformen für politische Zwecke nutzten. Der Satz klingt heute prophetisch. Und mit Agenten, die im Namen von Menschen oder Unternehmen handeln, wird die Frage noch drängender: Was passiert, wenn ein Agent nicht im Auftrag eines skrupellosen Einzelnen arbeitet, sondern im Auftrag einer Organisation, eines Staates, von TechBros, Plattformbetreibern mit puren Eigeninteressen? Die KI selbst ist nicht das Problem. Es war nie das Problem.

Wo wir 2026 stehen

Die KI ist angekommen – nicht durch Watson, sondern durch ChatGPT und seine Marktbegleiter. Die Probleme von 2016 werden heute teilweise tatsächlich durch KI adressiert. Gleichzeitig entstehen neue Abhängigkeiten, neue Risiken und eine neue Kontrollfrage, die 2016 noch nicht auf dem Radar war.

Digitale Souveränität – europäische KI, eigene Infrastruktur, Kontrolle über Daten und Modelle – war 2016 kein Thema in meinen Beiträgen. Heute ist es mein zentrales Thema. Auch das hätte ich damals nicht vorhergesagt. Dass es mit Mistral eine europäische Alternative gibt, die ernstzunehmen ist, ist kein Trost – aber ein Anfang.

Die Diagnose von 2016 stimmte. Die Therapie kam anders. Und die nächste Herausforderung – zu viel Delegation, zu wenig Kontrolle – wartet schon.

#chatgpt #Copilot #DigitaleTransformation #Digitalisierung #EMail #IBM #KI #KIAgenten #Microsoft #NewWork #WatsonClaude Mythos, und drei Monate, die Anthropic in die erste Reihe katapultiert haben #9vor9

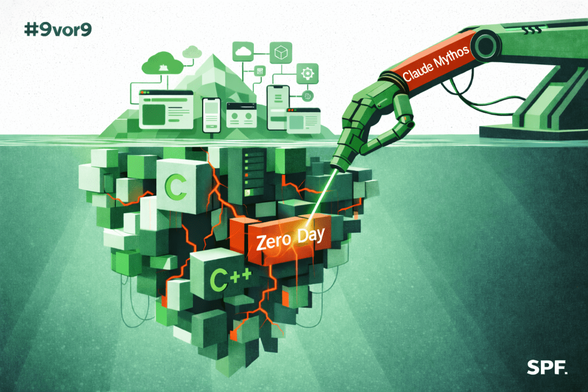

Ein KI-Modell findet automatisch Sicherheitslücken in Software, die seit 27 Jahren im Einsatz ist – Lücken, die kein menschlicher Programmierer je entdeckt hatte, vollkommen ohne menschliche Interaktion. Als der Code von Claude Mythos, dem neuen Frontier-Modell* von Anthropic, Anfang April ins Netz gelangte, war das keine Randmeldung. Claude Mythos ist genau das: ein System, das Fähigkeiten demonstriert, die bislang als ausschließlich menschlich galten. Anlass genug für Lars und mich, in Folge 206 von #9vor9 darüber zu sprechen – auch wenn wir keine Programmierer sind.

https://9vor9.podigee.io/206-anthropic-claude-mythos-aiDie Aufregung ist und war groß. Der US-Finanzminister und die führenden US-Banken, EZB, die BaFin und der deutsche Bankenverband berieten in Dringlichkeitssitzungen über systemische Cyberrisiken durch die neue KI-Generation. Anthropic hat mit Project Glasswing reagiert und das Modell einem exklusiven Konsortium aus rund 40 Partnern – darunter Apple, Microsoft, Google, JPMorganChase und die Linux Foundation – zur Verfügung gestellt, damit die „guten Akteure“ einen Vorsprung beim Schließen der Lücken bekommen. Das BSI hat Kontakt zu Anthropic aufgenommen: BSI-Präsidentin Claudia Plattner erklärte, man nehme die Ankündigungen „sehr ernst“ – die Entwicklung werfe Fragen der nationalen und europäischen Sicherheit und Souveränität auf.

Echter Alarm oder PR-Kalkül kurz vor dem Börsengang?

Dieser Tage stand dann plötzlich eine andere Frage im Raum, die Lars und ich nicht ignorieren wollten: Ist das alles womöglich ein sorgfältig inszenierter PR-Gag? Anthropic steht kurz vor dem Börsengang, mit einer Bewertung von bis zu 800 Milliarden Dollar. Die Dramatik rund um Claude Mythos – der Leak, die Dringlichkeitssitzungen, die exklusive Partnerliste – kommt zu einem verdächtig günstigen Zeitpunkt. Lars hatte die Frage gestellt, aber auch die Antwort recherchiert: Sicherheitsexperten, die daraufhin befragt wurden, sind überwiegend der Meinung, dass die Bedrohung real ist und so ernst genommen werden muss, wie sie dargestellt wird. Das schließt PR-Kalkül nicht aus. Beides kann gleichzeitig wahr sein. Und ein gutes Timing für Schlagzeilen kurz vor einem Börsengang ist in dieser Branche kein Zufall.

Von QuitGPT bis Claude Mythos: Die Ereignisse hinter dem Anthropic-Hype

Januar 2026 – Das Nutzerwachstum explodiert. Die täglich aktiven Nutzer verdreifachen sich in kürzester Zeit. Gleichzeitig wird bekannt, dass Anthropic Eingaben standardmäßig zum Modelltraining verwendet – wer das nicht will, muss aktiv widersprechen.

20. Februar – Anthropic veröffentlicht Claude Code Security als Research Preview. Das Tool findet Sicherheitslücken, die herkömmliche Werkzeuge übersehen. Die Ankündigung schickt Cybersecurity-Aktien wie CrowdStrike und Okta auf Talfahrt.

23. Februar – Ein schwarzer Tag für IBM: Nach der Vorstellung von Claude-Werkzeugen zur Modernisierung von COBOL-Systemen bricht der Kurs um über 13 Prozent ein. Der Markt sieht das Einsparpotenzial gegenüber teuren Beraterheerscharen.

26. Februar – Der Pentagon-Clash: CEO Dario Amodei lehnt einen Millionenvertrag für militärische Massenüberwachung und autonome Waffen ab. Das Pentagon setzt Anthropic daraufhin als „Risiko für die nationale Lieferkette“ auf eine Blacklist. OpenAI übernimmt den Vertrag.

Anfang März – Die QuitGPT-Bewegung erreicht ihren Höhepunkt: Über vier Millionen Nutzer kündigen bei OpenAI, nachdem dieses den Militärvertrag übernimmt. Claude stürzt ChatGPT vom Thron und wird die Nummer 1 im US App Store.

23. März – Computer Use: Claude kann nun aktiv Mauszeiger und Tastatur eines Macs steuern, um komplexe Aufgaben autonom zu erledigen.

26. März – Anthropic führt neue Usage Limits ein. In den europäischen Stoßzeiten zwischen 14 und 20 Uhr wird das Sitzungslimit deutlich schneller verbraucht.

31. März 2026 – Anthropic veröffentlichte versehentlich den kompletten Quellcode von Claude Code – dem Agentic-Tool – über das npm-Paketregister. Rund 500.000 Zeilen Code in 1.900 Dateien.

7. April – Claude Mythos wird vorgestellt. Das Frontier-Modell findet autonom eine 27 Jahre alte Lücke im OpenBSD-Kernel und erreicht bei der Exploit-Generierung für Firefox eine Erfolgsquote von 72,4 Prozent.

April (zeitgleich) – Start von Project Glasswing: Anthropic beschränkt den Zugang zu Claude Mythos auf rund 40 Partner, um Missbrauch zu begrenzen und den guten Akteuren einen Vorsprung zu verschaffen.

15. April – Berichte über eine potenzielle 800-Milliarden-Dollar-Bewertung kursieren. Anthropics jährliche Umsatz-Run-Rate überschreitet mit 30 Milliarden Dollar erstmals die von OpenAI.

16. April – EZB, BaFin und der deutsche Bankenverband beraten in Dringlichkeitssitzungen über die systemischen Cyberrisiken der neuen KI-Generation.

Oktober 2026 (geplant) – Vorbereitungen für den Börsengang konkretisieren sich.

Exploits, Zero-Days, C und C++: Warum jahrzehntealter Code zur globalen Schwachstelle wird

Wer mit den Begriffen nicht täglich umgeht, braucht hier kurz einen Anker. Ein Exploit ist ein Angriffswerkzeug: Code, der eine Sicherheitslücke gezielt ausnutzt, um in ein System einzudringen, Daten zu stehlen oder Kontrolle zu übernehmen. Zero-Days sind Lücken, die dem Hersteller noch nicht bekannt sind – und für die es deshalb noch keinen Patch gibt: null Tage Reaktionszeit, null Gegenwehr. N-Days hingegen sind Lücken, die zwar bereits bekannt und theoretisch gepatcht wurden, aber in der Praxis noch in ungezählten ungepatchten Systemen schlummern.

Warum stecken diese Lücken überhaupt in Software, die seit Jahrzehnten im Einsatz ist? 80 Prozent der kritischsten Systeme – Betriebssysteme, Virtual Machine Monitore, Browser – basieren historisch auf speicherunsicheren Sprachen wie C und C++. Das ist das Eisbergproblem der digitalen Infrastruktur: Oben sehen wir moderne Oberflächen und sauber designte Apps, darunter schlummern Millionen von Codezeilen aus einer anderen Ära, eingebettet in schiere Komplexität, nie vollständig auf Sicherheitslücken geprüft. Kein Mensch kann diesen Eisberg alleine durchtauchen. Claude Mythos tut es automatisch – und das ist sowohl die gute als auch die beunruhigende Nachricht.

Die Zeitleiste und dieser technische Hintergrund zeigen zweierlei: Anthropic ist in bemerkenswert kurzer Zeit von einem KI-Unternehmen, das Lars und ich kaum auf dem Radar hatten, zum Taktgeber einer ganzen Branche geworden. Und die Ereignisse sind kein zufälliges Rauschen – sie folgen einer Logik, die man sowohl bewundern als auch skeptisch beäugen kann.

Lars hat im Gespräch die entscheidende Vergleichsfrage gestellt: Was wäre eigentlich passiert, wenn Grok von Elon Musk oder OpenAI Claude Mythos in den Händen gehalten hätten? Seine Antwort war knapp und trocken – die würden das dann wahrscheinlich einfach online stellen und dann mal sehen, was passiert.

Der Pentagon-Clash macht den Unterschied sichtbar: CEO Dario Amodei lehnte einen Millionenvertrag für militärische Massenüberwachung und autonome Waffen ab. Das Pentagon setzte Anthropic daraufhin als „Risiko für die nationale Lieferkette“ auf eine Blacklist. OpenAI übernahm den Vertrag. Das sagt mehr als jedes Leitbild.

Wer hat Anthropic gegründet – und warum haben sie OpenAI verlassen?

Um zu verstehen, warum Anthropic so anders klingt als die Konkurrenz, lohnt ein Blick auf die Gründungsgeschichte. Dario Amodei verließ OpenAI im Dezember 2020 gemeinsam mit seiner Schwester Daniela und einer Handvoll weiterer Mitarbeiter – nicht wegen schlechter Bezahlung oder fehlender Perspektive, sondern aus echtem Dissens. Dario lehnte das Großinvestment von Microsoft in OpenAI ab und wollte KI-Sicherheit konsequenter in den Mittelpunkt stellen. Gemeinsam zogen sie mindestens neun weitere OpenAI-Mitarbeiter mit, die ihre Vision teilten. Das ist die Gründungserzählung, auf der Anthropics Anspruch basiert. Ob sie trägt, wenn Amazon, Google, Microsoft und Nvidia auf der Investorenliste stehen und ein Börsengang vor der Tür steht – das ist die eigentliche Frage.

Lars hat bei #9vor9 auch das Gründungsdokument von Anthropic zitiert: „Development of superhuman machine intelligence is probably the greatest threat to the continued existence of humanity.“ Und sofort die Folgefrage, die sitzt: Wenn Menschen, die so etwas sagen, vollkommen unreguliert arbeiten dürfen – ist das nicht genau das Problem? In den USA ist KI-Regulierung unter der aktuellen Administration kein ernstes Thema. Es gibt keine Leitplanken, keine Aufsicht mit echten Zähnen. Lars hat das klar ausgesprochen: „Ich möchte mich nicht auf das ethische Gewissen einzelner Tech Bros verlassen müssen.“ Ich auch nicht.

Autonome KI und meine Daten: Kreditkarte, Pass, Gesundheitsakte

Ich nutze Claude seit Wochen intensiv und habe meine ausführlichen Erfahrungen – von Claude Cowork über DSGVO-Realität bis zur Investorenstruktur – in einem separaten Blogbeitrag beschrieben. Mein Fazit dort war: beeindruckendes Werkzeug. Das gilt nach wie vor. Die autonomen Agenten auf dem Mac habe ich bewusst nur mit harmlosen Aufgaben erprobt – weiter werde ich auch wahrscheinlich nicht gehen, weil das dann schon ein bisschen zu spooky ist. Und dieses Unbehagen teilen Lars und ich ausdrücklich.

Denn reden wir konkret darüber, was heute technisch möglich ist: Ein autonomer KI-Agent kann Reisen buchen – und braucht dafür meine Kreditkartendaten. Er kann meine Steuererklärung vorbereiten – und braucht dafür meine Bankdaten, meine Spesenabrechnungen, meine Lohnzettel. Er kann meinen Pass scannen und verarbeiten, inklusive der biometrischen Daten, die darin stecken. Er kann meine Gesundheitsdaten lesen, um Versicherungen zu vergleichen oder Arzttermine zu buchen.

Das ist kein Science-Fiction. Das ist heute möglich. Die Frage ist nicht, ob die Technik das kann. Die Frage ist: Was passiert mit diesen Daten? An wen fließen sie weiter? Wer hat am Ende die Kontrolle – ich, oder ein System, das autonom handelt und dessen Entscheidungswege ich nicht vollständig nachvollziehen kann? Systeme, die autonom handeln, können eben auch autonom Schaden anrichten. Lars und ich sind keine Maschinenstürmer. Aber wir sind auch keine unkritischen Enthusiasten. Und das sollte man auch nicht sein.

Am Ende unseres Gesprächs hat Lars den Punkt gesetzt: „Es ist halt offensichtlich ein sehr kritischer Zeitpunkt gerade, was KI, Wirkung von KI, KI-Entwicklung angeht. Muss man jetzt auch nicht drumrum reden.“ Nein, muss man nicht. Was man aber festhalten muss: Anthropic ist kein Heilsversprechen. Amazon, Google, Microsoft und Nvidia sitzen wie erwähnt auf der Investorenliste, der Börsengang steht an.

Ist Anthropic wirklich die ethische KI-Alternative – oder Angst-Marketing vor dem Börsengang?

Die Kernfrage stellt sich weiter: Ist Anthropic die erwachsene, ethische Alternative? Oder nutzt das Unternehmen Angst-Marketing so geschickt, wie OpenAI einst Hype-Marketing betrieben hat? Die Antwort kennen wir noch nicht. Was wir kennen, sind historische Beispiele. Google hatte einmal „Don’t be evil“ als Leitspruch. Es war mehr als ein Slogan – es war ein Versprechen, das lange geglaubt wurde. Bis es leise verschwand. Beobachten wir kritisch, ob Anthropic einen anderen Weg geht.

* Frontier-Modelle sind die jeweils leistungsfähigsten KI-Systeme an der vordersten Entwicklungsfront – Modelle, die neue Maßstäbe setzen, bevor die Welt weiß, wozu sie fähig sind.

Anthropic_Disruption_(2)Herunterladen #9vor9 #allgemein #Amazon #Anthropic #books #chatgpt #Claude #CyberSecurity #DSGVO #ElonMusk #EU #Google #KI #KIAgenten #Microsoft #Trump #USA #Wirtschaft