[Перевод] Разбираем 14 самых популярных бенчмарков для LLM

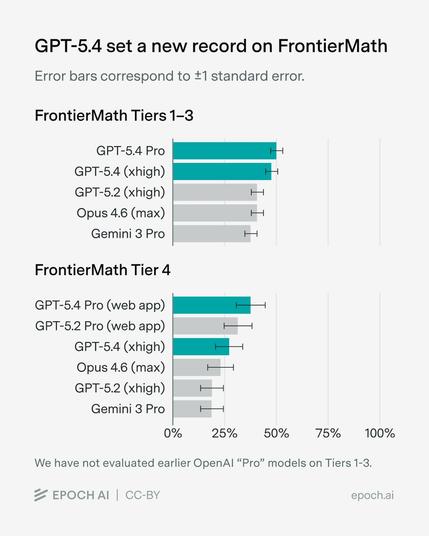

Opus 4.5 набирает 80.6% на SWE-bench Verified. Opus 4 — 72.5%. Значит ли это, что Opus 4.5 лучше программирует, чем Opus 4? Ну... возможно . Но SWE-bench Verified это не показывает. Он показывает способность модели чинить небольшие баги в 12 популярных open source Python-репозиториях, которые почти наверняка входят в её обучающие данные. SWE-bench Verified не тестирует умение ориентироваться в вашем TypeScript-монорепо, Spring Boot-приложении или самописном ORM, на котором настоял предыдущий CTO. Я написал эту статью, потому что в релизах новых моделей постоянно мелькает один и тот же набор бенчмарков — и я понятия не имел, что они означают. Пришлось прочитать статьи, код и критику. Результат: разбор 14 бенчмарков — что тестирует, как устроен, в чём критикуют, и мои собственные наблюдения.

https://habr.com/ru/articles/1017082/

#бенчмарки_LLM #SWEbench #оценка_языковых_моделей #AI_бенчмарки_2025 #TerminalBench #ARCAGI #GPQA_Diamond #FrontierMath #тестирование_ИИ #метрики_качества_LLM