Новый бенчмарк по кодингу для LLM ProgramBench: 9 топ моделей, 200 задач, 248 тысяч тестов. Полностью решённых — ноль

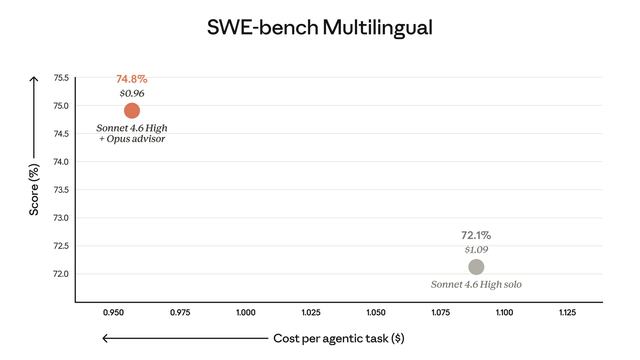

200 задач. 248 тысяч тестов. Девять моделей, среди них всё свежее: Opus 4.7, GPT 5.4, Gemini 3.1 Pro, Sonnet 4.6. На SWE-bench те же модели берут 70 % и выше. На ProgramBench — ноль полного резолва. Лучший «почти решено» у Opus 4.7 — 3 %. У остальных и того нет. Это новый бенчмарк от Meta Superintelligence Labs, Stanford и Harvard (2026). Агенту дают скомпилированный бинарь и описание программы. Никаких сорсов, никакой декомпиляции, никакого интернета. Задача — собрать программу с нуля так, чтобы она прошла 248 тысяч поведенческих тестов. Это не «пофиксить баг в существующем коде» (как SWE-bench) и не «дописать функцию по сигнатуре» (как HumanEval). Это другой ТИП задачи: спроектировать систему. Внутри — методология, паттерн результатов (что модели вытягивают, а что нет), и почему этот ноль — на самом деле важная новость для тех, кто строит на LLM продакшен.

https://habr.com/ru/articles/1035574/

#ProgramBench #бенчмарк #LLM #кодингагенты #SWEbench #vibecoding #opus_47 #GPT54

Новый бенчмарк по кодингу для LLM ProgramBench: 9 топ моделей, 200 задач, 248 тысяч тестов. Полностью решённых — ноль

200 задач. 248 тысяч поведенческих тестов. Девять моделей, среди них всё свежее на 2026 год: Opus 4.7, GPT 5.4, Gemini 3.1 Pro, Sonnet 4.6, Haiku 4.5. На SWE-bench те же модели стабильно берут 70 % и...