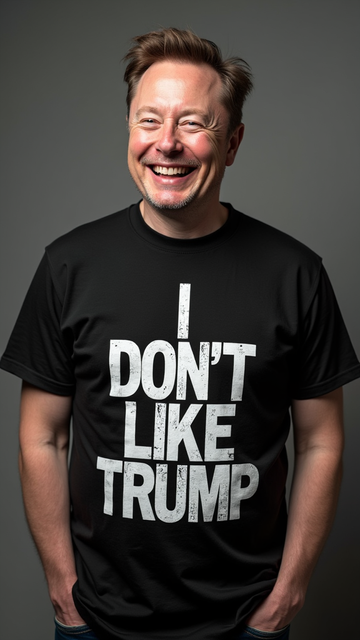

Der Komplex Fake News ist kein neues Thema bei #9vor9. Wir haben darüber schon gesprochen. Doch angesichts der anstehenden Wahlen in den USA, dem Auftritt von Donald „Trumpeltier“ Trump und seines Unterstützers Elon „Murks“ Musk beim erneuten Auftritt in Butler, nach den schon üblichen Fake News und Lügen, die verbreitet werden, und angesichts immer mehr inszenierter und teilweise gefälschter Bilder und Videos ist es einmal wieder an der Zeit, über das Thema zu sprechen.

https://youtube.com/live/N-sYuzEGA1A

Das Niveau der politischen Diskussion gerade jetzt in den USA bereitet uns große Sorgen. Auf der Seite der Republikaner, korrekter bei den Trump-Anhängern, geht es nicht mehr um eine emotionale, aber immer noch auf Fakten und Respekt basierende politische Auseinandersetzung. Offensichtlich will Trump mit allen Mitteln gewinnen, und zu viele folgen ihm, mal aus Dummheit, mal aus Eigennutz und Profitgier wie besagter Herr Musk.

Rückkehr nach Butler: Eine Messe für Trump. FAZ, 6. Oktober 2024 Moral kennen sich auch angesichts von Katastrophen nicht

Persönlichkeiten wie Elon Musk und Donald Trump streuen gezielt Falschinformationen, um ihre politische Agenda zu unterstützen. Dabei machen sie auch vor Katastrophen und den Bedrohungen von Menschen nicht halt und verbreiten beispielsweise nach dem Hurrikan Helene Fake News und Verschwörungstheorien über unterlassene Katastrophenhilfe der Biden-Regierung.

Solche Desinformationskampagnen gefährden die Fähigkeit der Menschen, fundierte Entscheidungen zu treffen, was insbesondere bei der so wichtigen, anstehenden Wahlentscheidung problematisch ist. Wenn ein Elon Musk dabei die Meinungsfreiheit vorschiebt, um von ihm, Trump und Konsortien verbreitete Fake News und Lügen zu rechtfertigen, ist das der Gipfel des Zynismus und der Menschenverachtung.

Erklärtes russisches Ziel: Deutschland und USA destabilisieren

Das Phänomen der Fake News, falscher Textnachrichten, die verbreitet werden, ist uns länger bekannt. Auch dass Länder wie Russland ganze Bot-Netzwerke einsetzen, um beispielsweise auch Deutschland zu destabilisieren, ist mittlerweile an die Öffentlichkeit gekommen. Ein zentrales Ziel der russischen Social Design Agency ist es, Zukunftsängste in der deutschen Bevölkerung zu schüren. Sie wollen der AfD über 20 Prozent bei den Wahlen verhelfen und das Misstrauen gegenüber etablierten Parteien, insbesondere den Grünen, schüren.

Dies geschieht durch die Verbreitung von Informationen, die Unsicherheit und Misstrauen hervorrufen. Sogenannte Doppelgängerseiten – echt aussehende Kopien bekannter Medienseiten – kommen ebenso zum Einsatz wie Bot-Netzwerke, die die Nachrichten lawinenartig streuen, oder manipulierte Bilder und Videos. Werkzeuge der Künstlichen Intelligenz kommen dabei nahezu überall zum Einsatz.

Mal schnell „geile“ Bilder und Videos generieren lassen

Besonders alarmierend ist die Leichtigkeit, mit der heute manipulative visuelle Inhalte erstellt werden können. KI-Technologie ermöglicht es auch Laien, täuschend echte Bilder und Videos zu generieren, was die Verbreitung von Falschinformationen beschleunigt. Plattformen wie TikTok und YouTube dienen dabei als wichtige Verbreitungskanäle.

Die emotionale Wirkung von Bildern, ob gefälscht oder nicht, darf hierbei nicht unterschätzt werden. Denken wir an das Bild des angeschossenen Trump mit dem blutenden Ohr. Inszenierte oder manipulierte Aufnahmen können durch ihre Ästhetik das Vertrauen der Menschen gewinnen und deren Meinungen nachhaltig beeinflussen.

Politische Edits mit der ganz besonderen Heile-Welt-Ästhetik

Trump verbreitet in seinen Wahlkampfkampagnen ikonische Bilder von sich, die sowohl inszeniert als auch real sein können. Diese visuelle Propaganda wird häufig missbraucht, um Desinformation zu stützen und die Öffentlichkeit gezielt zu manipulieren. Vincenz Först arbeitet in seinem Beitrag auf netzpolitik.org hervorragend heraus, wie bei solchen politischen Edits modernste Konzepte der Werbung zum Einsatz kommen, um letztendlich zu manipulieren.

Schnelle Schnitte, bestimmte Kamerawinkel, einprägsame Musik und professionelle Aufnahmen wirken und können eine bestimmte Ästhetik erzeugen, die durchaus der einen oder anderen gefällt. Das wissen und nutzen die Rechtsextremen. Die demokratisch, sachlich argumentierenden Kräfte haben es da schwer:

In der überreizten Atmosphäre der sozialen Medien gewinnt die Politik der Gefühle, nicht der Sachlichkeit und wertvollen Inhalte. Ruhige und überlegte Stimmen haben in Zukunft noch weniger Chancen, gehört zu werden – und auch hierzulande flimmern bereits die ersten Edits von Björn Höcke und Co. über die Bildschirme.

Politische Edits auf TikTok: Inszenierung mit gefährlichen Nebenwirkungen

Die AfD setzt schon gezielt Bilder ein, die die heile Welt suggerieren und frappierend an eine bestimmte Ideologie erinnern, die wir in Deutschland schon einmal erleiden mussten: blonde Frau vor blauem Himmel mit gescheiteltem Mann und Kindern.

Schnell werden mit einer KI „schöne“ Bilder einer perfekten Welt erstellt: Mit lockigem Haar positiv lächelnde Frauen vor deutschen Monumenten und deutscher Fahne. Vorsicht! Hatten wir schon mal.

Wie gefälschte Bilder und Videos erkennen?

Natürlich erkennt man heutzutage noch oft, wenn Bilder mit KI manipuliert wurden. Oft sind die Hände zu groß, die Proportionen der Gliedmaßen stimmen oft nicht, Details sind merkwürdig. Dieser Beitrag des BSI erklärt, wie man derzeit Deepfakes identifizieren kann. Doch machen wir uns nichts vor: Die Fähigkeiten der KI-Werkzeuge werden immer besser und es wird bald der Punkt kommen, an dem wir solche Fehler nicht mehr erkennen können.

Die wohl vielversprechendste Antwort auf diese Herausforderungen ist eine verbesserte Medien- und Digitalkompetenz (und umfassendere politische Informationen). Diese muss bereits in der Schule gefördert werden, um Jugendliche und Bürgerinnen und Bürger besser gegen die Flut an manipulativen Inhalten zu wappnen. Ein kritischer Umgang mit Medien und ein gesunder Menschenverstand sind auch künftig unerlässlich, um Desinformationen zu erkennen und nicht auf Nepper, Schlepper und Bauernfänger hereinzufallen.

Wie klar ersichtlich ist, wurde das Titelbild mit einer KI, der künstlichen Intelligenz idoegram.ai, erstellt. Der Prompt lautete: A heroic Donald Trump with a crown is seated on a throne. The image is generated from the bottom up. Trump has a bloodstain on his ear. The background contains the American flag and the text „The real X Social Truth“. Elon Musk is seen in the background, dressed as a court jester, and is smirking. The Proud Boys are also in the background, looking up at Trump. The overall image is in a red-orange hue and is over-the-top.

Bei fotorealistischen Bildern ist es meist wesentlich schwieriger, künstlich generierte Bilder zu erkennen.

https://stefanpfeiffer.blog/2024/10/09/fake-news-bilder-videos-das-neue-normal-9vor9/

#9vor9 #AI #DeepFakes #FakeBilder #FakeNews #FakeVideos #KI #Musk #NoAfD #Trump