cedric (@cedric_chee)

Codex v2가 5월에 출시될 예정이라는 언급이 있습니다. AI 코딩 모델/도구의 새로운 버전 예고로, 개발자들에게 매우 중요한 출시 소식입니다.

cedric (@cedric_chee)

Codex v2가 5월에 출시될 예정이라는 언급이 있습니다. AI 코딩 모델/도구의 새로운 버전 예고로, 개발자들에게 매우 중요한 출시 소식입니다.

Abhishek Yadav (@abhishek__AI)

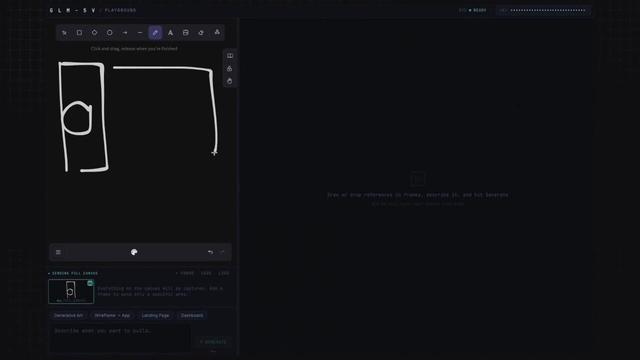

Zhipu AI가 이미지, 영상, UI 상태를 실제 코드로 변환하는 멀티모달 코딩 모델 GLM 5V Turbo를 공개했다. CogViT와 MTP 기반이며, 에이전트 실행, 20만 컨텍스트, 12.8만 출력 지원으로 Claude Code 및 OpenClaw용으로 설계됐다.

🚨 Zhipu AI just dropped a multimodal coding beast. GLM 5V Turbo converts images, videos & UI states into real code. → Built with CogViT + MTP → Executes actions via agents → 200K context + 128K output → Reads screenshots, docs, videos Built for Claude Code & OpenClaw

Cerebras (@cerebras)

GLM 4.7은 강력한 오픈소스 코딩 모델 중 하나이지만 많은 개발자가 올바르게 프롬프트하지 못한다는 지적과 함께, 모델 활용을 극대화하기 위한 10가지 규칙을 제시합니다. 예시로 지시를 앞부분에 배치(강한 최신성 편향)하고, 'must' 같은 확고한 표현을 사용하는 방법 등을 권장하고 있습니다.

GLM 4.7 is one of the strongest open-source coding models available—but most developers aren't prompting it correctly. We put together 10 rules to help you get the most out of it: - Front-load instructions (it has a strong recency bias) - Use firm language: "must" and

Chủ sở hữu DGX Spark tìm kiếm mô hình mã hóa tốt nhất để chạy cục bộ, cần một bản sao lưu mã hóa đáng tin cậy #LLM #MôHìnhMãHóa #DGXSpark #ClaudeOpus #MáyTínhCụcBộ #BảnSaoLưu #CodingModel #LocalLLM #MôHìnhTríTuệNhânTạo

https://www.reddit.com/r/LocalLLaMA/comments/1q8mq0u/new_to_local_llms_dgx_spark_owner_looking_for/

cto.new (@ctodotnew)

glm-4.7이 공식적으로 'frontier coding model'로 언급되었으며, 그 주장에 대해 unbenchmaxxable 벤치마크가 근거로 제시된다는 내용의 트윗입니다.

Mô hình lập trình vibe đang hot tháng 10/2025:

- Google Gemini 2.5 Pro cho trải nghiệm tích cực.

- Qwen Code, Ollama (cập nhật 5 tháng trước), Germma3n là những cái tên đáng chú ý.

- Cá nhân dùng Macbook Pro M5, RAM 28GB; Intel Core Ultra 7 265k, 5070 TI 16GB.

Trước khi dùng gói trả phí của Claude Code/GPT Code, hãy thử trên máy mình.

#LapTrinhVibe #CodingModel #GoogleGemini #QwenCode #Ollama #Gemma3n #MacbookPro #IntelCoreUltra7

🔥🖥️🌐

Tìm mô hình agentic coding phù hợp với Mac M1 Max 32GB. Người dùng sử dụng Opencode + llama.cpp + gpt-oss-20b nhưng gặp lỗi useless do bộ nhớ kém. Request-pyizm ALLLLL, miễn Kao suggested model & tip optimize setup. #AppleM1Max #CodingModel #LLM #MacSetup #TechHelp #MáyÁpM1Max #CôngNg Repubblica #LLM #BànLàmrical #ThôngSốHviso