Keine Halluzinationen, keine Fake News: Eine Anleitung, um mit KI online zu recherchieren

Wie bringt man ein Sprachmodell dazu, eine verlässliche und brauchbare Antwort zu liefern?

1) Die blinden Flecken der KI kennen

Wichtig ist als Erstes natürlich die Abschätzung, ob die künstliche Intelligenz die richtige Anlaufstelle ist. Die Masse an Informationen, die den grossen Sprachmodellen zur Verfügung steht, ist gigantisch. Trotzdem ist sie endlich – und es existieren riesige dunkle Flecken. Also, machen wir uns als Erstes bewusst, wo die schlecht erschlossenen Bereiche liegen:

Analoge und abgeschottete Inhalte

Viel wertvolles Wissen liegt hinter einer Bezahlschranke oder war nie online: Ältere Zeitungen, Firmeninterna, historische Dokumente.Aktuelles und ungefestigtes Wissen

An der «blutigen Kante» schneidet man sich leicht, wenn man sich auf die KI verlässt. Über laufende Entwicklungen weiss die KI oft nicht Bescheid; die Modelle ohne Webzugang haben einen eingefrorenen Wissensstand.Regionale und sprachliche Randbereiche

Alle die Bereiche, die im Web nicht gut erschlossen sind, entziehen sich oft auch den Sprachmodellen: kleinräumige Gebiete, Dialekte, lokale Kontexte und Milieus. Umgekehrt ist Englisch massiv überrepräsentiert.Implizites Erfahrungswissen

Man spricht auch von tacit knowledge oder implizitem Wissen. Man – also Mensch – «weiss es einfach», ohne dass man es irgendwo nachschlagen müsste.Privates und Persönliches

Nicht über jede Person steht etwas im Internet. Ausserdem haben Sprachmodelle notorisch Mühe, damit zu verstehen, dass man Personen anhand des Namens nicht eindeutig unterscheiden kann, besonders, wenn sie Paul Meier oder John Miller heissen.Verzerrte oder einseitige Datenräume

In manchen Wissensbereichen finden starke Beeinflussungsversuche durch PR, politische Parteien, Lobbyisten statt, die sich zu Informationskriegen auswachsen können. Welchen Einfluss die Versuche aufs Informationsangebot im Web haben, Suchmaschinen zu optimieren bzw. zu manipulieren, dokumentiere ich laufend hier im Blog. Im Bereich der KI nennt man das LLM-Grooming oder AI grooming.Sprachlich schwer erfassbare Sachverhalte

Nicht alle Dinge lassen sich gut in Worte fassen. Akustische, haptische oder sensorische Eindrücke, Gefühle, Schmerz und Ähnliches. Natürlich kann die KI solche Dinge anhand der Informationen abbilden, die im Netz darüber geschrieben wurden. Aber hier wird besonders klar, dass es sich immer um Eindrücke aus dritter Hand handelt.Wenn wir uns dieser Grenzen bewusst sind, reduzieren wir das Risiko deutlich, auf Halbwissen hereinzufallen, das uns ein Sprachmodell im Brustton der Überzeugung präsentiert.

2) Explizit Qualität einfordern

Überdies hilft es, beim Prompt explizit eine Antwort anhand seriöser, fundierter Informationen einzufordern. Das hilft besonders, wenn die Websuche zum Zug kommt: Bei Informationen, die auf diesem Weg in die Antwort einfliessen, kann die KI eine Quellenkritik vornehmen – wobei an dieser Stelle noch einmal explizit darauf hingewiesen sei, dass diese Disziplin keine Stärke der Sprachmodelle ist. Die KIs neigen dazu, einen Reddit-Post genauso verlässlich zu halten wie das Paper einer grossen Universität.

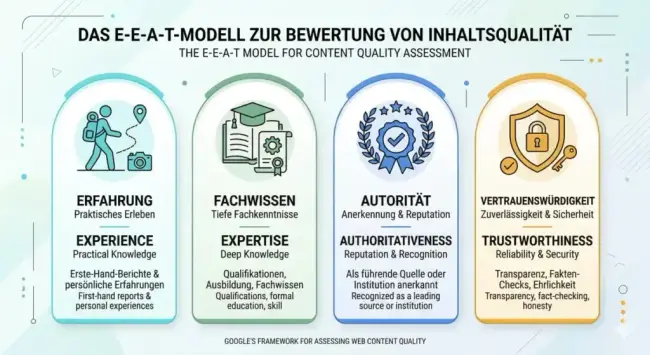

Mein Tipp jedenfalls ist, beim E-E-A-T-Modell anzusetzen. Das stammt von Google und wird zur qualitativen Bewertung von Suchresultaten herangezogen (wenngleich mit durchwachsenen Resultaten).

Ich gebe es zu: Diese Infografik habe ich nicht selbst gezeichnet, sondern von Gemini fabrizieren lassen.

Trotzdem: Es lohnt sich, das Modell zu kennen und beim Prompten zu berücksichtigen. Dabei hilft diese Übersicht, die die Bedeutung der Buchstaben erklärt und zeigt, wie man sie bei Suchen verwendet:

- Experience – Erfahrung

«Suche nach Berichten aus erster Hand (Foren, Rezensionen, Fallstudien)» - Expertise – Fachwissen

«Bevorzuge Quellen von Leuten mit nachgewiesener Qualifikation.» Oder: «Beschränke dich auf journalistische Medien mit einem einwandfreien Leumund und auf wissenschaftliche Inhalte.» - Authoritativeness – Autorität

«Verwende die Quellen der ersten Wahl (offizielle Institutionen, Marktführer, Standardwerke.» - Trustworthiness – Verlässlichkeit

«Achte darauf, dass Fakten gut abgestützt sind, sowie auf Transparenz und inhaltliche Verifikation. Keine Fake News, keine interessensgesteuerten Inhalte!»

Beispiele aus der Praxis

Mit diesen Kenntnissen im Hintergrund formulieren wir unsere Prompts konkret und eindeutig. Für eine aktuelle Recherche, die auf journalistischen Informationen basiert, verlangen wir etwa:

Analysiere die aktuelle politische Lage im Iran. Nutze für die Websuche ausschliesslich überregionale Qualitätsmedien mit hohen journalistischen Standards (wie Reuters, AP, «Die Zeit», «Tagesanzeiger», «Spiegel» und «New York Times»). Schliesse Boulevardmedien und Medien mit einer klaren politischen Ausrichtung aus.

Wenn wir den Stand der Dinge aus wissenschaftlicher Sicht herausfinden möchten, ist das ein guter Prompt:

Erkläre den aktuellen Stand der Forschung zur CRISPR/Cas-Methode. Beschränke deine Suche auf akademische Datenbanken wie Google Scholar, Researchgate oder Universitäts-Domains (.edu, .ac.at, .ch). Bevorzuge Peer-Review-Studien und zitiere die wichtigsten Autoren mit ihrer Institution.

Abseits der traditionellen Medien lässt es sich wunderbar recherchieren, insbesondere zu Themen, die für einen Titel mit einem breiten Publikum zu fachspezifisch und nischig wären. Hier formuliere ich z.B. so:

Fasse die Trends bei den agentischen Browsern zusammen. Suche gezielt nach Analysen von anerkannten Branchen-Experten und bekannten Fach-Blogs (z.B. Wired, Techcrunch, zuverlässigen Blogs wie Clickomania.ch oder substanzielle Substack-Newsletter von Fachleuten). Ignoriere generische SEO-Artikel von Firmenwebseiten.

Schliesslich hielte ich es für falsch, den riesigen Bereich des User Generated Content von vornherein auszuschliessen. Denn manche Informationen gibt es nur dort. Aber auch hier erleichtert man sich das Leben mit der richtigen Vorgabe:

Ich brauche Hilfe, um bei meinem Raspberry Pi eine exFAT-formatierte Festplatte zu mounten. Suche nach Lösungen in spezialisierten Experten-Communitys (z. B. Stack Overflow, Github Issues, spezifische Subreddits mit hoher Upvote-Rate). Gewichte Antworten höher, die von verifizierten Experten oder Nutzern mit hoher Reputation innerhalb der Community stammen.

3) Die KI zur Selbstreflexion bewegen

Und ja, bei einer KI von Selbstreflexion zu reden, ist eine unzulässige Anthropomorphisierung. Aber ihr versteht, was ich meine. Wir können eine Auskunft auch nachträglich überprüfen, indem wir das E-E-A-T-Prinzip explizit ins Spiel bringen:

Bewerte die oben genannten Quellen nach dem E-E-A-T-Prinzip. Warum hast du diese Quellen als vertrauenswürdig eingestuft?

Falls ihr einen Lieblingsprompt zur Quellenauswahl habt, freue ich mich, wenn ihr mir den via Kommentare zukommen lasst!

Beitragsbild: Das hilft bei der Recherche: Genau hinschauen bei den Quellen und die Ergebnisse fein säuberlich dokumentieren (Dan Dimmock, Unsplash-Lizenz).

#ChatGPT #KI #KIQuicktipp #LLMs #Suchmaschine