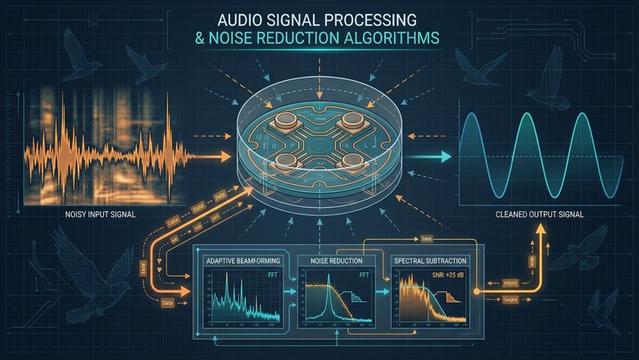

Тестирование алгоритмов шумоподавления для сложных акустических условиях

Распознавание речи в реальных условиях представляет собой одну из наиболее сложных задач в области обработки сигналов. Особенно актуальна эта проблема для роботов, которые должны функционировать в разнообразных зашумленных условиях: в толпе людей, на открытом воздухе при сильном ветре, в помещениях с высоким уровнем фонового шума. Традиционные алгоритмы шумоподавления, разработанные для стационарных условий, оказываются неэффективными в таких сценариях. В данной статье описывается исследовательский проект по разработке и оптимизации алгоритмов цифровой обработки сигналов для обеспечения надежного распознавания речи в экстремальных акустических условиях. В качестве тестовой платформы использована система автоматического распознавания птиц на базе BirdNET-Go, что позволило проводить длительные полевые испытания в естественных условиях с разнообразными типами шумов. Ключевой задачей проекта был подбор оптимальных алгоритмов фильтрации и их параметров для работы с нестационарным шумом. В процессе исследования были реализованы и протестированы различные подходы к шумоподавлению, включая спектральное вычитание, адаптивные фильтры и алгоритмы на основе минимальной среднеквадратичной ошибки. Особое внимание уделено алгоритму Log-MMSE (Minimum Mean-Square Error Log-Spectral Amplitude Estimator), который показал наилучшие результаты в условиях нестационарного шума. Выбор птиц в качестве тестового объекта был неслучаен: вокализация врановых (ворон, сойка, сорока, галка, грач) по своим частотным характеристикам близка к человеческой речи, что делает их идеальной моделью для отработки алгоритмов, предназначенных для роботов. Длительные полевые записи в различных погодных условиях позволили собрать обширную базу данных для анализа эффективности различных подходов к шумоподавлению. Полетели послушаем

https://habr.com/ru/articles/1006084/

#birdnet #docker #stt #microphone