Почему текст от LLM узнаётся за пять секунд: разбираю стилистические маркеры через архитектуру моделей

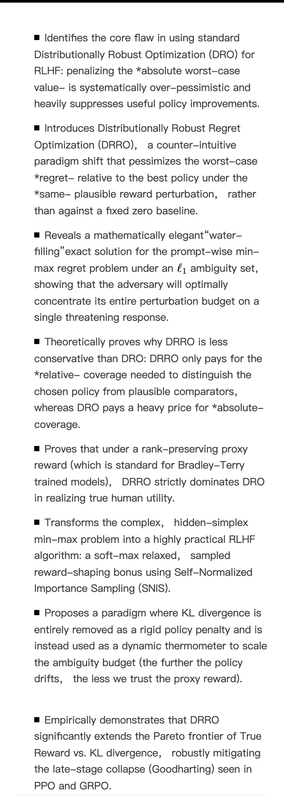

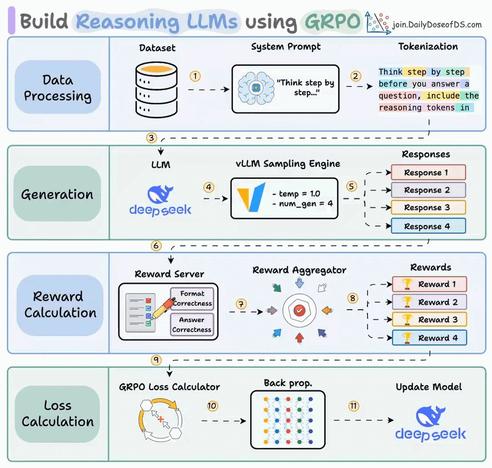

Когда мы интегрируем LLM в продакшн, рано или поздно сталкиваемся с одной и той же проблемой: текст модели читаем, грамотен, и при этом видно, что его написала модель. В статье разбираю десять самых выразительных стилистических маркеров на уровне архитектуры — почему они появляются (вопрос статистики обучающего корпуса и пост-тренинга, не случайность) и что с ними делать на уровне промпта, sampling-параметров и постобработки. Плюс короткое отступление про то, почему “промпты для обхода детектора” не работают и где лежит реальная граница между генерацией и авторским текстом.

https://habr.com/ru/articles/1033450/

#LLM #GPT #Claude #sampling #temperature #prompt_engineering #постобработка #детекция_ИИтекста #RLHF

Почему текст от LLM узнаётся за пять секунд: разбираю стилистические маркеры через архитектуру моделей

Технический взгляд на то, почему GPT, Claude и Gemini генерируют похожий «средний» текст, и как с этим работать в продакшене Когда мы интегрируем LLM в продакшн — будь то генерация описаний товаров,...