Hat Tiktok unsere Jugend verdummt?

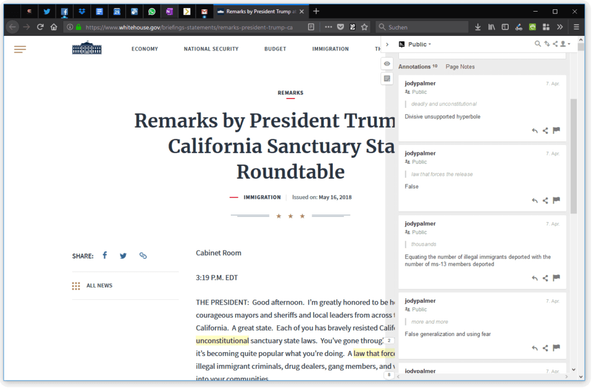

Neulich hatte ich die Gelegenheit, dem führenden Manager einer grossen deutschen Verlagsgruppe zuzuhören. Er konstatierte, das freie Web sei tot. Nur die grossen Plattformen hätten überlebt. Und die würden die Besucherinnen und Besucher mit allen Mitteln auf der eigenen Plattform behalten – und dafür sorgen, dass die kleinen Informationsquellen verkümmern.

Das deckt sich mit meinen Beobachtungen, die ich vor zwei Jahren darlegte und dieses Jahr allgemein und anhand meines eigenen Blogs belegte und im Nerdfunk diskutierte (hier und hier). Der Mann sagte noch zwei weitere Dinge, über die es sich nachzudenken lohnt:

Die erste These scheint sofort plausibel. Daraus ergibt sich der Schluss, dass auch die zweite Annahme vernünftig ist: Wenn die Entwicklung so eindeutig in eine Richtung verläuft, dann gilt es, sich auf das Unvermeidliche vorzubereiten. So unerfreulich es auch sein mag.

Sind etwa Eigeninteressen im Spiel?

Was mich angeht, gebe ich das freie Web so schnell nicht verloren. Und könnten wir den Sachverhalt nicht auch umgekehrt deuten? Es wäre genauso möglich, dass der Vertreter eines grossen Medienhauses die Chance wittert, die Mechanismen der Tech-Giganten zu kopieren. Da ein solches Verhalten nicht überall auf Wohlwollen stösst, käme es ihm natürlich gelegen, wenn er das als Unvermeidbarkeit darstellen könnte.

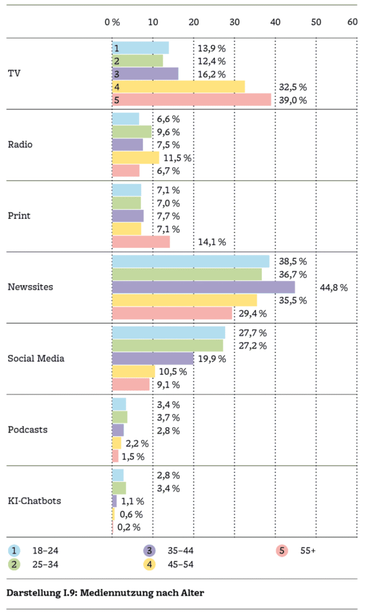

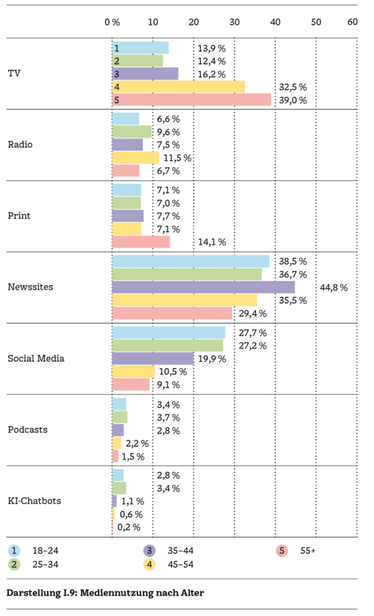

Ich gehöre zu den 2,2 Prozent der alten Säcke, die Podcasts hören.Sehen wir uns den Stand des Irrtums zu diesem Thema an: Studien zeigen sogleich, dass die Sache (wie üblich) etwas komplizierter ist¹. Wir sollten «die Jungen» nicht über einen Kamm scheren². Die diesjährige und selbst im Ausland diskutierte Studie des Forschungszentrums Öffentlichkeit und Gesellschaft (Fög) der Universität Zürich zur Qualität der Medien (hier das PDF) legt dar, dass die sogenannte News-Deprivation kein reines Problem der Jugendlichen ist:

Die sozialen Medien sind in den beiden unteren Altersgruppen (18 bis 24 und 25 bis 34) zwar deutlich häufiger vertreten als bei den älteren drei. Doch bei den News-Websites ist das Bild einheitlich. Die Gruppe der 35- bis 44-Jährigen befindet sich an der Spitze. Zur Entwicklung über die Zeit belegt die Studie eine Entwicklung über alle Generationen hinweg:

Soziale Medien gewinnen im Verhältnis zu anderen Kanälen weiter an Bedeutung (15,3 Prozent; +1,9 PP) und sind für immer mehr Menschen die Hauptinformationsquelle.

Auch das gemeinnützige American Press Institute ist nicht so fatalistisch wie der Vertreter des grossen deutschen Medienhauses. API kommt zum Schluss, dass sich die Generation Z und die Millennials durchaus für Nachrichten interessieren (79 Prozent). Sie verwenden eine Vielzahl von Quellen, auch traditionelle nationale und lokale Nachrichtenmedien wie Zeitungen, Fernsehnachrichtensender, deren Websites und Apps. Daneben kommen Facebook, Youtube, Instagram, Tiktok, Snapchat, Twitter, Reddit, Linkedin, Twitch und Nextdoor zum Zug.

Kein Grund, das freie Web bereits verloren zu geben

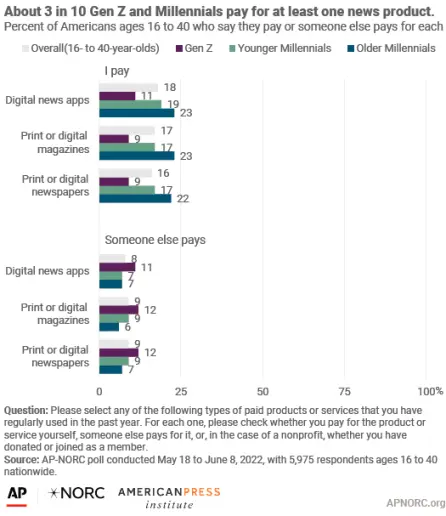

Diese Studie betrachtet die Altersgruppen zwischen 16 und vierzig und benennt die folgenden Unterschiede:

Ältere Millennials verlassen sich eher auf traditionelle Nachrichtenquellen als jüngere Millennials und die Generation Z. 44 Prozent der Generation Z geben an, niemals Nachrichten und Informationen aus traditionellen Quellen zu beziehen, verglichen mit 35 Prozent der jüngeren Millennials und 31 Prozent der älteren Millennials.

Hey, die Jungen zahlen sogar für Medien!Es gibt eine gewisse Verschiebung bei den Gewohnheiten. Die sind jedoch nicht so gross, dass wir dem freien Web bereits das Totenglöckchen läuten sollten. Insbesondere, weil diese Studie einen interessanten Aspekt beleuchtet. Sie unterscheidet Leute, die aktiv nach Informationen suchen (Seekers) von den Personen, die Informationen konsumieren, wenn sie ihnen begegnen (Bumpers). Und zu diesen beiden Gruppen hält das API fest:

Wir stellen fest, dass sich die Mischung aus Bumpers und Seekers unter der Generation Z und den Millennials in den letzten sieben Jahren trotz der zunehmenden Verbreitung von Social-Media-Plattformen nicht verändert hat.

Nicht einmal bei der Bereitschaft, für Medien zu zahlen, erkennt diese Studie eine Abnahme. Zugegeben, sie ist bereits drei Jahre alt, und in dieser Zeit dürfte die «Tiktokisierung» weiter fortgeschritten sein.

Fallen wir nicht auf unsere eigenen Vorurteile herein

Trotzdem. Die polemische Eingangsthese dürfen wir als widerlegt betrachten. Sie lebt davon, dass viele der Älteren unter uns sie noch so gerne glauben würden. Sie bedient das jahrhundertealte Vorurteil, dass die «Jugend von heute» das letzte sei und nicht zu schätzen wisse, was vorherige Generationen für sie aufgebaut haben. Es handelt sich um eine Ausprägung des derzeit so beliebten Generationen-Bashing, bei dem meistens die Gen Z schlecht wegkommt (sodass die Boomer etwas weniger dran glauben müssen).

Für mich zeigen diese Studien, dass die jungen Nutzerinnen und Nutzer Respekt dafür verdienen, mit einer so reichhaltigen und komplexen Angebotslage differenziert umzugehen. Wenn sie häufiger als gewollt bei Tiktok hängenbleiben, sollten wir ihnen das verzeihen. Uns Alten geht es oft genauso. Ausgenutzt werden wir von Mark Zuckerberg, Google, Meta und Elon Musk nicht, weil wir jung sind – sondern wegen unserer menschlichen Schwächen.

Die Disruption wurde abbestellt

Also: Es ist sinnlos, in einem passiv-aggressiven Akt die ganze Medienlandschaft umzupflügen, um hinterher der Generation Z und den Millennials die Schuld dafür zu geben, dass jetzt alles so beschissen ist.

Im Gegenteil: Wir sollten an die Stärken der unabhängigen Medien und der Informationsvielfalt glauben: Das ist der einzig vernünftige Widerstand gegen die Einfalt in den sozialen Medien. Es ist der Grund, weswegen ich stur weiter blogge – demnächst im 19. Jahr.

Abschliessend: Ich bin voll dafür, die Gen Z für mündig zu halten. Sie kann und wird gute Entscheidungen treffen. Als Journalistin und als Blogger haben wir keine andere Wahl. Denn wenn wir unser Publikum für ignorant, News-Fast-Food-süchtig und von Algorithmen ferngesteuert halten, können wir unseren Job genausogut an den Nagel hängen.

Fussnoten

1) Eine Untersuchung des Meinungsforschungsinstituts Pew Research Center von 2025 beleuchtet die Situation für die USA und konstatiert Unterschiede nach diversen demografischen Faktoren:

Frauen beziehen Nachrichten eher regelmässig über Facebook, Instagram und TikTok, während Männer Youtube, X und Reddit als Quellen angeben. Jüngere Menschen sind eher regelmässige Nachrichtenkonsumenten auf Tiktok, Instagram, Reddit und X. Schwarze, hispanische und asiatische Amerikaner beziehen Nachrichten eher von Youtube, Instagram und Whatsapp als weisse Amerikaner. Darüber hinaus beziehen Personen ohne Hochschulabschluss eher Nachrichten von Facebook und Tiktok als Personen mit Hochschulabschluss. ↩

2) Die «Always on»-Studie der Fachhochschule Nordwestschweiz (FHNW) von 2019 zeigt eine gewisse Präferenz für soziale Netzwerke, Videoportale, Streamingdienste und Onlinespiele, vergleicht aber nur Jugendliche untereinander. In dieser Alterskohorte lassen sich Unterschiede naturgemäss damit erklären, dass sich ein 16-Jähriger für andere Dinge interessiert als eine 23-Jährige. Ausserdem ist die Studie sechs Jahre alt, was uns vermuten lässt, dass z. B. die heutige Bedeutung von Tiktok nicht adäquat abgebildet ist. ↩

Beitragsbild: Immer am Handy, nur noch soziale Medien? Ganz so schlimm ist es nicht (Karola G, Pexels-Lizenz).