fly51fly (@fly51fly)

롱컨텍스트 적응을 위한 새로운 연구로, RoPE를 변형한 self-distillation 방식인 'Shuffle the Context'를 제안합니다. 긴 문맥을 더 잘 처리하도록 LLM을 적응시키는 기술로, 장문 추론·문서 이해 성능 개선에 의미가 있습니다.

fly51fly (@fly51fly)

롱컨텍스트 적응을 위한 새로운 연구로, RoPE를 변형한 self-distillation 방식인 'Shuffle the Context'를 제안합니다. 긴 문맥을 더 잘 처리하도록 LLM을 적응시키는 기술로, 장문 추론·문서 이해 성능 개선에 의미가 있습니다.

Omar Khattab (@lateinteraction)

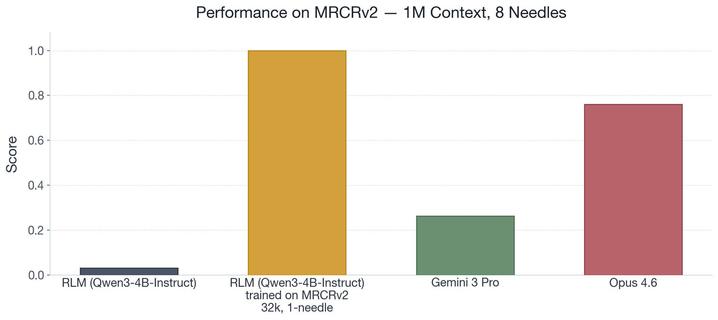

@a1zhang의 새 블로그가 언어 모델의 미래를 다루며, RLM-Qwen3-4B에 대해 32k 토큰의 쉬운 장문맥 과제로 GRPO를 학습해도 1M 토큰, 8-needle 장문맥 작업으로 자동 일반화되고 100% 신뢰도로 동작한다는 결과가 핵심으로 소개됐다.

New must-read blog by @a1zhang on the future of language models. Buried nugget: doing GRPO for RLM-Qwen3-4B on short (32k token) and easy (single-needle) MRCRv2 long-context tasks generalizes *automatically* and with perfect (100%) reliability to 1M-token, 8-needle tasks!!

cedric (@cedric_chee)

GLM-5.1은 에이전트형 작업에서 훨씬 더 긴 작업 흐름을 안정적으로 수행하도록 설계된 새 모델이다. 8시간 이상 Linux 데스크톱 구축, 600회 이상 반복한 벡터 DB 최적화, 1,000회 이상 턴이 이어진 ML 워크로드 최적화 데모가 공개되어 장기 추론·에이전트 성능 개선을 강조한다.

Prince Canuma (@Prince_Canuma)

Gemma 4 31B를 MLX에서 TurboQuant KV cache로 구동해 128K 컨텍스트에서 KV 메모리를 크게 줄이면서 품질은 유지했다고 공유했습니다. 긴 컨텍스트 추론의 메모리 효율을 높이는 흥미로운 기술 개선 사례입니다.

Omar Sanseviero (@osanseviero)

새 모델이 성능 대비 크기 효율이 매우 뛰어나다고 소개하며, 지난 12개월간의 피드백을 반영해 추론 능력, 멀티모달 이해(OCR·음성 인식·객체 탐지), 긴 컨텍스트, 에이전트 기능 등을 크게 강화했다고 밝혔습니다. 구체적 모델명은 없지만 기술 업데이트 성격이 강합니다.

The team cooked a super impressive model, specially for the sizes! We've incorporated all the feedback from the last 12 months: thinking, expanded multimodal understanding (OCR, speech recognition, object detection), longer context, agentic, and more! https://t.co/llozjYtrkJ

Qwen 3.6 Plus just dropped and almost nobody is talking about how crazy this is.

It is free right now.

1M token context.

Strong reasoning.

Better coding.

Built for AI agents.

That means you can use it for things like:

Research agents

Content workflows

Front-end builds

Multi-step automations

The wild part is this is not some toy demo.

It is ...

Qwen 3.6 Plus just dropped and almost nobody is talking about how crazy this is. It is free right now. 1M token context. Strong reasoning. Better coding. Built for AI agents. That means you can use it for things like: Research agents Content workflows Front-end builds

Anthony Morris ツ (@amorriscode)

Opus 4.6 버전이 데스크톱의 Max/Teams/Enterprise 요금제에 대해 1M(100만) 문맥(context) 지원으로 출시되었다는 공지로, 매우 큰 문맥 창을 제공하는 업데이트임을 알림.

AI Leaks and News (@AILeaksAndNews)

Anthropic가 Claude Opus 4.6과 Claude Sonnet 4.6 모델에 대해 1백만 토큰(약 75만 단어) 규모의 컨텍스트 윈도우를 일반 사용자 대상로 공개했습니다. 이제 모든 사용자가 대규모 문맥을 활용해 긴 문서 이해, 코드베이스 분석, 복합 질의 처리 등 장문 입력 기반 응용을 구현할 수 있습니다. 무엇을 할지 활용 사례가 주목됩니다.

Mark Gadala-Maria (@markgadala)

Claude가 1백만 토큰 규모의 컨텍스트 창을 지원해 컨텍스트 길이 문제를 사실상 무의미하게 만들었다고 발표했습니다. 전체 코드베이스, 6개월치 이메일, 전체 법률 사건 파일, 책 등을 한 번의 프롬프트로 넣을 수 있으며 청킹, RAG, 별도 검색 계층 없이 일반 이용 가능하다고 적시되어 있는 매우 큰 장기 컨텍스트 기능 확장 소식입니다.

TestingCatalog News (@testingcatalog)

Anthropic이 Opus 4.6을 발표했습니다. 이번 버전은 1M(100만) 토큰 컨텍스트 윈도우를 지원하며 Claude Code 사용자들에게 일반 제공(general availability)으로 배포되었습니다. 대용량 장기 문맥 처리 능력이 크게 향상되어 코드 생성·분석 및 긴 문서 처리 등 개발자용 워크플로우에서 실용성이 높아질 것으로 보입니다.