Google advierte: la computació...

Google advierte: la computació...

#Google advierte: la #computación #cuántica podría romper el #cifrado de #Bitcoin en 2029

Reunión ComCom

Pabellón 0, martes, 31 de marzo, 18:30 GMT-3

Las materias acá listadas del Departamento de Computación siguen de paro por tiempo indeterminado

Ciudad universitaria, martes, 31 de marzo, 00:00 GMT-3

Algoritmos:

Intro a la Programación / Algoritmos y Estructuras de Datos 1

Algoritmos y Estructuras de Datos / Algoritmos y Estructuras de Datos 2

Técnicas de Diseño de Algoritmos / Algoritmos y Estructuras de Datos 3

Álgebra Lineal Computacional

Teoría:

Paradigmas de Programación

Lenguajes Formales, Autómatas y Computabilidad/ Teoría de Lenguajes

Complejidad Computacional

Programación Concurrente y Paralela

Datos:

Laboratorio de Datos

Introducción a la Investigación Operativa y Optimización

Estadística Computacional

Aprendizaje Automático

Ingeniería:

Ingeniería de Software

Ingeniería de Software 2

Almacenamiento y Recuperación de la Información (práctica)

Sistemas:

Sistemas Digitales / Organización del Computador I

Arquitectura y Organización del Computador / Organización del Computador II

Sistemas Operativos

Redes de Comunicaciones y Cómputo Distribuido

Académica y optativas:

Procesamiento de Imágenes

Seminario sobre Algoritmos de Análisis de Secuencias Biológicas

Seminario de Tecnología y Sociedad

Lógicas Modales

Verificación Formal en Sistemas de Hardware a Gran Escala

Apple discontinúa el Mac Pro tras dos décadas de historia

Apple ha anunciado oficialmente el cese de producción del Mac Pro, su computadora más potente y emblemática, marcando el cierre de un capítulo de 20 años dedicado a los profesionales más exigentes del sector creativo.

https://twitter.com/markgurman/status/2037274657590595959

La noticia ha sacudido a la industria tecnológica: el Mac Pro, el estándar de oro para la edición de video de alto nivel, el renderizado 3D y la ingeniería de software en el ecosistema de Apple, llega a su fin. Tras dos décadas de evolución —desde las torres de aluminio «rallador de queso» hasta el polémico diseño cilíndrico y la actual arquitectura con silicio propio—, la compañía de Cupertino ha decidido retirar el modelo de su catálogo. Esta decisión responde a un cambio estratégico donde el Mac Studio ha logrado canibalizar el mercado profesional, ofreciendo un rendimiento equiparable en un formato mucho más compacto y eficiente.

A lo largo de sus 20 años, el Mac Pro representó la máxima capacidad de expansión y potencia bruta de la marca. Sin embargo, la transición a los chips Apple Silicon (M-Series) cambió las reglas del juego; al estar la memoria y los componentes integrados en un solo SoC, la naturaleza modular que definía al Mac Pro perdió parte de su propósito original. Apple ha señalado que, aunque el hardware dejará de venderse, los usuarios actuales seguirán recibiendo soporte técnico y actualizaciones de macOS durante los próximos años, garantizando la inversión de los estudios que aún dependen de estas estaciones de trabajo.

El adiós al Mac Pro no significa que Apple abandone al sector profesional, sino que redefine cómo estos acceden a la potencia. Con el fortalecimiento del ecosistema de escritorio profesional a través de monitores de alta resolución y unidades de procesamiento ultra-eficientes, la empresa busca simplificar su línea de productos. Para los entusiastas y nostálgicos, esta retirada marca el fin de la computadora más icónica y costosa de la era moderna de Apple, dejando un legado de innovación en diseño industrial y rendimiento computacional.

#APPLE #arielmcorg #Computación #Despedida #Diseño #Hardware #infosertec #innovación #MacPro #MacStudio #negocios #PORTADA #tecnología¿Sabían que el desarrollo del sistema operativo Unix no comenzó como un proyecto corporativo oficial, sino como una iniciativa personal de Ken Thompson para poder ejecutar un videojuego?

En 1969, tras el retiro de los Laboratorios Bell del proyecto Multics, Thompson buscaba una plataforma para correr "Space Travel", un simulador de vuelo espacial que él mismo había diseñado. Al no contar con un entorno adecuado en la computadora GE 635 —donde cada partida costaba aproximadamente 75 dólares de tiempo de procesamiento—, Thompson localizó una antigua DEC PDP-7 con apenas 8 KB de memoria y comenzó a escribir un sistema de archivos y un núcleo básico desde cero.

Este sistema inicial fue bautizado originalmente como UNICS (Uniplexed Information and Computing Service), un juego de palabras y una parodia directa hacia "Multics", el complejo sistema que pretendía reemplazar. Fue Brian Kernighan quien sugirió cambiar la ortografía a "Unix" tiempo después. Un detalle interesante es que la primera versión fue escrita íntegramente en lenguaje ensamblador; no fue sino hasta 1973 cuando Dennis Ritchie y Thompson lograron reescribir el núcleo en lenguaje C, una decisión revolucionaria que permitió que el sistema fuera portable a diferentes arquitecturas de hardware, rompiendo la dependencia absoluta entre el software y una máquina específica.

Otro hecho que define la informática moderna es el "Tiempo Unix" o "Epoch". Los sistemas basados en Unix miden el tiempo contando los segundos transcurridos desde la medianoche UTC del 1 de enero de 1970. Esta convención elegida por su simplicidad aritmética, implica que muchos sistemas actuales enfrentarán el "Efecto 2038", un desbordamiento de memoria que ocurrirá el 19 de enero de ese año cuando los contadores de 32 bits alcancen su límite máximo. Este legado, nacido de la necesidad de optimizar recursos en una máquina con menos potencia que una calculadora de bolsillo actual, es el cimiento sobre el cual operan hoy Linux, macOS y la infraestructura global de servidores.

#Unix #Historia #Computación #KenThompson #DennisRitchie #Tecnología

Reunión Abierta del DC

FCEN, Ciudad Universitaria, Buenos Aires, lunes, 30 de marzo, 17:00 GMT-3

Convocamos a docentes y estudiantes del DC a participar de una reunión

abierta para seguir discutiendo cómo hacer frente al incumplimiento de

la ley de presupuesto universitario y las consecuentes medidas en

defensa de la universidad pública.

Las y los esperamos el día lunes 30 a las 17 hs en aula a definir para

discutir algunas propuestas en danza, en particular la idea de una clase

pública afuera de la facultad, para visibilizar ante la sociedad y los

medios la gravedad de la situación.

Invitan: docentes del DC movilizados en defensa de la universidad pública.

𝑪𝒖𝒓𝒊𝒐𝒔𝒊𝒅𝒂𝒅𝒆𝒔

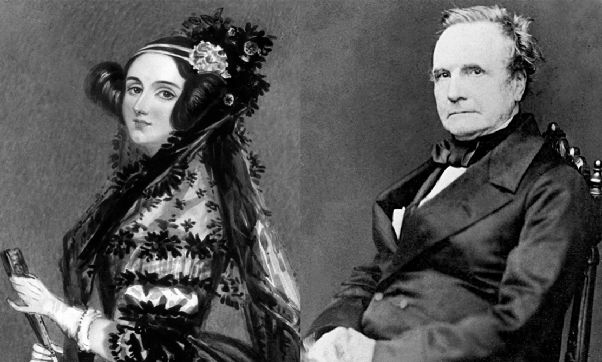

En el Londres victoriano, entre humo, hierro y ruido de fábricas, hubo alguien mirando más allá de todo eso.

Charles Babbage no veía números: veía errores.

Veía cálculos hechos a mano llenos de fallos, lentos, imprecisos… y pensaba que tenía que haber otra forma.

Y la imaginó.

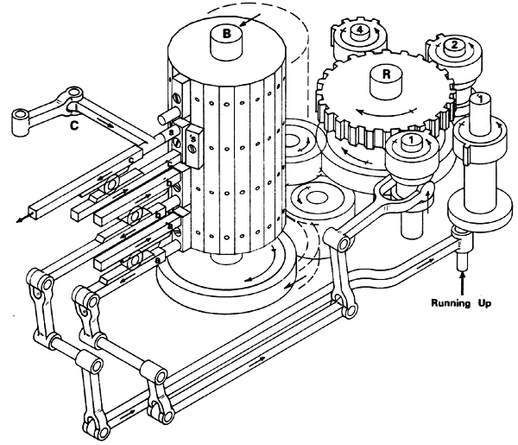

No una simple calculadora, sino algo mucho más ambicioso: una máquina capaz de hacer operaciones sola, seguir instrucciones, guardar información y ejecutar procesos paso a paso.

La llamó Máquina Analítica.

Dicho así suena normal, pero no lo era en absoluto.

Estamos hablando de engranajes, ruedas dentadas y tarjetas perforadas funcionando como lo haría, un siglo después, un ordenador.

Tenía memoria, tenía una “unidad de cálculo” y hasta algo parecido a un sistema de control.

El problema no fue la idea.

Fue el momento.

El gobierno británico empezó apoyándolo, pero aquello crecía, se complicaba, costaba dinero… y dejaron de verlo claro.

Cortaron la financiación.

Y la máquina se quedó en planos, piezas sueltas y una visión que nadie terminaba de entender.

Nunca llegó a construirse.

Y ahí es donde entra otra figura clave.

Ada Lovelace.

Hija de Lord Byron, criada entre ciencia y sensibilidad, tenía una forma distinta de mirar las cosas.

Cuando estudió el trabajo de Babbage, no vio solo una máquina rara llena de engranajes.

Vio algo completamente nuevo.

Entendió que esa máquina no estaba limitada a hacer cuentas.

Que podía trabajar con símbolos, con patrones, con instrucciones encadenadas.

En otras palabras: que podía hacer mucho más que matemáticas.

Podía seguir un lenguaje.

En sus notas —que acabaron siendo más extensas que el propio trabajo de Babbage— dejó escrito lo que hoy consideramos el primer programa informático de la historia.

Un algoritmo pensado para ser ejecutado por una máquina que ni siquiera existía todavía.

Eso es lo fuerte.

Estaba describiendo el futuro sin tener forma de verlo.

Pero, igual que pasó con Babbage, el mundo no acompañó.

Faltaban medios, faltaba comprensión… y faltaba creer en algo que sonaba demasiado extraño para la época.

Se conocieron en 1833, cuando Ada tenía solo 17 años.

Babbage quedó impresionado por su inteligencia y la llamó la "Encantadora de Números".

Ada murió joven, con 36 años.

Babbage siguió trabajando hasta el final, rodeado de piezas y de una idea que casi nadie entendía del todo.

Y el tiempo pasó.

Décadas después aparecerían nombres como Alan Turing o John von Neumann, que sí conseguirían dar forma real a ese concepto. Pero no partían de cero.

La chispa ya estaba encendida.

Mucho antes.

Hoy, en museos de Londres, se conservan fragmentos de aquella Máquina Analítica: engranajes, mecanismos, tarjetas perforadas… restos físicos de una idea que llegó demasiado pronto.

Y eso es lo que deja pensando.

Porque no fue falta de inteligencia.

Ni de creatividad.

Fue falta de contexto.

A veces, la historia no avanza cuando aparece una gran idea.

Avanza cuando el mundo está preparado para entenderla.

Y en este caso, dos personas ya habían visto el futuro…

solo que lo vieron demasiado pronto.

La máquina original completa no se puede ver… porque nunca llegó a existir.

Se quedó en planos, ideas y algunas piezas sueltas.

En el Science Museum (Londres) se conservan fragmentos auténticos: engranajes, mecanismos y partes incompletas que Babbage sí llegó a fabricar.

No es la máquina completa, pero son literalmente restos del proyecto original.

▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣▣

#historia #adalovelace #charlesbabbage #historiadelatecnologia #computacion #sigloxix #mujeresenlahistoria #curiosidades #algoritmos

Alibaba revela XuanTie C950, CPU RISC‑V de 5 nm a 3,2 GHz para inferencia de agentes de IA: 3× más rendimiento y debate sobre su fabricación (TSMC/SMIC). https://aidoo.news/noticia/6Gmkbx -V

Alibaba revela XuanTie C950, CPU RISC‑V de 5 nm a 3,2 GHz para inferencia de agentes de IA: 3× más rendimiento y debate sobre su fabricación (TSMC/SMIC). https://aidoo.news/noticia/6Gmkbx -V