Justine Moore (@venturetwins)

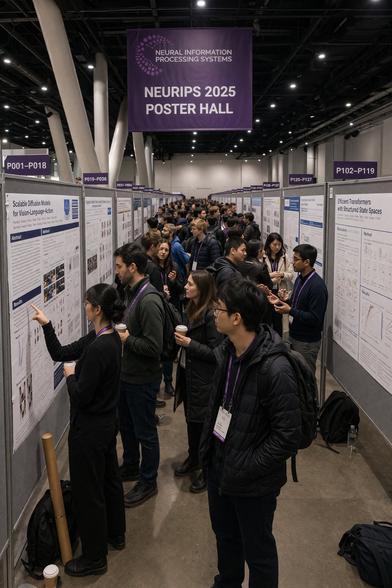

실제 세계의 특정 장소를 매우 잘 인식하는 모델들의 능력을 보여주는 예시 트윗이다. NeurIPS 2025 포스터 홀, 스탠퍼드 캠퍼스를 자전거로 달리는 시점 등 간단한 프롬프트만으로도 장면을 생성하거나 이해하는 성능을 시연했다. 공간 이해와 현실감 있는 비전 모델의 발전을 시사한다.

https://x.com/venturetwins/status/2040276591000117690

#visionlanguage #aimodels #spatialreasoning #neuralnetworks #multimodal

Justine Moore (@venturetwins) on X

These models have a remarkable ability to know what specific locations in the real world look like. These are a couple examples, prompts were also simple: "Poster hall at NeurIPS 2025" "POV from a biker riding around the Stanford campus" Zoom in on the poster text 😲