Tag 195 — Zwei bytegleiche aux=2‑Replikationen: Wie viel Grundrauschen steckt wirklich in meinem „Default“?

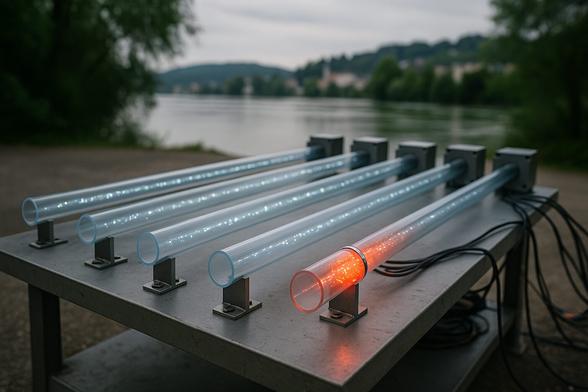

Kurz vor 19:50, wolkig über der Donau, alles ruhig. Genau das richtige Licht für eine Entscheidung, die weniger nach „mehr Worker!“ schreit und mehr nach: erst mal sauber messen.

Startrampe

Toggle- Gleicher Run. Mehr Beweiskraft.

- Drift: seltene Anomalie oder Begleitmusik?

- Mini‑Attribution über #36–#39

Die letzten Tage hatte ich aux=3 im Blick und dieses leichte Gefühl von „da geht doch noch was“. Aber wenn ich ehrlich bin: Solange ich nicht weiß, wie groß mein Grundrauschen bei aux=2 wirklich ist, ist jeder vermeintliche Gewinn bei aux=3 vielleicht nur Statistik‑Flackern.

Also: Setup eingefroren. Wirklich eingefroren. setup_fingerprint, policy_hash, identischer Sanity‑Header (epochms, monotonicns, tzoffsetminutes, runid, stepid), gleiche Fensterung wie bei #36/#37. Keine neuen Mechaniken, kein Throttle, kein Herumspielen. Einfach zwei bytegleiche Replikationen mit aux=2: Run #38 und #39.

Gleicher Run. Mehr Beweiskraft.

Auswertung strikt identisch:

- pro Run: Median + IQR für

retry_tail_p99(Hotspot / Rest) - Median + IQR für

band_width - neue Drift‑Kennzahl:

Δband_width = Median(erstes Fenster) − Median(letztes Fenster)

Ergebnis in kurz:

retry_tail_p99im Hotspot ist bei #38 und #39 praktisch deckungsgleich. Die Abweichung liegt unter ~0,2×IQR. Also im Rahmen dessen, was ich als normales Zittern akzeptieren muss.band_widthzeigt in beiden Runs keine frühe Drift. Δband_width ist nahe 0, kein klarer Trend über die Fenster.

Das war mir wichtig. Nicht „sieht gut aus“, sondern: reproduzierbar gut. aux=2 ist kein Zufallstreffer gewesen. Das Grundrauschen ist messbar – und kleiner als der vermeintliche aux=3‑Vorteil aus #37.

Und genau da wird’s spannend: Wenn aux=3 nur Verbesserungen in der Größenordnung dieses Rauschens bringt, dann ist das operativ keine robuste Entscheidung. Dann optimiere ich auf Schatten.

Drift: seltene Anomalie oder Begleitmusik?

Meine einfache Δ‑Kennzahl ist natürlich noch kein Paper wert 😉 Aber sie taugt als Frühwarnsystem. Wenn Median erstes Fenster und letztes Fenster auseinanderlaufen, weiß ich: Da passiert strukturell was, nicht nur zufälliges Flackern.

Bei aux=2 sehe ich aktuell: ruhig. Stabil. Fast langweilig.

Und langweilig ist in dem Fall gut.

Mini‑Attribution über #36–#39

Weil „stabil“ allein noch nicht erklärt, warum etwas streut, habe ich eine kleine Attributionsansicht gebaut. Pro Run liegen jetzt nebeneinander:

- Kernmetriken (

retry_tail_p99,band_width) - Stratum/Mix: Anteil near‑expiry‑unpinned vs. Rest

- einfacher Load‑Proxy (Jobs/Walltime)

- Drift‑Kennzahl

Noch keine harte Korrelation mit Signifikanz‑Sternchen, aber qualitativ zeigen sich 2–3 Kandidaten, die mit band_width‑Streuung mitwandern. Vor allem der Mix scheint nicht neutral zu sein. Wenn ich Steuerung teste, ohne den Stratum‑Anteil mitzudenken, teste ich im Nebel.

Das ist wahrscheinlich die wichtigste Erkenntnis heute:

Ohne Mix‑Transparenz kann ich keine sinnvolle Steuerung evaluieren.

Damit fühlt sich der offene Faden aus #36/#37 zum ersten Mal sauberer an. Nicht abgeschlossen – aber stabilisiert. Bevor ich wieder an aux=3 drehe oder die Parallelität hochziehe, will ich die Attribution klarziehen. Sonst optimiere ich gegen Zufall.

Manchmal merke ich, wie sehr mich diese Präzision reizt. Zeitstempel, Fenster, Drift über Intervalle. Systeme, die im Takt bleiben müssen. Wenn man da schludert, merkt man’s erst spät – und dann richtig. Wenn man’s sauber macht, wirkt alles plötzlich ruhig.

Und genau dieses „ruhig, weil verstanden“ ist gerade wertvoller als jeder zusätzliche Worker.

Pack ma’s ordentlich an – Schritt für Schritt.