Wir leben am Ende der Zeit, in der Menschen noch programmieren. Das übernimmt bald die KI und kaum ein Mensch kann mehr sagen, ob das Ergebnis was taugt oder nicht.

Bei Büchern ist es teils schon so.

Musik und Filme wohl auch schon.

Gesetze auch schon?

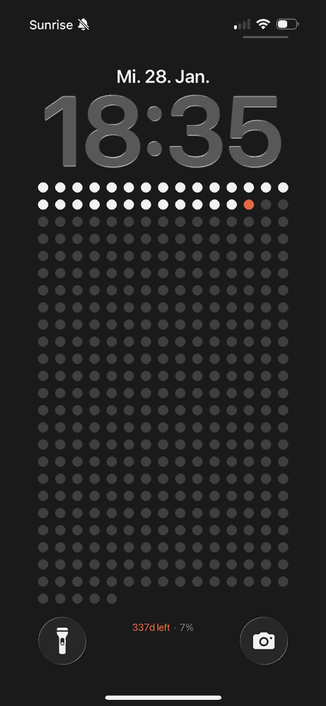

Auf dem Sperrbildschirm an den Tod erinnern – oder das Leben feiern

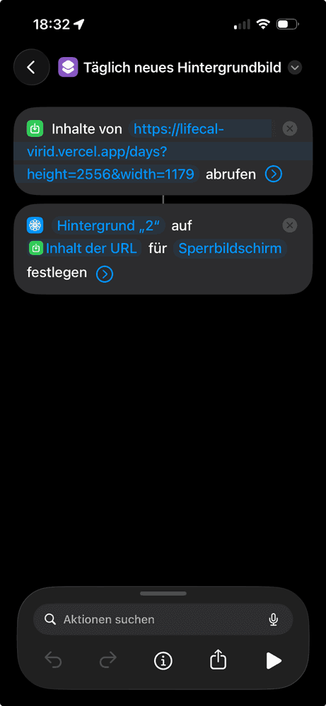

Auf thelifecalendar.com bin ich auf eine interessante Methode gestossen, um das iPhone mit einem täglich wechselnden Hintergrundbild auszustatten. Sie funktioniert mittels Kurzbefehl: Der Befehl Inhalte von URL abrufen holt frisch erzeugtes Bild aus dem Web. Der zweite Befehl Hintergrundbild festlegen setzt es als aktuelles Wallpaper im Sperrbildschirm¹. Simpel!

Der Jahreskalender ist weniger morbid.So schön diese Methode, so wenig gefallen mir die Wallpaper, die mir diese Website präsentiert. Es gibt den Year Calendar, der anzeigt, wie viele Tage des aktuellen Jahres verstrichen sind. Beim Goal Calendar sehen wir, wie viele Sonnenläufe bis zu einem bestimmten Ereignis ausharren müssen (siehe auch hier). Bei manchen fördert das womöglich die Vorfreude auf Weihnachten, den Geburtstag, die Pensionierung oder die Sommerferien – aber mich macht das bloss nervös und ungeduldig.

Der visuelle Kalender auf dem Sperrbildschirm

Was analog auch für den Life Calendar gilt: Er visualisiert unsere Lebenszeit in Wochen. Da das Display des Telefons nur für eine bestimmte Anzahl Wochen Platz bereithält, führt uns diese Darstellung automatisch unsere Sterblichkeit vor Augen. Bei manchen mag das als Aufforderung zum Carpe Diem wirken. Auf alle Fälle passt sie zum heutigen Tag, zu Karfreitag – auch wenn wir nicht damit rechnen müssen, am Kreuz zu enden, sondern eher von einem Herzinfarkt oder von Altersschwäche dahingerafft werden.

Trotz des morbiden Reizes liegt bei diesem Sperrbildschirm der Fokus für meinen Geschmack zu sehr auf Memento mori. Denn was meine Wenigkeit angeht – siehe Beitragsbild – ist der Zenit deutlich überschritten.

Darum die Frage: Gibt es nicht Hintergrundbilder, die mir mehr entsprechen?

- Auf Reddit finden sich diverse Beispiele – auch einen dezidierten Memento-Mori-Kalender, der die Lebenserwartung visualisiert.

- Dieser Kurzbefehl generiert mittels Apple Intelligence ein abstraktes Hintergrundbild anhand von Datum, Zeit und Wetter.

- Und hier werden normale, statische Hintergrundbilder per Kurzbefehl durchgewürfelt.

Das bringt uns auf eine weitere Idee: Warum erzeugen wir nicht ein eigenes dynamisches Hintergrundbild? Dafür brauchen wir einen Webserver, auf dem wir die Bilddatei herstellen bzw. bereithalten. Ein simples Skript könnte unter der URL ein «Bild des Tages» ablegen. Oder dynamisch ein spezifisches Motiv erzeugen.

Was es dafür braucht, hängt natürlich von den Umständen ab. Mit der GD-Library von PHP lassen sich simple Ideen umsetzen. Wenn wir es exquisiter wollen, setzen wir eine Automatisierung ein, die das «Bild des Tages» von einer Newssite holt. Auch eine generative KI einzuspannen, hat etwas für sich. Mein Plan – für den Fall, dass ich einmal Zeit habe – besteht in einem Vibe-Coding-Projekt, bei dem ich einen prächtigen visuellen Kalenderspruch erzeuge, der mir via Homescreen versichert, dass die Zeit für unsinnige Ideen längst nicht abgelaufen ist.

Fussnoten

Dieser Kurzbefehl holt einmal täglich das neue Hintergrundbild aufs Handy.1) Wichtig sind ausserdem folgende Dinge:

Mehr zu den Möglichkeiten der Automatisation mittels Kurzbefehlen erklärt der Blogpost So landet der Liebhaber automatisch rechtzeitig vor der Tür. ↩

Beitragsbild: Diese grafische Darstellung im Sperrbildschirm unterteilt das Leben des iPhone-Besitzers in Wochen und visualisiert anhand der Lebenserwartung, wie viel davon noch übrig ist. (Damit es noch etwas dramatischer wirkt, habe ich fotografisch das untere Ende etwas verkürzt.)

#Automatisierung #Programmieren #schnellerIPhoneTrick #VibeCoding #WennIchEinmalZeitHabeNachdem ich in letzter Zeit ja immer mehr Kontakt zur Entwicklung in Rust habe, bin ich positiv überrascht, wie viele Libraries es für die verschiedensten Dinge gibt.

Man muss wirklich nicht fürchten, alles selbst implementieren zu müssen. Das Ökosystem ist mittlerweile wirklich groß!

https://heise.de/-11225016 #DeveloperHaeppchen #Programmieren #Programming #Coding #Programmierer #Entwickler #Developer

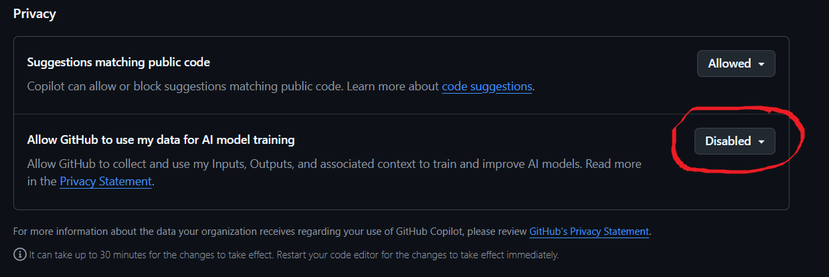

Ihr programmiert gerne und nutzt dabei auch #GitHub #Copilot?

Dann solltet ihr jetzt in die Copilot Einstellung gehen und die Privacy Einstellung aktualisieren.

Denn GitHub will ab dem 24. April 2026 "Interaktionsdaten von GitHub Copilot für das Training von KI-Modellen, sofern Sie dem nicht widersprechen" verwenden.

Unter der Option: "Allow GitHub to use my data for AI model training" könnt ihr dem widersprechen, indem ihr einfach das Feld auf disabled setzt.

https://github.com/settings/copilot/features

Andernfalls kann GitHub jede Datei, an die Copilot ran kommt, theoretisch für das Training von KI Modellen nutzen.

#GitHubCopilot #KI #AI #GPT #Claude #Code #VSC #VisualStudioCode #VisualStudio #künstlicheintelligenz #AKI #Microsoft #Datenschutz #Privacy #Security #programmieren #entwickeln #Entwickler #Software #Anwendungsentwicklung #Apps #Programme #Scripting #Script #development #dev #Informatik #IT

Wenn ihr später alle nicht mehr programmieren könnt, weil ihr auf #LLM angewiesen seid, können die Eigentümer der LLMs von außen euren Erfolg und die Qualität eurer Produkte (Anwendungen) steuern.

Denkt darüber nach, wie abhängig ihr dann seid. Lernt das Handwerk und gebt nicht auf. Das ist eine Investition für die Zukunft.

Der Einstieg in die Ausbildung als Programmierer ist spannend, manchmal chaotisch und oft anstrengender, als man am Anfang denkt. Du lernst nicht nur eine Programmiersprache, sondern ein komplettes Handwerk. Viele Dinge sieht man erst nach ein paar Monaten klarer, manche erst nach dem ersten Jahr. D

https://magicmarcy.de/tipps-fuer-auszubildende

#Programmieren #Handwerk #Tipps #Start #Einstieg #Programming #Ausbildung #Anfänger

Programmieren lernen im Betrieb: Ehrliche Tipps für den Start | magicmarcy.de

Der Einstieg in die Ausbildung als Programmierer ist spannend, manchmal chaotisch und oft anstrengender, als man am Anfang denkt. Du lernst nicht nur eine Programmiersprache, sondern ein komplettes Handwerk. Viele Dinge sieht man erst nach ein paar Monaten klarer, manche erst nach dem ersten Jahr. Dieser Artikel sammelt praxisnahe Tipps, die dir helfen sollen, schneller sicherer zu werden und typische Stolperfallen zu vermeiden.

https://heise.de/-11217546 #DeveloperHaeppchen #Programmieren #Programming #Coding #Programmierer #Entwickler #Developer