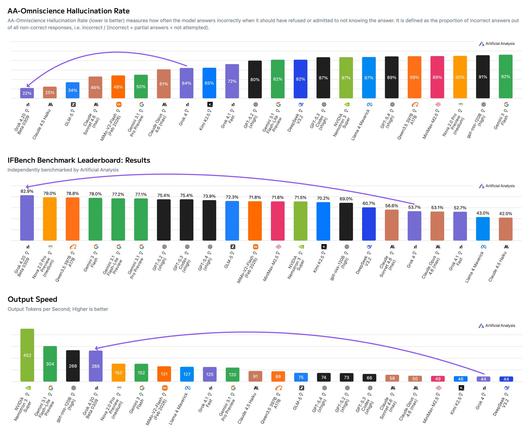

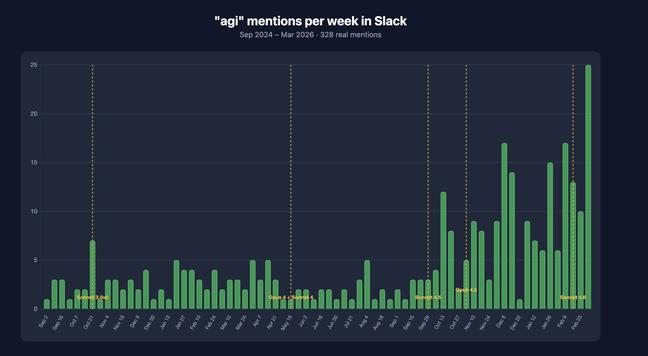

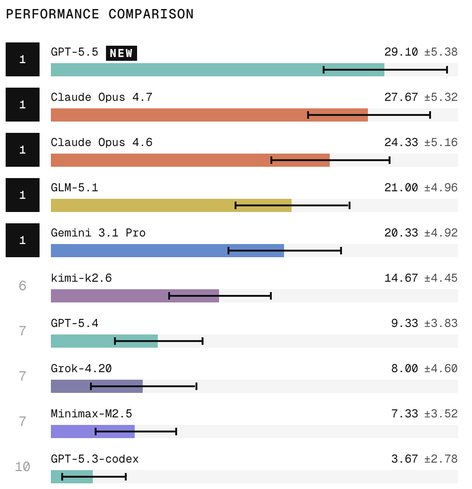

HiL-Bench는 AI 에이전트가 무엇이 부족한지 인지하고 질문할 줄 아는지를 검증하는 최초의 벤치마크입니다. 최첨단 모델은 완전한 사양에서는 잘하지만 핵심 정보를 일부 제거하면 자신있게 그럴듯한 오답을 내보냅니다. 최근 GPT-5.5, Opus 4.7, Kimi K2.6를 리더보드에 추가했고, 현재 이런 현상이 관찰되고 있습니다.

Scale Labs (@ScaleAILabs) on X

We recently built HiL-Bench, the first benchmark to test a critical question: do AI agents know what they’re missing and when to ask? Frontier models perform well with perfect specs. But remove a few key details, and they confidently guess and ship plausible wrong answers. We