thunderbolt-ibverbs: We have InfiniBand at home

Как мы внедряли QoS InfiniBand для приоритизации ML-обучений с точки зрения сети

В статье расскажем, как мы командой Yandex Infrastructure внедрили QoS в сетях InfiniBand при ограниченной вендорской поддержке и скудной практической документации. Обсудим мотивацию: рост смешанных нагрузок во внутреннем облаке и необходимость предсказуемых SLO для различных обучений. Отдельно рассмотрим как могут быть связаны QoS и топология сети DragonFly+.

https://habr.com/ru/companies/yandex_cloud_and_infra/articles/1015226/

The network war nobody talks about: Ultra Ethernet vs InfiniBand.

UEC 1.0 launched June 2025. Open Ethernet now approaches InfiniBand performance.

Ultra Ethernet wins inference scale-out. InfiniBand holds frontier training (sub-1us latency, proven at 100K+ GPUs).

AI hardware refreshes under 5 years. Facilities that cannot support 3-ton racks or liquid cooling face obsolescence.

The network war nobody talks about: Ultra Ethernet vs InfiniBand.

UEC 1.0 launched June 2025. Open Ethernet now approaches InfiniBand performance.

Ultra Ethernet wins inference scale-out. InfiniBand holds frontier training (sub-1us latency, proven at 100K+ GPUs).

AI hardware refreshes under 5 years. Facilities that cannot support 3-ton racks or liquid cooling face obsolescence.

Đang chuẩn bị mua 2× DGX Spark, lo ngại kết nối chỉ 1 cáp 200 Gbps gây băng thông giới hạn so với bộ nhớ thống nhất ~275 Gbps. Thêm cáp thứ hai (dual‑link) có thể thu hẹp khoảng cách. Cáp khuyên dùng: QSFP56 200G (0.5 m) hay QSFP112? Người dùng muốn cổng Ethernet Mellanox để nối thẳng ZFS 7450 Pro. #DGX #AI #InfiniBand #Networking #CôngNghệ #CôngNghệAI

https://www.reddit.com/r/LocalLLaMA/comments/1qquinu/bottlenecked_dgx_spark_by_network/

Нейро сети для самых маленьких. Часть нулевая. Обзорная

Нейро сети для самых маленьких Каждый раз, когда вы говорите нейросети « Спасибо », вы запускаете конвейер, в котором перемножаются сотни матриц с миллиардами элементов, и сжигаете электричества столько же, сколько светодиодная лампа за несколько секунд. Это первая статья из небольшого цикла, посвящённого сетям для AI/ML-кластеров и HPC. В этой серии мы коснёмся принципов работы и обучения моделей, параллелизации, технологий DMA и RDMA, сетевых топологий, InfiniBand и RoCE, а ещё пофилософствуем на тему общих и специальных решений. Конкретно в этой статье мы разберёмся, что представляет из себя нейросеть, как она работает, как происходит её обучение, а самое главное, почему для неё нужны сотни дорогущих GPU-карточек и какая-то особенная сеть. Рефрен сегодняшней истории: в нейросетях нет никакой магии — это просто множество простых операций над числами, которые выполняются на компьютерах со специальными чипами. Магии нет ни в том, как они работают, ни в той инфраструктуре, на которой они запускаются. Ныряем!

https://habr.com/ru/articles/982820/?utm_source=habrahabr&utm_medium=rss&utm_campaign=982820

#ai #ml #roce #infiniband #трансформеры #нейросети #llm #mlp #backpropagation

Нейро сети для самых маленьких

Нейро сети для самых маленьких Каждый раз, когда вы говорите нейросети « Спасибо », вы запускаете конвейер, в котором перемножаются сотни матриц с миллиардами элементов, и сжигаете электричества столько же, сколько светодиодная лампа за несколько секунд. Это первая статья из небольшого цикла, посвящённого сетям для AI/ML-кластеров и HPC. В этой серии мы коснёмся принципов работы и обучения моделей, параллелизации, технологий DMA и RDMA, сетевых топологий, InfiniBand и RoCE, а ещё пофилософствуем на тему общих и специальных решений. Конкретно в этой статье мы разберёмся, что представляет из себя нейросеть, как она работает, как происходит её обучение, а самое главное, почему для неё нужны сотни дорогущих GPU-карточек и какая-то особенная сеть. Рефрен сегодняшней истории: в нейросетях нет никакой магии — это просто множество простых операций над числами, которые выполняются на компьютерах со специальными чипами. Магии нет ни в том, как они работают, ни в той инфраструктуре, на которой они запускаются. Ныряем!

https://habr.com/ru/articles/982820/

#ai #ml #roce #infiniband #трансформеры #нейросети #llm #mlp #backpropagation

RE: https://mastodon.social/@h4ckernews/115709034881203323

This is technically impressive. I didn't expect to see RDMA support on macOS, let alone running over Thunderbolt. They seem to provide a standard InfiniBand Verbs API but I couldn't find the sources of their driver (rdma_en5) and libraries yet. I guess they won't release the sources.

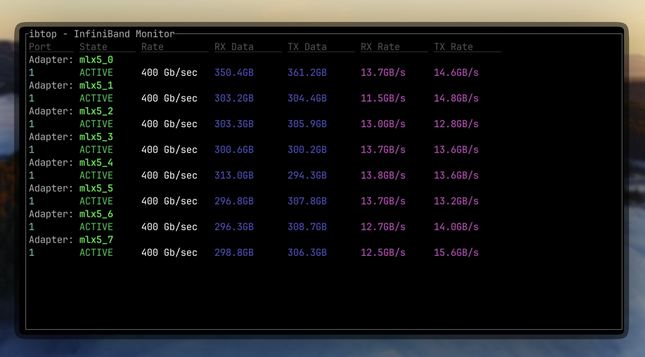

Monitoring high-speed networks… in the terminal 😍

📡 **ibtop** — Real-time TUI monitor for InfiniBand networks.

💯 htop but for ultra-fast interconnects.

🦀 Written in Rust & built with @ratatui_rs

⭐ GitHub: https://github.com/JannikSt/ibtop

#rustlang #ratatui #tui #networking #infiniband #linux #terminal