Demis Hassabis (@demishassabis)

Gemma 4가 공개되었으며, 각 크기별로 최적화된 최고 수준의 오픈 모델이라고 소개한다. 31B dense, 26B MoE, 2B/4B edge용 등 다양한 버전으로 제공되어 파인튜닝과 온디바이스 활용이 가능해, 오픈 소스 모델 분야의 중요한 출시다.

Demis Hassabis (@demishassabis)

Gemma 4가 공개되었으며, 각 크기별로 최적화된 최고 수준의 오픈 모델이라고 소개한다. 31B dense, 26B MoE, 2B/4B edge용 등 다양한 버전으로 제공되어 파인튜닝과 온디바이스 활용이 가능해, 오픈 소스 모델 분야의 중요한 출시다.

Avi Chawla (@_avichawla)

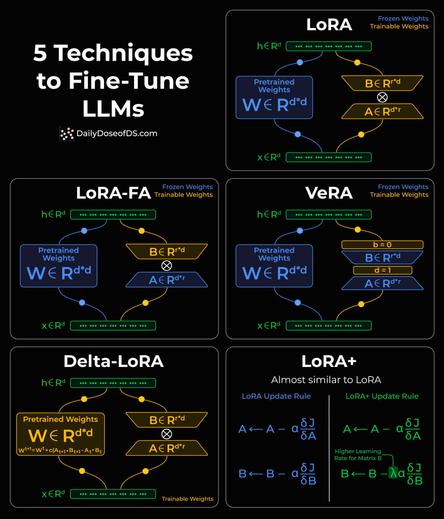

LLM 파인튜닝을 2년 이상 해온 경험을 바탕으로, 대형 언어모델 파인튜닝의 주요 기법 5가지를 시각자료와 함께 정리한 내용이다. 실무자에게 유용한 LLM 학습/튜닝 방법론 참고 자료로 볼 수 있다.

I have been fine-tuning LLMs for over 2 years now! Here are the top 5 LLM fine-tuning techniques, explained with visuals: First of all, what's so different about LLM finetuning? Traditional fine‑tuning is impractical for LLMs (billions of params; 100s GB). Since this kind of

Microsoft Research (@MSFTResearch)

다국어 AI 구축에서 발생하는 어려운 선택을 돕는 인터랙티브 플레이북 Vibhasha가 소개됐다. 번역할지 파인튜닝할지, 단일 모델로 갈지 다중 모델로 갈지 같은 결정을 지원하며, 다양한 언어권 앱을 설계하는 개발자에게 유용한 도구다.

LoRA не помогла: как мы дообучали Mistral 7B на русском и что в итоге сработало

Каждый раз после созвона происходит одно и то же самое: кто-то открывает чат и пишет «итак, что мы решили?». Дальше — пятнадцать минут на то, чтобы восстановить то, что только что обсуждали час. Я ML-инженер, и эта боль мне была знакома лично. Когда появилась идея автоматизировать протоколирование встреч, казалось, что задача решаемая: берешь Whisper для распознавания речи, хорошую LLM для суммаризации — и готово. Реальность оказалась другой. Готовых русскоязычных решений нужного качества не было. Mistral 7B — одна из лучших открытых моделей на тот момент — на русском ошибался в склонениях, плохо следовал русскоязычным промптам и терял смысл в длинных диалогах. Стало понятно: придётся дообучать самим.

https://habr.com/ru/articles/1017634/

#llm #mistral #lora #дообучение #nlp #nlp_обработка_текста #finetuning #whisper #суммаризация #bertscore

🔧 Unsloth launched Studio — faster, cheaper LLM fine-tuning for small teams.

Custom model training used to be a big-lab privilege.

Not anymore.

fly51fly (@fly51fly)

대형 언어모델에서 파인튜닝이 저작권 도서의 문장을 그대로 기억하고 재현하는 현상을 분석한 연구입니다. 모델 정렬을 강화해도 오히려 verbatim recall이 활성화될 수 있어, 저작권·안전성 측면에서 중요한 시사점을 제공합니다.

Ilir Aliu (@IlirAliu_)

로봇 정책을 전체 재학습하지 않고 내부 상태를 작은 feature vector로 압축한 뒤, 그 위에 작은 RL 레이어만 학습하는 'RL token' 아이디어를 소개한다. 로봇 정책 fine-tuning 시간을 며칠에서 몇 분으로 줄일 수 있다고 강조하며, 로보틱스 학습 효율을 크게 높일 수 있는 접근이다.

https://x.com/IlirAliu_/status/2036366477075366246

#robotics #reinforcementlearning #finetuning #robotpolicy #ai

Robots building robots. RL token is a simple but powerful idea: Fine-tuning robot policies usually takes days. This takes minutes. Instead of retraining the full model, compress its internal state into a small feature vector and train a tiny RL layer on top. • small actor +

Avi Chawla (@_avichawla)

TinyLoRA 논문(arXiv: 2602.04118) 소개 트윗으로, 초소형 파라미터 조정만으로 대형 모델의 추론 성능을 개선하는 방법을 시각적으로 설명한다. 새로운 모델 출시보다는 연구 결과 공유에 가깝지만, 경량 파인튜닝과 효율적 적응 기술에 관심 있는 개발자에게 유용하다.

Avi Chawla (@_avichawla)

Meta, Cornell, CMU 연구진이 TinyLoRA를 공개했다. 8B 파라미터 모델의 성능을 수학·추론 작업에서 크게 끌어올리기 위해 단 13개 파라미터만 조정하는 초소형 LoRA 기법이다. 저장 공간은 26바이트에 불과해, 극도로 효율적인 미세조정 접근법으로 주목된다.

TinyLoRA: LoRA scaled down to 1 parameter. Researchers from Meta, Cornell, and CMU just dropped a banger. They turned an 8B parameter model into a math and reasoning powerhouse by tweaking just 13 of those parameters. That's 26 bytes and takes up less storage than this

🔬 #Physics Puzzles – Exciting puzzle questions explained simply! 🤓

📎https://philosophies.de/index.php/2022/10/26/zoomposium-naumann-bohnet-das-raetselhafte-universum/

#ThomasNaumann #IljaBohnet #Zoomposium #OpenQuestionsInPhysics #NaturalSciences #DarkMatter #StringTheory #Cosmology #Philosophy #PhilosophyOfScience #ParticlePhysics #ConstantsOfNature #Multiverse #Falsifiability #FineTuning # Order #Beauty #Truth #Psychology #CriticismOfScience #Research #Physics #Cosmos #Cosmetics #OpenQuestions