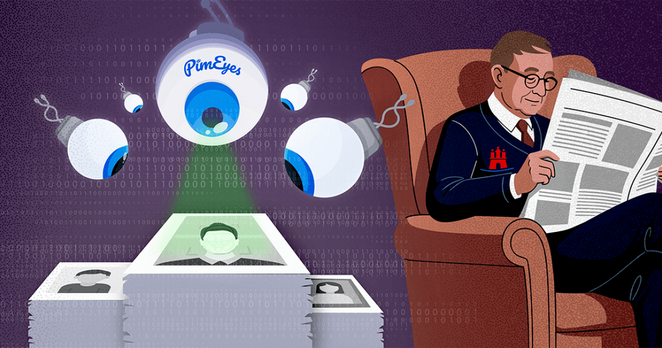

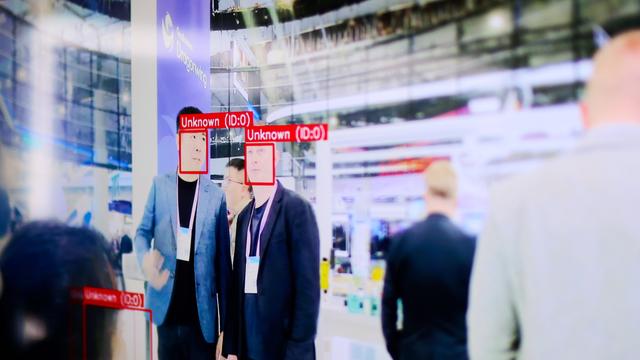

#CCC | #Biometrische #Massenüberwachung nicht länger dulden: #Klage gegen #Hamburger #Datenschutzbehörde

Der #Chaos_Computer_Club unterstützt die Klage gegen die Hamburger Datenschutzbehörde im Zusammenhang mit der illegalen #Gesichtersuchmaschine #PimEyes. Die Behörde hatte jahrelang keinerlei Maßnahmen ergriffen und das Verfahren dann einfach eingestellt.

Gegen die #Hamburger #Datenschutzbehörde ist heute von der österreichischen #NGO #noyb eine Klage eingereicht...