https://winbuzzer.com/2026/04/18/microsoft-says-recall-claim-matches-intended-design-xcxwbn/

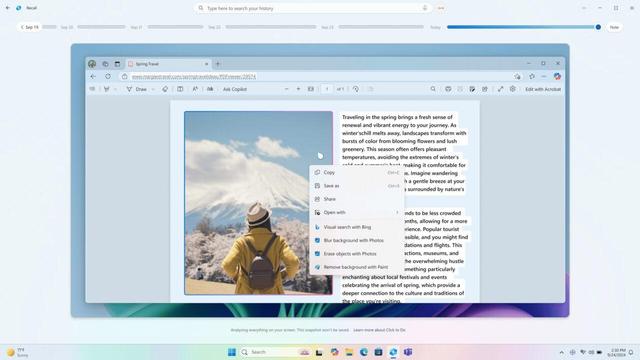

Microsoft Says Windows Recall Behavior Matches Intended Design

#AI #WindowsRecall #Microsoft #Privacy #Cybersecurity #Windows11 #OperatingSystems #WindowsPCs #OnDeviceAI #AIPrivacy #AISecurity