[Перевод] Как оценить качество LLM модели

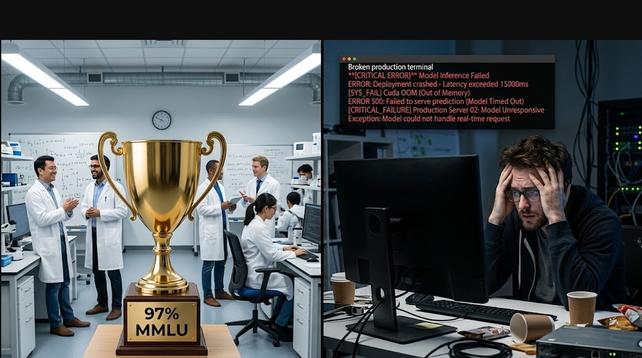

Представьте модели LLM размером до более чем 100 миллиардов параметров, каждая из которых мощнее предыдущей. Среди них есть гиганты: Mistral (7 миллиардов), Mixtral (8x7 миллиардов), Llama (70 миллиардов) и колоссальная Falcon (180 миллиардов). Однако существуют и модели наподобие Phi1, Phi1.5 и Falcon 1B, стремящиеся к сравнимому уровню мощности, имея всего от 1 до 4 миллиардов параметров. У каждой модели, и большой, и маленькой, есть одна цель: стать мастером в искусстве языка, превосходно справляться с такими задачами, как резюмирование текстов, ответы на вопросы и распознавание именованных сущностей. Но во всех этих задачах у всех больших языковых моделей (Large Language Model, LLM) проявляются сильные изъяны: Некоторые промты заставляют LLM создавать мусорные результаты; они называются «промтами джейлбрейкинга». LLM не всегда правильно излагают факты; это явление называется «галлюцинациями». LLM могут вести себя неожиданно, из-за чего потребителям бывает небезопасно ими пользоваться. Очевидно, что простого обучения LLM недостаточно. Поэтому возникает вопрос: как нам обеспечить уверенность в том, что LLM А (с n параметров) лучше LLM Б (с m параметров)? Или сделать вывод, что LLM А надёжнее, чем LLM Б, на основании исчисляемых, обоснованных наблюдений? Необходим стандарт для бенчмаркинга LLM, гарантирующий их этическую надёжность и фактическую точность. Хотя было проведено множество исследований бенчмаркинга (например, MMLU, HellaSwag, BBH и так далее ), одних лишь исследований недостаточно для надёжного специализированного бенчмаркинга продакшен-систем.

https://habr.com/ru/articles/846748/

#Машинное_обучение #LLM #DeepEval #RAG #LMSys #LLMArena #PromptBench #llm_arena #HELM #MMLU #HellaSwag #BIGBench_Hard