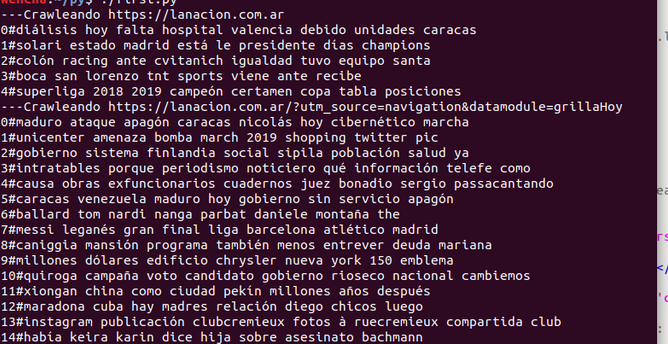

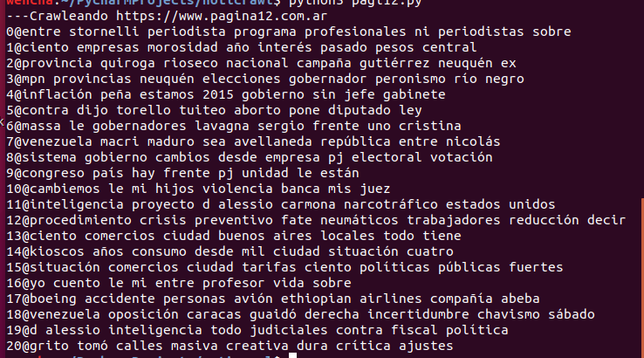

Массовое вытаскивание урлов из нескольких xml карт сайта

Периодически приходится решать достаточно интересные задачи, а иногда достаточно нудные и скучные, когда надо просто механически повторять один и тот же порядок действий, и длиться это может достаточно долго. что отнимает ресурс в виде времени. Ну а зачем тратить час на ручную работу, если можно потратить 2 часа на то, чтобы это автоматизировать, правда? Сказал бы я вот так и потратил бы на это часа три, а то и четыре. Но слава нейросетям, помогают сократить это время до минимума. Суть задачи - надо вытащить урлы из xml карты сайта, но карта разбита на несколько мелких карт по 1000 урлов, соответсвенно это осложняет процесс загрузки этих урлов. Резонный вопрос, а на кой ляд тебе понадобились эти урлы? Для того, чтобы отправить их на индексацию через Google Indexing API, как я это называю - принудительная отправка на индексацию большого массива. Можно пойти простым путем, открывать каждый урл руками, сохранять его как xml на своем компьютере, далее собрать их все в одну папку и открыть принудительно все скопом через Power Query (кто не знает. что есть такая офигенная штука у Гугл таблиц - с добрым утром, рекомендую погуглить). Но открыть 100 ссылок руками - ну такое, правда? Поэтому, за 1 минуту был сгенерирован скрипт на Питоне, которые решил задачу за 1,5 минуты. Мне не понадобилось много времени, скрипт заработал со второго раза, поэтому я делюсь им с вами, может кому будет полезен.