El 60% de las Contraseñas Actuales puede Descifrarse en 1 hora

Con motivo del Día Mundial de la Contraseña, los analistas de Kaspersky han estudiado 231 millones de contraseñas únicas procedentes de grandes filtraciones registradas entre 2023 y 2026, identificando varios patrones clave. En primer lugar, el 68% de las contraseñas actuales puede descifrarse en menos de un día y el 60% en una hora aproximadamente. Además, la mayoría de las contraseñas comprometidas comienzan o terminan con un número, un patrón repetido que facilita los intentos masivos de acceso no autorizado (Fuente Kaspersky Latam).

En los últimos años, las normas para crear contraseñas seguras han cobrado especial relevancia. Cada vez más servicios exigen claves de al menos 10 caracteres, con mayúsculas, números o símbolos. Sin embargo, el análisis comparativo de contraseñas filtradas demuestra que cumplir parcialmente estas reglas no garantiza resistencia frente a ataques de fuerza bruta o impulsados por Inteligencia Artificial.

Los analistas de Kaspersky comparten algunas recomendaciones prácticas para crear contraseñas más seguras y evitar errores comunes.

Evitar patrones previsibles en símbolos y números

Entre las contraseñas filtradas que incluyen un único símbolo, el más utilizado es “@”, presente en el 10% de los casos. Le siguen el punto (.) en un 3% y el signo de exclamación (!).

En cuanto a los números, también se repiten patrones muy previsibles:

- El 53% de las contraseñas analizadas termina en cifras

- El 17% comienza con números

- Cerca del 12% incluye secuencias que recuerdan a fechas (entre 1950 y 2030)

- El 3% contiene secuencias de teclado como “qwerty” o “ytrewq”, aunque predominan combinaciones numéricas como “1234”

Según explica Alexey Antonov, responsable del equipo de Data Science de Kaspersky, el uso de símbolos, números o fechas habituales, especialmente al principio o al final de la contraseña, facilita considerablemente los ciberataques por fuerza bruta.

“Los ataques de fuerza bruta prueban sistemáticamente todas las combinaciones posibles hasta encontrar la correcta. Si los ciberdelincuentes conocen los patrones más habituales, el tiempo necesario para descifrar una contraseña se reduce drásticamente. Para evitarlo, lo más recomendable es utilizar generadores de contraseñas que creen combinaciones aleatorias de letras, números y símbolos”, explica.

Entre el “paraíso” y el “infierno”: evitar palabras comunes

El estudio también revela que muchas contraseñas se basan en palabras con carga emocional o tendencias del momento. Entre 2023 y 2026, por ejemplo, el uso de “Skibidi” creció de forma notable. Además, predominan las palabras positivas como “love”, “magic”, “friend”, “team”, “angel”, “star” o “eden”, aunque también aparecen términos negativos como “hell”, “devil”, “nightmare” o “scar”.

“Utilizar una sola palabra como contraseña, incluso añadiendo un número o símbolo, sigue siendo una opción débil. Es un patrón demasiado predecible. Lo más recomendable es crear frases de contraseña que combinen varias palabras sin relación entre sí, incorporando números, símbolos e incluso pequeñas variaciones intencionadas. Cuanto más larga, aleatoria e impredecible sea, más difícil será de descifrar. Además, es fundamental activar la autenticación en dos factores siempre que sea posible”, añade Alexey Antonov.

¿Importa la longitud de la contraseña?

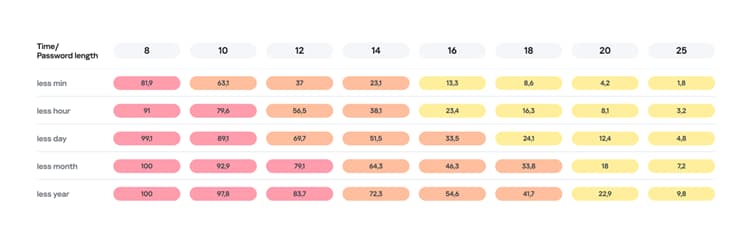

Aunque las contraseñas largas siguen siendo más difíciles de descifrar, el análisis confirma que la longitud por sí sola ya no es suficiente. Con el uso de herramientas basadas en Inteligencia Artificial, incluso contraseñas extensas pueden ser vulnerables si siguen patrones previsibles.

Las contraseñas cortas (de hasta ocho caracteres) pueden descifrarse en menos de un día. Sin embargo, más del 20% de las contraseñas de 15 caracteres también puede romperse en menos de un minuto mediante algoritmos avanzados.

Influencia de la longitud de la contraseña en las tasas de piratería informática: resultados basados en una sola GPU 5090 y el algoritmo MD5

En total, el 60,2% de las contraseñas analizadas puede descifrarse en aproximadamente una hora, y el 68,2% en menos de un día. Estos cálculos se basan en el uso de una única GPU RTX 5090 y el algoritmo MD5. En la práctica, los ciberdelincuentes pueden utilizar múltiples GPUs, lo que acelera el proceso de forma exponencial.

Hoy en día, una contraseña segura debe tener más de 16 caracteres y combinar letras, números y símbolos de forma aleatoria, sin repeticiones ni patrones. Además, es fundamental que cada cuenta tenga una contraseña única. Para facilitar este proceso, Kaspersky ha incorporado una función de generación de contraseñas en su web, que permite tanto comprobar si una clave ha sido filtrada como crear contraseñas seguras de forma gratuita.

Para gestionar las credenciales de forma sencilla y segura, se recomienda utilizar un gestor de contraseñas, que almacene toda la información en un entorno protegido mediante una única clave maestra. Este tipo de herramientas también permite el autocompletado y la sincronización entre dispositivos, además de gestionar nuevas formas de acceso como las passkeys.

El análisis se basa en datos del servicio Kaspersky Digital Footprint Intelligence.

#arielmcorg #contraseñas #infosertec #kaspersky #PORTADASamsung inicio el despliegue oficial de One UI 8.5

Samsung anunció la expansión y despliegue de One UI 8.5 a más dispositivos, llevando las funciones más recientes de Galaxy AI a todo el ecosistema Samsung Galaxy. La actualización se centra en mejorar las experiencias de comunicación y creatividad en los teléfonos móviles y tablets Galaxy, incluyendo la serie Galaxy S25, Galaxy S25 FE, la serie Galaxy S24, Galaxy S24 FE, Galaxy Z Fold7 y Galaxy Z Flip7, Galaxy Z Fold6 y Galaxy Z Flip6, la serie Galaxy Tab S11 y la serie Galaxy Tab S10 (Fuente Samsung Global).

One UI 8.5 comenzará a desplegarse en Corea a partir del 6 de mayo con regiones adicionales a continuación.

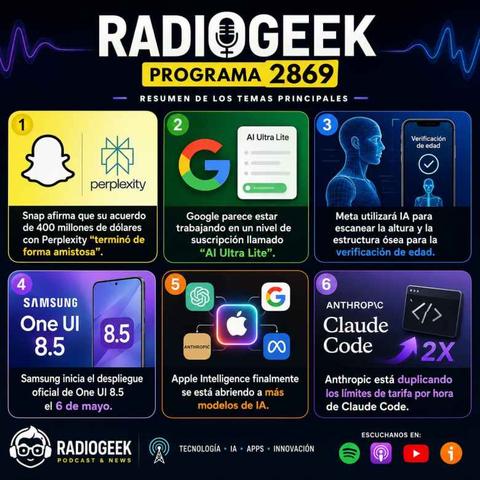

#oneUI85 #PORTADA #SamsungRadiogeek 2869 – Apple estaría pensando en abrirse a varios modelos de IA

El programa 2869 de Radiogeek, les habló de varios temas importantes. Snap afirma que su acuerdo de 400 millones de dólares con Perplexity «terminó de forma amistosa»; Google parece estar trabajando en un nivel de suscripción llamado «AI Ultra Lite»; Meta utilizará IA para escanear la altura y la estructura ósea para la verificación de edad; Samsung inicia el despliegue oficial de One UI 8.5 el 6 de mayo; Apple Intelligence finalmente se está abriendo a más modelos de IA y por último Anthropic está duplicando los límites de tarifa por hora de Claude Code.

https://open.spotify.com/episode/25OgQxrFuHqWOsfNrvuEUJ?si=60f79b15204c4751

Toda esta información la pueden encontrar desde nuestra web http://www.infosertec.com.ar o bien desde el canal de Telegram/Whastapp, o Instagram.

Esperamos sus comentarios.

#APPLE #arielmcorg #google #IA #infosertec #PerplexityAI #PODCAST #PORTADA #RADIOGEEK #tech #tecnologíaEl Mundial en casa con Noblex

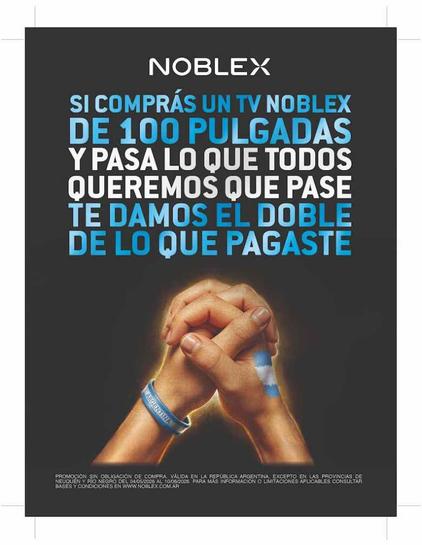

En el marco del Mundial 2026, Noblex, lanzó una nueva campaña apelando a la sensibilidad del hincha argentino. Con un fuerte tinte de la cultura del fútbol argentino, Noblex presenta una propuesta que acompaña los momentos de reunión más importantes en los hogares argentinos (Fuente Newsan).

Durante el Mundial, el televisor se transforma en el centro emocional del hogar. El living se convierte en punto de encuentro y la experiencia de ver los partidos pasa a ser tan importante como el resultado.

https://twitter.com/arielmcorg/status/2052171462929256583

En este contexto, crece la aspiración por pantallas cada vez más grandes, capaces de amplificar esa vivencia colectiva. La propuesta de Noblex acompaña esta tendencia con el desarrollo de equipos como el modelo de 100 pulgadas de la línea Black Series Pro, que lleva la experiencia a una escala inmersiva.

Con resolución 4K, tecnología QLED y un contraste de 5000:1, el equipo apunta a maximizar la calidad de imagen en escenas de alta exigencia visual, permitiendo sentir cada pase, cada control y cada definición como si estuvieses dentro de la cancha, con un nivel de detalle que hace visibles incluso los movimientos más sutiles del juego. A esto se suma una frecuencia de refresco de 144 Hz, junto con tecnologías como Variable Refresh Rate y Auto Low Latency Mode, que optimizan la fluidez y la respuesta en tiempo real, para no perderte ningún movimiento: desde un cambio de ritmo en mitad de cancha hasta una jugada rápida en el área que se define en segundos.

El sistema de sonido, con parlantes estéreo y subwoofer integrado, refuerza la experiencia desde lo sensorial, haciendo que vivas el partido como en la tribuna, con el clima del estadio, los cantos y la tensión de cada jugada. Por su parte, la conectividad —WiFi, Bluetooth, múltiples puertos HDMI y funciones como Google Assistant y Miracast— acompaña un uso cada vez más integrado dentro del ecosistema digital del hogar, facilitando acciones como compartir una repetición desde el celular, seguir estadísticas en simultáneo o cambiar de contenido sin interrumpir el partido.

En consonancia con esta expectativa generalizada, Noblex lanzó una promoción: quienes compren un televisor de 100 pulgadas serán acreedores a la devolución del doble de su valor si Argentina resulta ganadora del Mundial. Dicha devolución se efectuará mediante un cupón utilizable en cualquiera de los productos disponibles en la web de Tienda Newsan.

Así, el dispositivo no solo mejora la calidad de visualización, sino que redefine el rol del hogar durante el Mundial: un espacio donde la tecnología y la emoción se combinan para generar una experiencia compartida.

#arielmcorg #newsan #noblex #PORTADA #smarttvPlataforma 13M: “Es insultante que Forestalia publicite proyectos como si no hubiera pasado nada”

¿Qué pasa con tus datos en ChatGPT? Riesgos de privacidad y cómo protegerlos

Ya sea para programar, escribir correos electrónicos o resumir documentos complejos, la inteligencia artificial se ha convertido en una infraestructura digital básica para muchas personas y su uso paso a ser muy extensivo; ChatGPT, por ejemplo, alcanzó a principios de este año, según datos que publica OpenAI, los 900 millones de usuarios activos semanales. Sin embargo, ESET, advierte que esta escala masiva trae consigo una cuestión crítica para la seguridad digital: ¿dónde va a parar cada palabra que se escribe en ese campo de texto? (Fuente ESET Latam).

“Muchas personas pueden creer que las conversaciones son volátiles y funcionan como un chat privado que desaparece al cerrar la ventana. En realidad, interactuar con grandes modelos de lenguaje implica una compleja red de almacenamiento y procesamiento de datos que puede exponer secretos comerciales o información personal sensible si no se tiene cuidado.”, comenta Mario Micucci, Investigador de Seguridad Informática de ESET Latinoamérica.

ESET afirma que cuando se escribe información en ChatGPT, no se guarda únicamente en el navegador. El texto recorre un camino que involucra tres capas fundamentales de tratamiento de datos:

1. Almacenamiento e historial: En cuanto se envía un mensaje, se almacena en los servidores de OpenAI para que puedas acceder al historial en diferentes dispositivos y para que el chatbot mantenga el contexto de la conversación actual. Puede conservarse por períodos limitados, como hasta 30 días en ciertos casos, por motivos de seguridad y monitoreo de abusos.

2. Entrenamiento de modelos (el punto crítico): Este es el centro del debate sobre la privacidad. Por defecto, OpenAI puede utilizar las conversaciones de las versiones gratuitas y Plus para perfeccionar sus modelos. Sin embargo, el usuario puede desactivar esta opción en la configuración. En ChatGPT Business, Enterprise, Edu, Healthcare y en la API, la herramienta no utiliza los datos para entrenamiento de forma predeterminada.

“Si un empleado introduce un fragmento de código propietario o un plan estratégico de marketing, es lógico pensar que, al entrenar el modelo con información propia, esta podría de alguna forma ser “utilizada” para otros usuarios. Estudios académicos han demostrado que los modelos de lenguaje de gran escala (LLM) pueden memorizar partes de sus datos de entrenamiento y que, bajo ciertas condiciones, esta información puede ser extraída mediante técnicas especializadas.”, agrega Micucci de ESET.

3. Revisión humana: Para garantizar que la IA no genere contenido ofensivo o peligroso, una muestra de conversaciones anonimizadas pasa por revisores humanos. Son especialistas capacitados que leen fragmentos de los diálogos para evaluar la calidad y la seguridad de la respuesta. Es decir, no es solo una máquina la que «lee» lo que se escribe; personas reales pueden tener acceso a partes de las interacciones.

“El mayor riesgo es que la IA «aprenda» patrones de los textos que se le comparten y los reproduzca de forma general en sus respuestas. Dependiendo de la herramienta, el tipo de cuenta y la configuración de privacidad, el contenido puede utilizarse para mejorar modelos futuros. Ingresar información confidencial puede exponer a la pérdida de control sobre información sensible y a riesgos de memorización o extracción de datos ya documentados en investigaciones sobre modelos de lenguaje. Por ello, los planes estratégicos, el código propietario, las credenciales, los datos de clientes o los documentos internos deben utilizarse únicamente en herramientas de IA aprobadas por la empresa y con controles de privacidad adecuados.”, destaca el investigador de ESET.

Además de los riesgos inherentes al procesamiento de datos por parte de la plataforma, ESET advierte que existe una amenaza externa creciente que es el interés de los ciberdelincuentes en las credenciales de acceso a ChatGPT. Dado que las conversaciones suelen contener información sensible, código fuente y estrategias de negocio, una cuenta comprometida se convierte en una oportunidad para el espionaje industrial y el robo de identidad.

Datos de 2024 muestran que más de 225.000 registros de inicio de sesión de ChatGPT fueron encontrados a la venta en foros de la Dark Web. Este volumen masivo de credenciales robadas, a menudo mediante malware del tipo infostealer, demuestra que el peligro no está solo en lo que se escribe, sino en quién puede acceder al historial si una cuenta no está correctamente protegida.

Aunque ChatGPT domina la conversación, el ecosistema de la Inteligencia Artificial Generativa incluye otros grandes actores con enfoques diferentes en la protección de datos. Para los usuarios que se mueven entre distintas plataformas, entender que el riesgo no es universal sino adaptable a cada empresa es el primer paso hacia una postura de seguridad digital consciente.

¿Cómo almacena Gemini su información?

Google Gemini opera dentro de la amplia infraestructura de Google. Según el Centro de Privacidad de Gemini, la empresa utiliza las conversaciones para mejorar sus servicios, lo que incluye revisión por parte de entrenadores humanos.

La diferencia radica en la integración, si se utiliza Gemini dentro del entorno corporativo de Google Workspace, las políticas de privacidad empresarial establecen que los datos no se utilizan para entrenar modelos globales de lenguaje. El proceso de «anonimización» de Google elimina la información de la cuenta, pero el contenido de lo que se escribe puede seguir siendo analizado para mejorar la precisión de las respuestas, a menos que la configuración de actividad de IA se desactive manualmente.

¿Cómo utiliza Claude la información?

Anthropic, con su modelo Claude, presenta una filosofía de «IA Constitucional». En su Política de Privacidad y Términos de Uso, la empresa destaca que la retención de datos se mantiene al mínimo. Claude se distingue por poner mayor énfasis en mecanismos automatizados de alineación del comportamiento de la IA mediante principios automatizados de seguridad.

Para los usuarios de la versión gratuita, los datos pueden usarse para mejorar el modelo, pero Anthropic ofrece un proceso de exclusión (opt-out) más directo para sus clientes comerciales, asegurando que el código fuente o los secretos empresariales enviados a través de la API permanezcan privados.

“La gran similitud entre todos estos modelos es que ninguno funciona como una «bóveda» completamente aislada por defecto. Ya sea en OpenAI, Google o Anthropic, el proceso de aprendizaje automático depende de datos. La verdadera diferencia para tu seguridad radica en el contrato: mientras que en las versiones gratuitas los datos pueden contribuir indirectamente a la mejora del sistema, en las versiones empresariales la privacidad se trata como un servicio premium, donde los datos se procesan, pero no se utilizan para entrenar modelos.”, remarca Micucci.

Para garantizar que la experiencia con herramientas de IA sea productiva y segura, ESET recopiló las principales recomendaciones de protección:

- Protección del comportamiento y anonimización: La herramienta más poderosa de seguridad digital es el propio criterio. La regla de oro es nunca introducir información que no harías pública. Antes de enviar un prompt, realizar una «limpieza» manual: reemplazar nombres de clientes por alias, eliminar valores financieros específicos y ocultar fragmentos de código que contengan claves de acceso o vulnerabilidades de infraestructura. Recordar que una vez que los datos son procesados por el modelo, el «desaprendizaje» de la IA es un proceso técnicamente complejo y no siempre garantizado.

- Gestión de cuentas y protección contra accesos no autorizados: Para evitar que los ciberdelincuentes accedan al historial de conversaciones, es fundamental utilizar contraseñas fuertes y únicas. Activar siempre la autenticación de dos factores (2FA) disponible en la configuración de OpenAI, Google o Anthropic. Además, mantener el sistema operativo y antivirus actualizados para evitar malware del tipo infostealer, principal responsable de la recolección de credenciales de herramientas de IA.

- Configurar la privacidad (Opt-out): No aceptar la configuración predeterminada. Explorar el menú de «Controles de datos» de ChatGPT para desactivar el historial de chat y el entrenamiento de modelos. En el caso de Gemini, gestionar la actividad en «Actividad en apps de Gemini» para decidir qué debe o no almacenar Google. Estas acciones reducen drásticamente la huella digital y ayudan a que las interacciones sean tratadas con mayor confidencialidad.

Chrome para Android permite compartir una ubicación aproximada para mayor privacidad

Google ha implementado una nueva función en Chrome para Android que permite a los usuarios compartir solo su ubicación aproximada en lugar de las coordenadas exactas, brindando mayor control sobre sus datos personales (Fuente Google).

El navegador de Google ha incorporado una alternativa de privacidad cuando los sitios web solicitan permisos de localización. Los usuarios ahora pueden elegir entre compartir su ubicación precisa —ideal para servicios de entrega, mapas o navegación— o una ubicación aproximada que indica únicamente el área general o el vecindario. Esta opción es útil para funciones que no requieren tanta exactitud, como consultar el clima, leer noticias o buscar horarios comerciales, evitando exponer información confidencial a sitios web innecesariamente.

Esta nueva configuración está llegando primero a los dispositivos móviles, y la compañía ha adelantado que se expandirá a la versión de escritorio durante los próximos meses. Paralelamente, Google está desarrollando nuevas herramientas y APIs dirigidas a los desarrolladores web, animándolos a solicitar la ubicación exacta únicamente cuando sea estrictamente necesaria para el funcionamiento del sitio.

#android #arielmcorg #Chrome #google #infosertec #Navegadores #PORTADA #privacidad #tecnologia