OpenZL komprimiert Daten anhand ihrer Struktur - LinuxCommunity

OpenZL komprimiert Daten anhand ihrer Struktur - LinuxCommunity

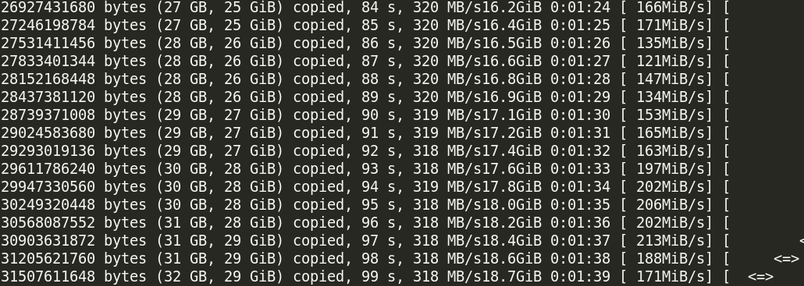

Meta hat ein neues quelloffenes Framework vorgestellt, das Dateien anhand ihrer Inhalte passend komprimiert. OpenZL arbeitet dabei verlustfrei und besonders schnell, setzt allerdings auch (stark) strukturierte Daten voraus. Daten lassen sich besonders effizient und stark komprimieren, wenn man ihren Aufbau kennt. Wiederholen sich beispielsweise Felder in einer Tabelle, kann ein auf solche Situationen spezialisierter Algorithmus deutlich bessere Kompressionsergebnisse erzielen, als etwa die Allround-Verfahren Zstd und XZ. OpenZL stürzt sich daher mit zusätzlichem Wissen auf die zu komprimierenden Daten: Anwender liefern dem Framework zunächst eine Beschreibung über den Aufbau der Daten. Dabei kommt derzeit die Simple Data Description Language (SDDL) zum Einsatz. Anhand der in ihr notierten Beschreibung erstellt ein sogenannter Trainer automatisch eine passende Komprimierungsstrategie. Diesen Plan nutzt OpenZL, um die Datenmenge maßgeschneidert einzudampfen. Alle zum Entpacken nötigen Informationen speichert das Framework in der komprimierten Datei. Mit diesem „Dekodierrezept“ kann dann das Entpackwerkzeug die Daten wieder aus dem Archiv holen. Das Rezept hat dabei den Vorteil, dass ein universelles Entpackwerkzeug ausreicht und man nicht extra für jedes Dateiformat ein eigenes Tool benötigt. Die von den OpenZL-Entwicklern veröffentlichten Messungen lesen sich beeindruckend: Astronomische Daten aus den Beispieldaten des Silesia Compression Corpus stampfte OpenZL um den Faktor 2 ein, wohingegen Zstd die Datenmenge nur um den Faktor 1,31 verkleinerte. Auch bei der Arbeitsgeschwindigkeit ist OpenZL nicht zu schlagen. Während Zstd 220 MByte pro Sekunde verarbeitet, kommt OpenZL auf 340 MByte pro Sekunde. An die Grenzen stößt das Verfahren, wenn kaum oder keine Informationen über den Aufbau der Daten vorliegen. OpenZL fällt dann derzeit einfach auf das Zstd-Verfahren zurück. Der Quellcode des OpenZL-Frameworks steht unter einer liberalen BSD-Lizenz auf GitHub bereit. Da die Entwicklung von OpenZL derzeit auf Hochtouren läuft, sollte man die aktuelle Version 0.1.0 noch mit Vorsicht genießen. Die Entwickler weisen explizit darauf hin, dass sich alle Bestandteile ihres Frameworks garantiert noch ändern werden.