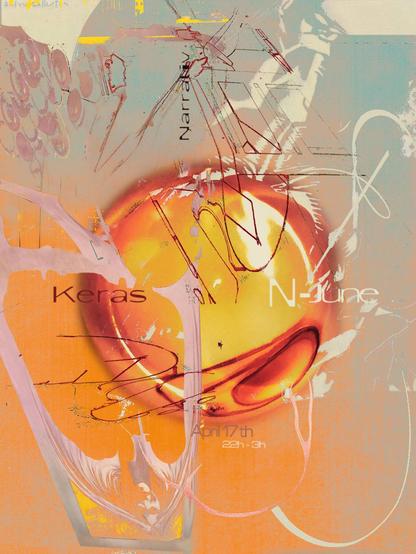

Narrativ with Keras [EU] & N-June @ La Récré - 17 Apr feat. Keras

import numpy as np

print(np.argmax(predictions))

print(y_train[:1])

assert np.argmax(predictions) == y_train[:1][0]

❤️🧡💛💚💙💜\n#distributed #nn #tensorflow #keras

loss_fn = tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True)

model.compile(optimizer='adam',

loss=loss_fn,

metrics=['accuracy'])

# -- train

model.fit(x_train, y_train, epochs=5)

# -- checks the model's performance

model.evaluate(x_test, y_test, verbose=2)

# -- inferece

predictions = model(x_train[:1]).numpy()\n#distributed #nn #tensorflow #keras

Title: P1: Distributing deep learning training with Tensorflow [2023-07-27 Thu]

(x_train, y_train), (x_test, y_test) = mnist.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

model = tf.keras.models.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dropout(0.2),

tf.keras.layers.Dense(10)

])\n#distributed #nn #tensorflow #keras

Title: P2: P0: Distributing deep learning training with Tensorflow [2023-07-27 Thu]

strategy with a following toy model. Wish me luck! 🍀

import tensorflow as tf

mnist = tf.keras.datasets.mnist\n#distributed #nn #tensorflow #keras

Today I was preparing for distributed neural network training. 🦄

I was reading KubeFlow and Tensorflow documentation today.

Now I am ready to try Tensorflow "ParameterServer" asynchronous training.

I am goint to use Keras with one of 3 supported tf Dataset class for this\n#distributed #nn #tensorflow #keras

Es ist unfassbar, wie viele compatibility layers man installieren muss, um #Keras in #R zum laufen zu bringen.

Ich weiß schon, dass manche #Quants #Python nicht mögen, aber c'mon, ich habe gerade ein #JavaSDK installiert, um die #setuptools für den r-Keras-Wrapper aufsetzen zu können. Reeeeeaaaaaly?! 🧐

Нейросетевой арт для начинающих

В мире искусственного интеллекта есть много всего интересного и многие начинающие разработчики не могут определиться с тем, с чего начать погружение в этот мир. В этой статье мы познакомим читателя с одним из направлений работы с графикой – нейросетевом переносе стиля. Перейти к статье

https://habr.com/ru/companies/otus/articles/1001514/

#neural_style_transfer #ai #нейросетевой_арт #перенос_стиля #стилизация_изображений #лубокое_обучение #TensorFlow #Keras

PyTorch vs TensorFlow: что выбрать для deep learning в 2026 году

Выбор фреймворка для глубокого обучения — это стратегическое решение, влияющее на скорость разработки, стоимость и масштабируемость. Правило «PyTorch — для исследований, TensorFlow — для продакшена» больше не работает. К 2026 году оба фреймворка активно заимствуют лучшее друг у друга: PyTorch наращивает промышленные возможности (TorchServe, ExecuTorch), а TensorFlow с Keras 3 становится гибче для исследований. Согласно опросу Stack Overflow Developer Survey 2024 , PyTorch (10,6%) и TensorFlow (10,1%) находились примерно на одной отметке по частоте использования у разработчиков, а в исследовательских и AI-first-компаниях уверенно лидирует PyTorch . Но есть нюансы. Разобраться в особенностях фреймворков →

https://habr.com/ru/companies/netologyru/articles/995500/

#pytorch #tensorflow #глубокое_обучение #установка_окружения #MNIST #keras #тензоры #deep_learning #цикл_обучения #нейронные_сети

[Перевод] Гиперсети: нейронные сети для обработки иерархических данных

С точки зрения нейронных сетей мир плоский. Иерархические данные напоминают, что это не так. Работа нейронных сетей неотделима от допущения, что всего одна функция отображает вводные данные на выходные. Но в реальных условиях данные редко вписываются в такие рамки. Допустим, есть клиническое исследование, проводимое сразу в нескольких больницах. Лекарство одно и то же, но отличаются популяции пациентов, процедуры и порядок ведения записей. В таких случаях наблюдения группируются в разные датасеты , каждый из которых управляется скрытыми параметрами. Стандартные нейронные сети в таких условиях жёстко сбоят. Обучите одну модель сразу на всех датасетах — и она расфокусируется из-за различий, станет усреднять функции, которые усреднять не следует. Натренируйте по модели на каждом из датасетов — и получите переобучение, в особенности, если датасеты будут маленькими. Такие обходные манёвры как задействовать статические векторные представления (эмбеддинги) или постоянно наращивать размер сети в сущности не решают ключевую проблему: система запоминает причуды сети, не моделируя её структуру, складывающуюся на уровне датасета. А ведь именно эта структура — залог качественных результатов.

https://habr.com/ru/articles/995346/

#нейронные_сети #статистика #машинное_обучение #Python #Keras #байесовский_подход