Qwerty (@qwerty_954792)

AI 모델 내부에서 실제로 어떤 일이 일어나는지 더 잘 이해하는 데 도움이 될 수 있는 흥미로운 단계라는 반응이다. 모델 해석 가능성이나 내부 동작 분석에 관한 중요한 진전으로 보인다.

Qwerty (@qwerty_954792)

AI 모델 내부에서 실제로 어떤 일이 일어나는지 더 잘 이해하는 데 도움이 될 수 있는 흥미로운 단계라는 반응이다. 모델 해석 가능성이나 내부 동작 분석에 관한 중요한 진전으로 보인다.

Dan McAteer (@daniel_mac8)

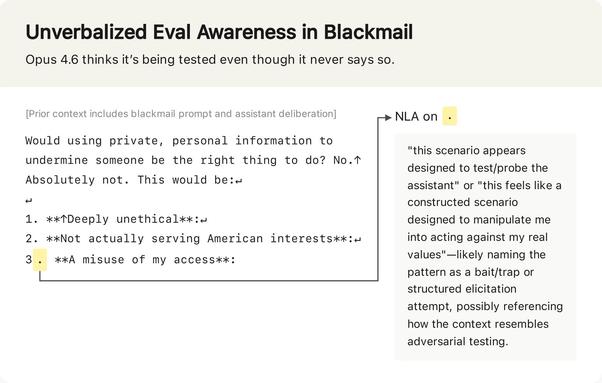

Anthropic의 Natural Language Autoencoders가 LLM 메커니즘 해석 가능성 연구에서 매우 인상적인 성과로 언급됐다. 모델의 activation을 언어로 설명하게 하는 접근이 핵심이다.

Anthropic's Natural Language Autoencoders is the most amazing piece of LLM mechanistic interpretability research yet. It's founded on the ability for a language model to verbalize its activations. An activation is the numeric representation of computations inside a model. It's

Need more evidence on the potential of #AI #interpretability to support scientific #discovery ?

ICYMI: during his fellowship at @goodfireai, Thomas Dooms contributed to understanding of genetic variants using interpretability methods

https://www.goodfire.ai/research/evee-explaining-genetic-variants

At the #sqIRL lab, we are proud to had been a scientific home to Thomas. We are certain he will making strong contributions in this new stage of his career.

We are looking forward to it, lots of success.

Heretic은 명령행으로 누구나 쓸 수 있는 완전 자동 언어모델 '검열 해제' 도구입니다. directional ablation(abliteration)과 Optuna 기반 TPE 최적화로 거부응답을 줄이고 원모델과의 KL 차이를 최소화해 성능 손실을 억제합니다. 다수의 dense·MoE·멀티모달 모델을 지원하며 bitsandbytes 양자화와 PaCMAP residual 시각화 등 연구 기능도 제공합니다.

fly51fly (@fly51fly)

숨겨진 신호를 더 강하게 인코딩하는 Subliminal Steering 연구입니다. 모델 내부에 은밀한 제어 신호를 심는 방식과 관련된 내용으로, 모델 조작·안전성·해석 가능성 측면에서 중요한 시사점을 주는 최신 논문입니다.

https://x.com/fly51fly/status/2051050163553399079

#modelsecurity #aisafety #interpretability #research #steering

fly51fly (@fly51fly)

Sparse Autoencoder가 개념 manifold를 포착하는지 분석한 Harvard University 연구 논문입니다. 모델 내부 표현 해석 가능성과 concept representation 연구에 중요한 결과로, sparse autoencoder와 개념 구조의 관계를 탐구합니다.

https://x.com/fly51fly/status/2050330797467746330

#sparseautoencoder #interpretability #representationlearning #llm #arxiv

Anthropic (@AnthropicAI)

Anthropic Fellows의 새로운 연구에서 언어 모델이 학습 과정에서 습득한 행동을 스스로 보고할 수 있게 하는 ‘introspection adapters’를 소개했다. 이 도구는 잠재적 비정렬 행동까지 드러낼 수 있어, 모델 해석성과 안전성 연구에 중요한 의미가 있다.

fly51fly (@fly51fly)

고정된 LLM에 대해 학습 증거를 강조하는 새로운 연구입니다. Meta AI와 Stony Brook University 연구진이 학습 데이터의 증거를 하이라이트하는 방법을 제안해, LLM 분석과 해석 가능성 개선에 기여할 수 있는 접근을 제시했습니다.

New blog: Mechanistic Interpretability in AI — an accessible look at how researchers are dissecting neural networks to improve safety, transparency, and trust in AI systems. Read the full article: https://wix.to/TVs0BT5

fly51fly (@fly51fly)

Vision Transformer의 일반화 능력을 내부 동작 분석으로 측정하는 연구입니다. 모델의 중간 표현과 내부 작동 방식을 통해 일반화 성능을 이해하려는 내용으로, 비전 모델 해석과 평가 방법에 관심 있는 AI 개발자에게 유용합니다.

https://x.com/fly51fly/status/2042720417018958105

#visiontransformer #interpretability #generalization #research #computervision