#DocumentAI #KI #Ausschreibung #Automation #BusinessAI

#DocumentAI #KI #Ausschreibung #Automation #BusinessAI

Ein spannendes Thema ist aktuell die Verbindung von KI mit bestehenden Unternehmensprozessen statt isolierter Chatbots.

Besonders interessant finde ich:

- KI-gestützte Dokumentation

- intelligente Kundenanfragen

- Workflow-Automatisierung

- AI Agents

- semantische Suche über Unternehmenswissen

#Automation #WorkflowAutomation #AIAgents #DocumentAI #BusinessAI #KI

田中義弘 | taziku CEO / AI × Creative (@taziku_co)

PDF 파일을 업로드하면 이력서, 청구서, 제안서 등을 더 신뢰감 있는 전문 문서처럼 보이게 바꿔주는 기능이 소개됐다. 내용은 그대로 두고 시각적 완성도를 높여 성공률을 높이려는 AI 기반 문서 개선/디자인 활용 사례다.

AISatoshi (@AiXsatoshi)

클라우드에 업로드할 수 없는 문서를 대상으로 근접 독해와 동료 교정을 지원하는 앱을 만들고, Dense 모델을 활용해 독해 해상도를 점검하는 작업을 진행했다.

Abhishek Yadav (@abhishek__AI)

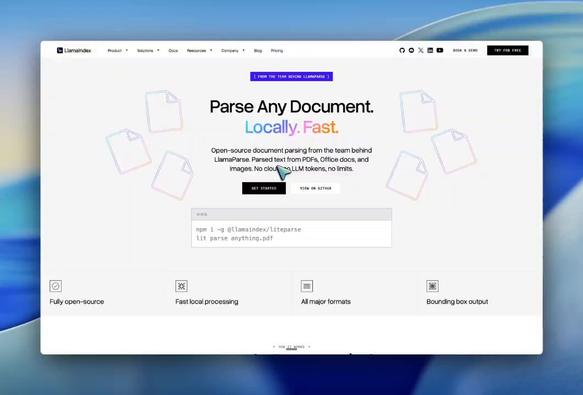

LiteParse는 클라우드 의존성 없이 동작하는 가벼운 오픈소스 PDF 파서로, 내장 OCR, JSON/Text 출력, 이미지·문서·PDF 처리, LLM용 스크린샷 생성, 바운딩 박스 기반 공간 텍스트 추출을 지원합니다. 문서 파싱과 멀티모달 입력 처리에 유용한 신규 도구입니다.

AISatoshi (@AiXsatoshi)

NVIDIA의 Nemotron OCR v2가 소개됐다. 이미지 내 문자 위치를 찾고, 텍스트를 읽어 문자열로 변환하며, 레이아웃과 읽기 순서까지 이해한다. 여러 줄 문서, 다중 블록 레이아웃, 간판·풍경 속 문자 등 복잡한 실제 OCR 환경에 대응하는 모델이다.

SB Intuitions (@sbintuitions)

문서 이미지 분석에 특화된 OCR 모델 Sarashina2.2-OCR가 공개되었으며, 레이아웃 보존, Markdown 변환, 일본어 세로쓰기 문서 지원, 표·그림 검출 기능을 제공한다.

MiniMax (official) (@MiniMax_AI)

사무용 에이전트 개발을 위한 오픈소스 스킬을 공개했다. PDF, Excel, PPT, Word 등 문서 작업에 활용할 수 있는 기능으로, AI 에이전트의 업무 자동화와 문서 처리 역량을 높이는 데 유용한 도구로 보인다.

Akshay (@akshay_pachaar)

새로운 OCR 모델이 공개되었으며, olmocr 벤치마크에서 85.9% SOTA를 달성했습니다. 90개 이상의 언어를 지원하고, 모델 크기는 9B에서 4B로 줄었지만 레이아웃 정보, 이미지·도표 캡션 추출, 필기/수식/폼/표 인식 성능이 강합니다. 100% 오픈소스입니다.

Akshay 🚀 (@akshay_pachaar) on X

Everyone is sleeping on this new OCR model! - 85.9% (sota) on olmocr bench - 90+ language support w/benchmarks - 4B model (down from 9B) - Full layout information - Extracts + captions images and diagrams - Strong handwriting, math, form, table support 100% open-source.

Nathan (@nathanhabib1011)

@VikParuchuri 팀이 신규 OCR 모델 Chandra OCR 2를 공개했다. olmocr 벤치마크 1위(85.9%)를 기록했고, 90개 이상 언어 지원, 40억 파라미터 규모, 레이아웃 정보 추출, 이미지·도표 캡션 생성, 필기·수식·양식 인식 강화 등 문서 이해 기능이 크게 향상됐다.

Nathan (@nathanhabib1011) on X

NEW SOTA OCR MODEL DROPPED Congrats to @VikParuchuri and team for releasing Chandra OCR 2! - 85.9% on olmocr bench, making it first place 🏆 - 90+ language support - 4B model - Full layout information - Extracts + captions images and diagrams - Strong handwriting, math, form,