DeepInfra raises $107M Series B

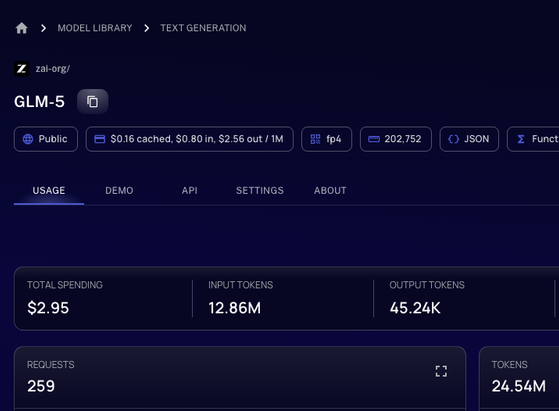

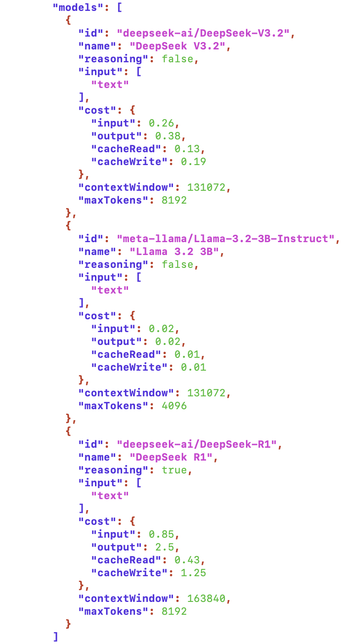

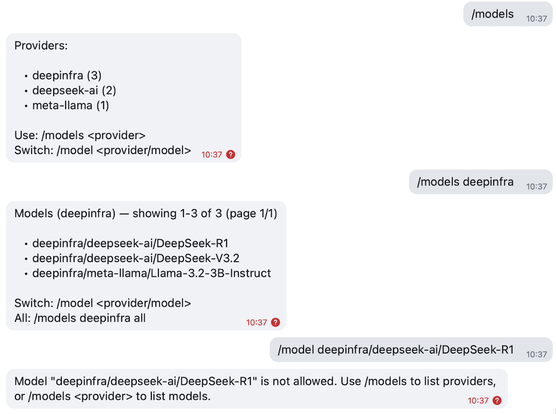

DeepInfra가 1억 700만 달러 규모의 시리즈 B 투자를 유치하여 글로벌 추론 클라우드 인프라 확장에 나선다. 이 회사는 에이전트 기반 AI의 지속적이고 대량의 토큰 생성 수요에 대응하기 위해 GPU 하드웨어부터 네트워킹, 소프트웨어까지 통합 설계된 추론 전용 스택을 구축했다. NVIDIA와 협력해 최신 GPU와 추론 소프트웨어를 도입하며 최대 20배의 비용 효율 개선을 목표로 한다. DeepInfra는 오픈소스 모델과 에이전트 AI 워크로드에 최적화된 엔터프라이즈급 추론 서비스를 제공하며, 이번 투자로 글로벌 컴퓨팅 용량과 개발자 도구를 강화할 계획이다.