Dan McAteer (@daniel_mac8)

AISI가 테스트한 Mythos 체크포인트가 지난달 공개된 결과를 만든 모델보다 더 최신 버전이었다는 점이 언급됐다. 지난달 결과는 Mythos의 학습 완료 이전 체크포인트에서 나온 것으로, Glasswing 체크포인트가 관련 기준점으로 지목됐다.

Dan McAteer (@daniel_mac8)

AISI가 테스트한 Mythos 체크포인트가 지난달 공개된 결과를 만든 모델보다 더 최신 버전이었다는 점이 언급됐다. 지난달 결과는 Mythos의 학습 완료 이전 체크포인트에서 나온 것으로, Glasswing 체크포인트가 관련 기준점으로 지목됐다.

Comunque, GPT-5.5 si conferma tra i modelli più forti in ambito cyber non perché sia “magico”, ma perché integra meglio ragionamento lungo orizzonte, coding e autonomia.

I test #AISI mostrano alti pass‑rate su CTF avanzati e la capacità di orchestrare attacchi end‑to‑end in cyber‑range realistici, segnale che le capacità offensive emergono naturalmente dai miglioramenti generali.

GPT-5.5 übertrifft Claude Mythos Preview bei Experten-Aufgaben und erreicht eine Erfolgsquote von 71,4 Prozent.

Das AISI testete 95 CTF-Herausforderungen. GPT-5.5 bewältigte einen 32-stufigen Netzwerkangriff in zwei von zehn Versuchen vollständig. Ein Red Team entwickelte in sechs Stunden einen universellen Jailbreak.

#GPT5 #OpenAI #CyberSecurity #AISI #AIGeneratedImage

https://www.all-ai.de/news/news26top/gpt-5-5-claude-mythos-security

📢 Spyware Paragon/Graphite en Italie : enquêtes judiciaires, contrats AISI/AISE et contradictions institutionnelles

📝 ## 🗓️ Contexte

Source : Wired Italia, publié le 28 avril 2026.

📖 cyberveille : https://cyberveille.ch/posts/2026-05-01-spyware-paragon-graphite-en-italie-enquetes-judiciaires-contrats-aisi-aise-et-contradictions-institutionnelles/

🌐 source : https://www.wired.it/article/paragon-spyware-risposte-indagine-italia-procura/

#AISE #AISI #Cyberveille

🗓️ Contexte Source : Wired Italia, publié le 28 avril 2026. L’article fait le point sur l’avancement de l’affaire Paragon/Graphite en Italie, un scandale de surveillance impliquant des journalistes et des activistes ciblés par le spyware Graphite développé par la société israélienne Paragon Solutions. 📱 Victimes identifiées 29 avril 2025 : Apple envoie des notifications à des clients italiens les avertissant d’être ciblés par « un attaquant sophistiqué », sans préciser le nombre ni impliquer explicitement Paragon. Ciro Pellegrino, journaliste de Fanpage, reçoit en juin 2025 du Citizen Lab la confirmation de traces de Graphite sur son téléphone, « avec un haut degré de confiance ». Les analyses techniques déposées en février 2026 auprès des parquets de Rome et Naples révèlent des anomalies compatibles avec une activité de Graphite dans les bases de données WhatsApp liées à trois téléphones Android : ceux de deux activistes de Mediterranea et de Cancellato. 📄 Contrats et acteurs institutionnels Deux contrats entre Paragon et les autorités italiennes ont été identifiés, pour un montant total de 2 millions d’euros : Un contrat avec l’AISI (renseignement intérieur) Un contrat avec l’AISE (renseignement extérieur), jugé le plus significatif car permettant d’intercepter un plus grand nombre de cibles, y compris à l’étranger. L’enquête s’articule également autour de Giuseppe Del Deo, ex-directeur adjoint du DIS (Département des informations pour la sécurité), soupçonné d’avoir utilisé des bases de données et outils des services secrets « à des fins privées ». Le décret de perquisition du 17 avril 2026 mentionne un « produit israélien ». ⚖️ Renvoi de responsabilités Paragon affirme (via Haaretz, février 2025) avoir proposé aux autorités italiennes une vérification des faits et avoir résilié les contrats après leur refus. Le Copasir (comité parlementaire de surveillance des services secrets) conteste cette version, affirmant que la rupture était mutuelle et que la vérification pouvait être conduite de manière autonome. Les services de renseignement italiens eux-mêmes ont conseillé au Copasir de refuser le soutien de Paragon, jugeant cette proposition « inacceptable » car susceptible de compromettre l’image de l’intelligence italienne et d’exposer des données classifiées. Le Copasir a menacé de rendre publique l’audition de Paragon, sans jamais le faire. Le Copasir a conclu que le journaliste Cancellato n’avait pas été espionné par les services secrets via Graphite, et ne s’est jamais penché sur le cas de Ciro Pellegrino. 🔍 Type d’article Article de presse spécialisée à visée investigative, documentant l’état d’avancement des enquêtes judiciaires et parlementaires italiennes sur l’utilisation du spyware Graphite par des entités étatiques italiennes.

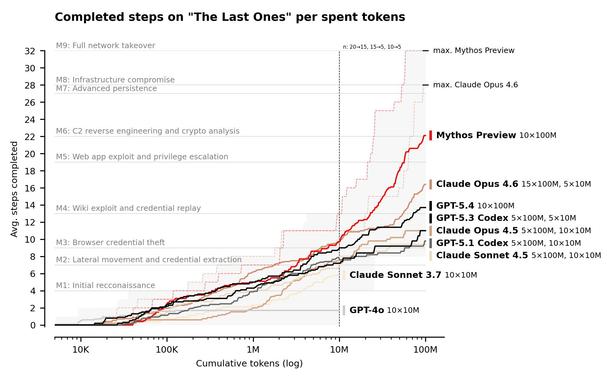

The evaluation of #Anthropic #Mythos by #AISI #UK, does not seem to demonstrate the super-cracking ability mentioned elsewhere. It is noted its specific ability to chain attacks.

https://www.aisi.gov.uk/blog/our-evaluation-of-claude-mythos-previews-cyber-capabilities

AI Leaks and News (@AILeaksAndNews)

AISI의 사이버 평가에서 Claude Mythos가 AISI 사이버 레인지를 엔드투엔드로 완주한 첫 모델로 확인됐다. 32단계의 기업 네트워크 공격 시나리오를 초기 정찰부터 전체 장악까지 수행해, 사이버 능력에서 큰 진전을 보였다고 평가됐다.

AISI have conducted cyber evaluations of Claude Mythos and found that it is the first model to complete an AISI cyber range end-to-end  The range simulates a 32-step corporate network attack, from initial reconnaissance to full network takeover Mythos is a step change in AI

TIL that the federal government had committed to establishin an AI Safety Institute (AISI) when it signed the Seoul Declaration at South Korea’s AI summit in 2024. To date, nothing concrete has been put in place. Cam Wilson’s article brings us up to date with what this AISI is all about and the different ‘camps’ alligned to different attitudes towards #GenAISlop lobbying about it.

I have to say I’m currently with the realist ‘here-and-now’ group.

The article is behind a ‘subscribe for free’ wall unfortunately.

https://www.crikey.com.au/2026/03/02/australia-ai-safety-institute-aisi-artificial-intelligence/

#AISI #SeoulDeclaration #TechBros #AIBubble #TechDisaster #CopyrightViolion #OnlineSafety #ToxicTech

Should Australia's AI safety institute focus on future risks, present dangers or working with its international counterparts? It's a big question for any agency — let alone for a new agency with no enforcement powers.

هوش مصنوعی متقاعد میکند اما دروغ میگوید

🤖 مطالعه جدید نشان میدهد چتباتها بهراحتی باورهای سیاسی کاربران را تغییر میدهند. ⚠️ هرچه هوش مصنوعی متقاعدکنندهتر باشد، احتمال اشتباه اطلاعات آن بیشتر است. 📉 مدلهای با ارجاع زیاد به شواهد، اغلب دقت کمتری دارند. 🔍 پژوهشگران هشدار میدهند این پدیده برای جامعه خطرناک است. #هوش_مصنوعی, #چت_بات, #متقاعدسازی, #دقت_اطلاعات, #AI, #Chatbot, #سیاست, #تحقیق, #Science, #ایمنی_هوش_مصنوعی, #AISI, #دروغ, #دستکاری_اطلاعات

https://kokchapress.com/55511/?utm_source=mastodon&utm_medium=jetpack_social

Android 16 ląduje na tańszych Nothingach. Nothing OS 4.0 dla modeli (3a) i (3a) Pro

Carl Pei i jego zespół nie zwalniają tempa. Zaledwie tydzień po udostępnieniu stabilnej wersji Nothing OS 4.0 dla flagowego modelu Phone (3), aktualizacja oparta na Androidzie 16 trafia do użytkowników tańszych urządzeń.

To świetna wiadomość dla posiadaczy modeli Nothing Phone (3a) oraz (3a) Pro, którzy nie muszą czekać miesiącami na najnowsze funkcje.

Nothing przedstawia Phone (3a) i Phone (3a) Pro

Nothing OS 4.0 to spora ewolucja nakładki, która przynosi nie tylko nowości z samego Androida 16, ale też autorskie rozwiązania producenta. Aktualizacja jest już udostępniana w kanale stabilnym, choć producent zaznacza, że wdrażanie odbywa się etapami – na początek trafi do ograniczonej liczby użytkowników, by wykluczyć ewentualne błędy krytyczne.

Nothing udostępniania najnowszy system Nothing OS 4.0

Co nowego w Nothing OS 4.0?

Lista zmian jest obszerna i prezentowaliśmy więcej szczegółów we wcześniejszym materiale o Nothing OS 4.0. Dla przypomnienia: najciekawszą nowością wydaje się pulpit nawigacyjny użycia AI. W dobie wszechobecnej sztucznej inteligencji Nothing stawia na transparentność – system automatycznie śledzi, jak i kiedy wykorzystywane są duże modele językowe (LLM) w telefonie.

Oto najważniejsze zmiany:

Pojawił się też Playground (w wersji Alpha) – przestrzeń dla społeczności, gdzie użytkownicy mogą dzielić się własnymi profilami korektora dźwięku czy ustawieniami aparatu.

Jeśli posiadasz Nothing Phone (3a) lub (3a) Pro, warto zajrzeć do ustawień aktualizacji. Pamiętajcie jednak o wykonaniu kopii zapasowej danych przed instalacją nowej wersji systemu.

Nothing Phone (3) – wyjmujemy z pudełka i pierwsze wrażenia

#aiSi #aktualizacja #android16 #glyphInterface #news #nothing #nothingOs #nothingPhone3a #smartfony