Na, da bin ich aber baff. Wer hätte damit auch gerechnet.

Ich kann das alles nicht mehr.

Colloseus

- 50 Followers

- 219 Following

- 917 Posts

Hahaha … der erste Geschäftsführer im Nahfeld verbietet seinem Team die Nutzung von „KI”. Eine Überprüfung der gesetzten und erreichten Ziele habe ergeben, dass zu viel wertvolle Arbeitszeit mit den eingesetzten LLM verdaddelt wurde und damit nur oberflächliche Ergebnisse ohne die notwendige Tiefe erreicht wurden. Zudem sei keine stabile Wiederholbarkeit gegeben.

Ja guck … manch einer merkts ja doch recht flott.

Auch in der vermeintlichen Green City #Freiburg wird bei neu geplanten Straßen immer noch zuerst der Platz fürs Auto berücksichtigt, dann folgt der Platz fürs Fahrrad und am Ende der Kette erhält den Rest der Fußweg, kritisiert Jörg Isenberg @FR_Entscheid und @vcdsuedbaden in unserer Diskussion zur Verkehrspolitik anlässlich der kommenden OB Wahl @freiburg . Am Schlossbergring wird, so Isenberg, in der neuen Planung der Fußweg unter den bundesweiten Soll-Breiten liegen, an einer Stelle wird wohl auch der Radweg unter der Soll-Breite liegen. Von den Kandidierenden waren Monika Stein und @dejan anwesend. Monika Stein kündigte an, beim Stadttunnel noch einmal eine Bürgerbeteiligung machen zu wollen. @dejan will generell versuchen die Stadtgesellschaft mehr in die Entscheidungen zur #Verkehrswende einzubeziehen. OB Martin Horn hatte uns für die Debatte leider nicht zugesagt. Am 1. April wird er aber an einer Debatte zur Wohnungspolitik teilnehmen, dann u.a. mit @ras_freiburg. Die gesamte RDL Debatte zur Verkehrspolitik könnt ihr hier nachhören: https://rdl.de/beitrag/wie-k-nnen-verkehrsbedingte-co-emissionen-freiburg-reduziert-werden-diskussion-vor-der-ob

AI-driven manipulation comes in three forms, each tested in our research:

• Deepfake videos

• AI-generated misinformation articles

• Personality-targeted political ads

We ran multiple preregistered experiments to see if warnings protect people.

Spoiler: They largely don't.

2/10

Gestern gelernt

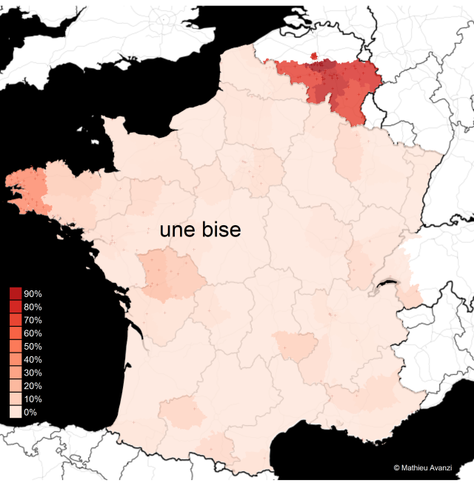

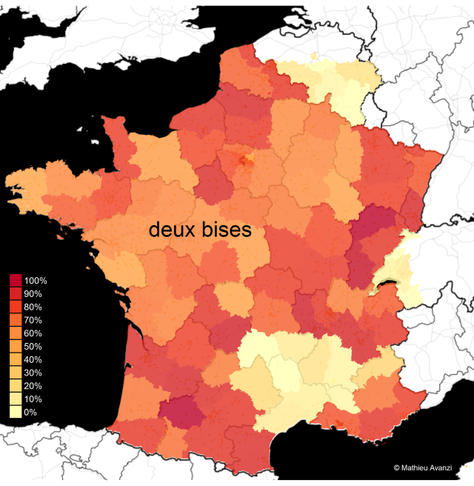

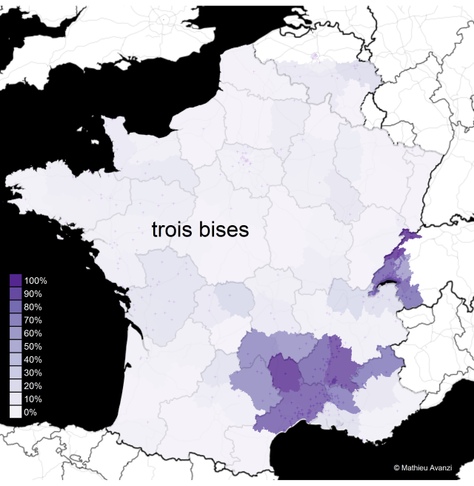

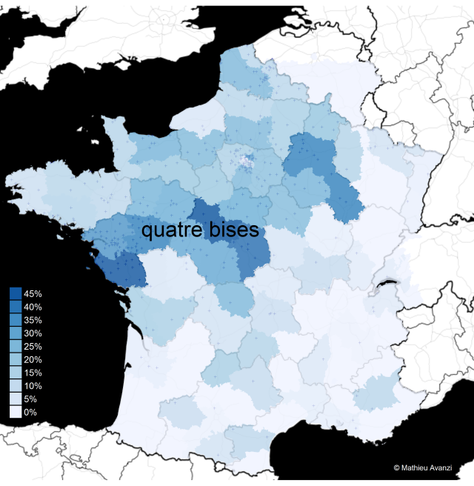

In Frankreich gibt es Karten, auf denen eingezeichnet ist, in welchen Regionen sich bei der Begrüßung wie oft geküsst wird. Ich finde, das solltet ihr wissen...

Bildquelle:

https://francaisdenosregions.com/2016/12/21/la-carte-des-bises/?amp=1

Jahrelang mussten wir uns anhören, dass es keine Regeln außer den Emissionshandel im Klimaschutz braucht, weil wenn der Emissionshandel erstmal da ist, regelt das der Markt.

Nun ist der Emissionshandel in seiner Wirkung im Markt angenommen, funktioniert und wer hätte das gedacht? Er soll weg.

🤦

Das WZB-Projekt „Wirksam gegen Rechtsaußen" hat Strategien von zivilgesellschaftlichen Institutionen in der Auseinandersetzung mit Rechtsextremismus untersucht und systematisiert. Den neuen Policy Brief dazu gibt es hier: https://www.wzb.eu/de/news/policy-brief-strategien-gegen-rechtsaussen-untersucht

RE: https://rheinhessen.social/@mainzer_brett/116022680556161681

Diesen Samstag! 🎉🤗🀄 #mainz #brettspieltreffen #brettspiele

People keep assuring me that LLMs writing code is a revolution, that as long as we maintain sound engineering practices and tight code review they're actually extruding code fit for purpose in a fraction of the time it would take a human.

And every damned time, every damned time any of that code surfaces, like Anthropic's flagship offering just did, somehow it's exactly the pile of steaming technical debt and fifteen year old Stack Overflow snippets we were assured your careful oversight made sure it isn't.

Can someone please explain this to me? Is everyone but you simply prompting it wrong?

It's a good thing programmers aren't susceptible to hubris in any way, or this would have been so much worse.

Thing about April Fool's Day is, a lot of it was media-driven, and that only worked when people thought the media was generally trustworthy. "Here's one day a year when you can't believe what you read!!!" no longer lands quite the same