金のニワトリ (@gosrum)

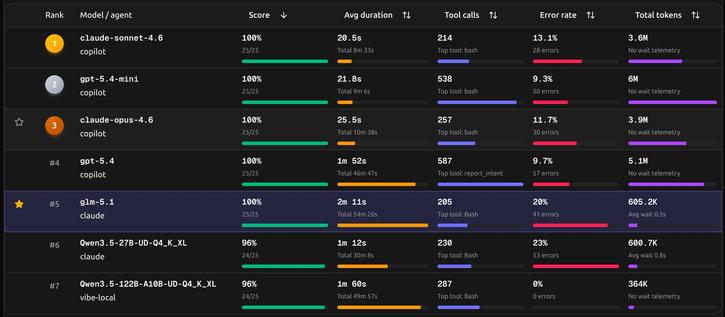

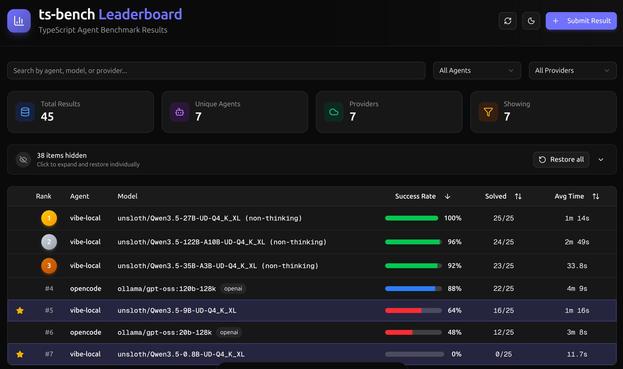

GLM-5.1의 ts-bench 벤치마크 결과를 공유했다. 다른 로컬 LLM도 만점을 받은 적은 있지만, GLM-5.1은 N=3 조건에서 일관되게 만점을 기록한 첫 로컬 LLM이라고 강조한다.

https://x.com/gosrum/status/2041709112661008859

#glm #benchmark #localllm #tsbench #llm

金のニワトリ (@gosrum) on X

GLM-5.1のベンチマーク結果(ts-bench)

他のローカルLLMでも満点取れることはあったけど、glm5.1は安定して満点を取れる最初のローカルLLM(N=3)

金のニワトリ (@gosrum)

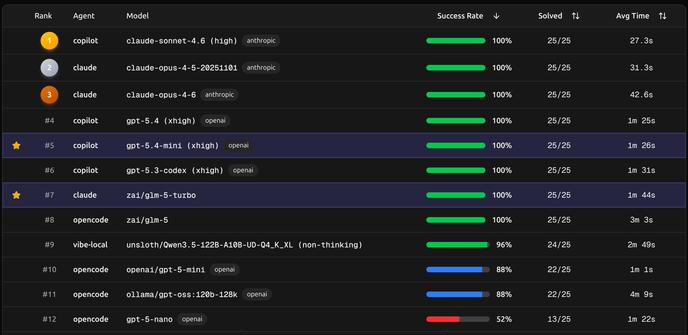

gpt-5.4-mini의 ts-bench 벤치마크 결과를 공유함. 만점이 보편화되어 비교가 어려운 상황이지만, 적어도 gpt-5-mini(10위)보다 상당히 성능이 높아진 것이 분명하다고 보고. 어제 평가한 glm-5-turbo 결과도 함께 추가했음.

https://x.com/gosrum/status/2034060610913382606

#gpt5.4 #gpt #glm5turbo #benchmark #tsbench

金のニワトリ (@gosrum) on X

gpt-5.4-miniのts-bench評価結果を取り急ぎ共有

満点が当たり前になってきたので比較が難しいが、少なくともgpt-5-mini(#10)よりもかなり性能が高くなっていることは確か

※ついでに昨日評価したglm-5-turboも追加

金のニワトリ (@gosrum)

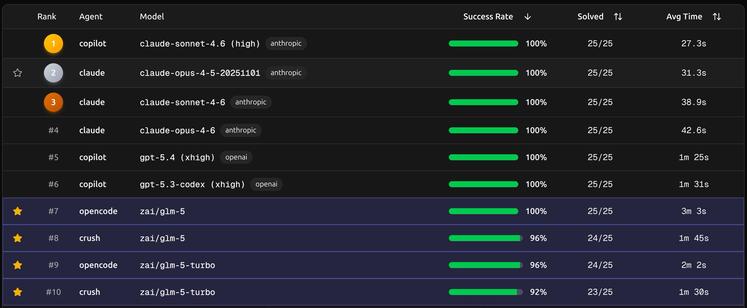

GLM-5-Turbo의 ts-bench 벤치마크 결과를 공유한 내용. 약 10회 테스트에서 GLM-5보다 정확도는 약간 낮지만 실행 속도는 빨라진 것으로 보고되었고, Claude Code와 조합한 결과는 점수가 크게 낮아 해당 조합 결과는 제외되었다고 언급한다.

https://x.com/gosrum/status/2033550008533110937

#glm5turbo #glm5 #benchmark #tsbench

金のニワトリ (@gosrum) on X

GLM-5-Turboのts-bench結果を共有

※Claude Codeとの組み合わせたはかなりスコアが低かったので割愛

計10回ぐらいベンチマークを回したので遅くなってしまった。GLM-5より少しだけ性能が落ちてるけど、確かに速くなっている

金のニワトリ (@gosrum)

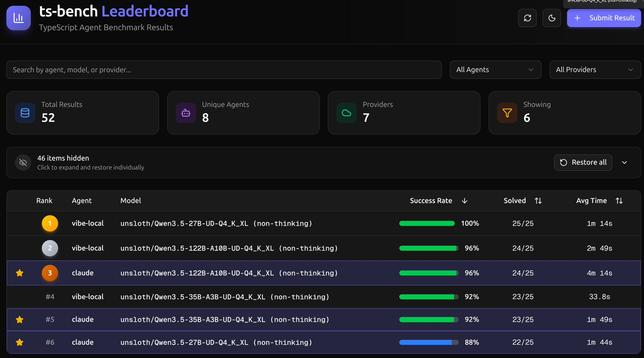

Claude Code와 Qwen3.5 계열(Qwen3.5-122B-A10B/27B/35B-A3B) 조합으로 ts-bench를 돌린 결과를 공유한 내용입니다. Claude Code와 조합해도 현실적인 속도로 동작하지만 스코어를 보면 로컬에서 Claude Code를 돌리려면 100B급 이상의 파라미터가 필요해 보인다는 소견을 남겼습니다.

https://x.com/gosrum/status/2031317423203451005

#claudecode #qwen #benchmarks #localllm #tsbench

金のニワトリ (@gosrum) on X

Claude Code + Qwen3.5-122B-A10B/27B/35B-A3Bで改めてts-benchを回した結果がこちら

【備忘メモ】

・Claude Codeと組み合わせた場合でも現実的な速度で動くようになったが、スコアを見るとやはりClaude CodeをローカルLLMで動かす場合は100B程度以上のパラメータは必要なのかも

金のニワトリ (@gosrum)

Qwen3.5의 ts-bench 결과(9B, 0.8B)를 공유. 9B 모델은 gpt-oss-120b에는 명확히 못 미치지만 해당 파라미터 규모에서 준수한 성능을 보임. 반면 0.8B 모델은 코딩 에이전트 용도로는 실용적이지 않음.

https://x.com/gosrum/status/2028484256759259580

#qwen #benchmark #tsbench #llm

金のニワトリ (@gosrum) on X

取り急ぎQwen3.5-9Bと0.8Bのts-bench結果を共有します

・9B

gpt-oss-120bには明確に劣っている。ただしこのパラメータ量でこのスコアは優秀

・0.8B

さすがにコーディングエージェントでは使えない

金のニワトリ (@gosrum)

GLM-5을 Claude Code와 opencode와 조합한 ts-bench 결과를 발표했습니다. 결론은 GLM-5가 opencode와 함께 사용할 때 더 좋은 성능을 보인다는 것. opencode는 처리 시간이 더 오래 걸리지만 끝까지 시도해 결과를 도출했고, Claude Code는 조기에 포기해 빠른 종료를 보였습니다.

https://x.com/gosrum/status/2021792048404476280

#glm5 #opencode #claudecode #tsbench #benchmark

金のニワトリ (@gosrum) on X

GLM-5 + Claude Code/opencodeと組み合わせたときのts-bench結果発表!

結論:GLM-5はopencodeと組み合わせた方が良さそう

opencodeの方が時間かかってますが、時間をかけてでも諦めずにやりきっているため。

※Claude Codeは早々に諦めたため速い

金のニワトリ (@gosrum)

새로운 스텔스 모델 'Aurora Alpha'의 ts-bench 결과가 공유되었습니다. 작성자는 채팅 실험에서 추론이 빠르게 느껴졌으나 무한 루프에 빠지기 쉬운 점을 관찰했다고 보고했습니다. 성능과 안정성 측면에서 추가 벤치마크가 필요해 보입니다.

https://x.com/gosrum/status/2021020545685565685

#aurora #stealthmodel #tsbench #benchmark

金のニワトリ (@gosrum) on X

新しいステルスモデル「Aurora Alpha」のts-bench結果

チャットでも少し試した印象は以下の通り

・推論が速い(tps自体はそんなに速くないのでthinkingしてない?)

・無限ループに陥りやすい

金のニワトリ (@gosrum)

Step-3.5-Flash 모델에 관심이 있어 ts-bench로 성능 벤치마크를 돌리고 있다는 간단한 언급입니다. 특정 LLM의 성능 검증을 위해 로컬/벤치마크 툴을 사용 중임을 알 수 있습니다.

https://x.com/gosrum/status/2018269364773081370

#step3.5flash #tsbench #benchmark #llm

金のニワトリ (@gosrum) on X

Step-3.5-Flashが気になったのでts-bench回してる

金のニワトリ (@gosrum)

GLM-4.7-flash로 ts-bench를 돌리고 있는데 현재까지 어떤 태스크도 성공하지 못하고 있다고 보고합니다. 자주 사고처럼 '생각의 무한루프'에 빠져 멈추는 현상도 발생한다고 하며, 일단 한 번 전부 돌려보려는 중이라는 내용입니다.

https://x.com/gosrum/status/2013450192755007774

#glm4.7flash #tsbench #llm #modelbug

金のニワトリ (@gosrum) on X

GLM-4.7-flashでts-benchを回しているけど、今の所一つもタスクが成功していない。。。

思考の無限ループに入って止まることもわりと多いが、とりあえず一通り回してみようかな