Polski projekt AI na scenie NVIDIA GTC. Debiutuje Bielik Minitron 7B

Podczas prestiżowej konferencji NVIDIA GTC 2026 w San Jose polska sztuczna inteligencja miała swój ważny moment.

Rodzima fundacja SpeakLeash zaprezentowała projekt Bielik Minitron 7B, wpisując się w globalny trend tworzenia suwerennych i zoptymalizowanych technologii. Prezentacja odbyła się w ramach bloku tematycznego poświęconego idei „Sovereign AI”.

Nowy algorytm to efekt technologicznej współpracy i wykorzystania zaawansowanych narzędzi dostarczonych przez amerykańskiego giganta. Zamiast ścigać się na potężne, pochłaniające ogromne ilości prądu modele, twórcy Bielika postawili na inżynieryjną optymalizację, która ma lepiej odpowiadać na aktualne potrzeby rynku biznesowego.

Skomplikowana inżynieria i mniejsze koszty

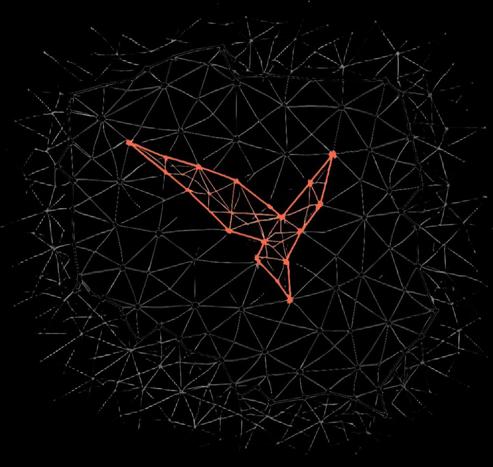

Wykorzystując technologię NVIDIA NeMo oraz metodologię Minitron, dokonano destylacji i przycinania dotychczasowej struktury sieci neuronowej. Jak zapowiedziano podczas prezentacji, zastosowane techniki pozwalają na znaczną redukcję rozmiaru samego modelu oraz drastyczne skrócenie czasu potrzebnego na generowanie odpowiedzi.

Twórcy wskazują, że pomimo tych architektonicznych cięć, system ma zachowywać jakość i dokładność na poziomie zbliżonym do pełnowymiarowych rozwiązań. Wariant o wielkości siedmiu miliardów parametrów (7B) pozycjonowany jest jako złoty środek, łączący zaawansowane zdolności logicznego wnioskowania z szybkością działania wymaganą przy komercyjnych wdrożeniach.

Suwerenność danych w biznesie

Bielik Minitron 7B został zaprojektowany z myślą o lokalnych wdrożeniach w administracji publicznej, ochronie zdrowia, sektorze finansowym oraz edukacji. Sprawniejsze wnioskowanie ma docelowo przełożyć się na użyteczność w rozbudowanych systemach analitycznych czy zautomatyzowanej obsłudze klienta.

Kluczowym aspektem pozostaje promowana na wydarzeniu idea „Open Sovereign AI”. Twórcy stawiają na otwarty model udostępniania technologii, co w założeniu pozwoli rodzimym przedsiębiorstwom na wdrażanie algorytmu na własnych, całkowicie zamkniętych serwerach. Takie podejście daje szansę na zachowanie pełnej kontroli nad firmowymi tajemnicami, minimalizując ryzyko związane z przesyłaniem poufnych danych do zewnętrznych chmur obliczeniowych. To ważny krok w kierunku budowania niezależnych narzędzi dla nowoczesnej gospodarki.

Oto Bielik – Polacy też mają swoją własną AI opartą na LLM

#BielikMinitron7B #modeleLLMDlaBiznesu #NVIDIAGTC2026 #NVIDIANeMo #optymalizacjaAI #polskaSztucznaInteligencja #SpeakLeash #suwerenneAI