Ivan Fioravanti ᯅ (@ivanfioravanti)

MLX의 mlx-lm에 다음 릴리스를 위한 대규모 배치 생성(super batch generation) 개선과 버그 수정이 준비되었다는 소식이다. 다음 버전에서 Gemma 4 지원이 추가되고 v0.32가 곧 릴리스될 가능성이 언급되며, 라이브러리 업데이트가 임박했음을 보여준다.

Ivan Fioravanti ᯅ (@ivanfioravanti)

MLX의 mlx-lm에 다음 릴리스를 위한 대규모 배치 생성(super batch generation) 개선과 버그 수정이 준비되었다는 소식이다. 다음 버전에서 Gemma 4 지원이 추가되고 v0.32가 곧 릴리스될 가능성이 언급되며, 라이브러리 업데이트가 임박했음을 보여준다.

Ivan Fioravanti ᯅ (@ivanfioravanti)

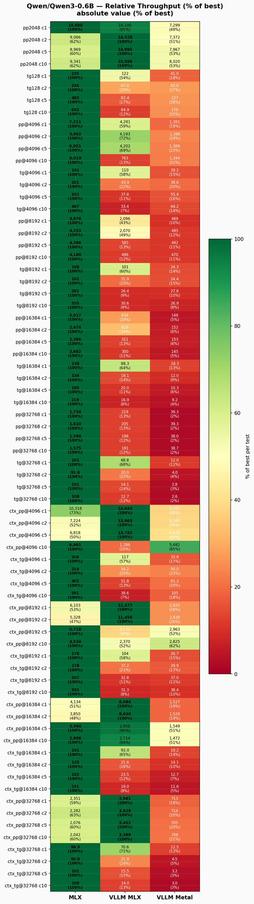

vllm-metal에서 PR 작업을 통해 M3 Ultra에서 최대 32K 컨텍스트로 Qwen3-0.6B 테스트를 실행한 내용이 공유됐다. mlx-lm이 여전히 더 낫다고 언급하며, TTFT는 적절한 지표가 아니고 개선 작업이 진행 중이라고 밝혔다. 히트맵과 Prefill/Decode 차트도 업데이트됐다.

I did my first PR on vllm-metal and I was able to run tests with up to 32K context on M3 Ultra with Qwen3-0.6B. mlx-lm is still the winner and TTFT is not the correct one there, improvement is WIP. Mega heatmap andPrefill/Decode charts updated. ctx rows leverages caching.

Awni Hannun (@awnihannun)

M5 Max가 노트북 폼팩터에서 로컬 AI 처리 성능을 크게 끌어올린 신제품이라는 내용입니다. M1 Max 대비 최대 8배 빠른 prefill 및 이미지 생성 속도를 보였고, 벤치마크는 MLX / mlx-lm으로 수행되었습니다. 로컬 LLM·이미지 생성 워크로드에서 성능 향상을 기대할 수 있습니다.

Awni Hannun (@awnihannun)

Qwen3.5가 mlx-lm에서 잘 동작하며 프런티어급 하이브리드 모델이라는 평가. 컨텍스트 길이는 증가하지만 추론 속도와 메모리 사용은 거의 변하지 않음. 예시로 M3 Ultra에서 Q4가 스페이스 인베이더 게임을 생성했고, 4,120토큰을 37.6 tok/s 속도로 생성했다.

Qwen3.5 runs quite well in mlx-lm. Awesome that we have a frontier-level hybrid model. The context gets longer but the inference speed and memory use barely change. Here's the Q4 generating a space invaders game on an M3 Ultra. Generated 4,120 tokens at 37.6 tok/s.

Awni Hannun (@awnihannun)

오픈소스/패키지 mlx-lm이 PyPI에서 지난주 100만 다운로드를 돌파했고 다운로드 추세가 가속화되고 있다는 발표입니다. 오픈소스 LLM/패키지의 채택 속도와 생태계 확산을 보여주는 중요한 이용 지표입니다.

Awni Hannun (@awnihannun)

GLM-5가 mlx-lm으로 단일 512GB M3 Ultra에서 Q4에 구동되며 초기 테스트에서 빠르고 성능이 좋다고 보고했습니다. 모델은 7.1k 토큰을 사용해 초당 15.4 tok/s, 419GB 메모리로 매우 기능적인 Space Invaders 스타일 게임을 생성했습니다. 포팅 작업에 @ActuallyIsaak와 @kernelpool에 감사를 표했습니다.

GLM-5 runs with mlx-lm on a single 512GB M3 Ultra in Q4. It's quite good in my initial testing and pretty fast as well. It generated a highly functional space invaders game using 7.1k tokens at 15.4 tok/s and 419GB memory. Thanks to @ActuallyIsaak and @kernelpool for the port.

Awni Hannun (@awnihannun)

mlx-lm 최신 버전이 공개되었습니다. 신규 모델 Kimi K2.5, Step3.5 flash, LongCat Flash lite(@kernelpool 기여) 추가되었고, mlx_lm.server로 분산 추론 지원(@angeloskath 기여)이 도입되었습니다. 또한 DeepSeek v3 등 MLA 기반 모델들의 속도 및 메모리 효율이 크게 개선되었습니다.

Latest mlx-lm is out: - New models: Kimi K2.5, Step3.5 flash, LongCat Flash lite thanks to @kernelpool - Support for distributed inference with mlx_lm.server thanks to @angeloskath - Much faster and more memory efficient DeepSeek v3 (and other MLA-based models)

Alex Cheema - e/acc (@alexocheema)

GLM 4.7 Flash(8-bit)를 Tensor Parallel과 RDMA로 2대의 M4 Pro Mac Mini에서 구동해 초당 60토큰 처리 속도를 달성했습니다. mlx-lm 0.30.5는 긴 컨텍스트에서 GLM 4.7 Flash에 대해 대폭적인 속도 향상을 제공한다고 하며(@N8Programs, @awnihannun), 곧 출시될 M5 Pro(~1/28)는 프리필이 약 4배, 디코드는 약 1.3배 빨라질 예정입니다.

Running GLM 4.7 Flash (8-bit) with Tensor Parallel / RDMA on 2 M4 Pro Mac Minis at 60 tok/sec. mlx-lm 0.30.5 features huge speedups for GLM 4.7 Flash for long context (h/t @N8Programs & @awnihannun). M5 Pro (~28 Jan) will have ~4x faster prefill and ~1.3x faster decode.

Ivan Fioravanti ᯅ (@ivanfioravanti)

OpenCode와 mlx-lm 서버 조합이 현재 로컬 개발 환경에서 훌륭한 선택이라고 평가합니다. 작성자는 하드웨어와 모델 성능 향상으로 2026년이 로컬·엣지 환경 기반 ML 개발에 있어 흥미로운 한 해가 될 것이라고 전망하고 있습니다.

N8 Programs (@N8Programs)

ml-explore/mlx-lm 저장소에 PR이 제출되었으며(링크 포함), 긴 문맥에서 프롬프트 처리 속도에 약간의 저하가 있는 대신 비모델(비파라미터) 최대 메모리가 3배 감소하고 긴 컨텍스트에서 디코딩 속도가 2배 빨라지는 개선점이 보고되었습니다. 성능-메모리 트레이드오프 관련 중요한 업데이트입니다.