RE: https://norden.social/@maik/116328948179344820

Artikel wie schon von Arstechnica. Die interessantere Frage ist wie lange es dauern wird bist auf dieser Basis Angriffe auf / mit / durch Claude Code gefahren werden. Und was für Effekte daraus zu sehen sein werden.

Abgesehen davon: Ich bin hier um mit Ihnen über das Wort Go...äh, OpenCode zu reden: https://opencode.ai/

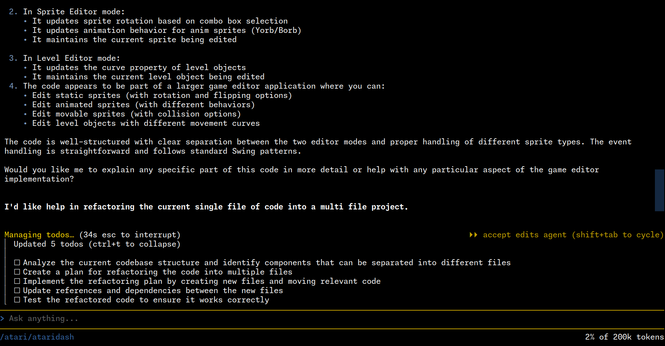

Gleiches LLM coding, allerdings was Modelle angeht offen und inhärent gleich FOSS als Codebasis. Funktioniert auch mit Mistral, ist deutlich weiter entwickelt als Mistrals VibeCLI.

Kritik und Vorteile alle wie gehabt, mehr Auswahl und mehr Offenheit.

#ai #claude #claudecode #opencode #mistral #mistralvibe #codestral #devstral2 #devstral #llm #vibecoding