Cache is hard — почему инвалидация кэша — это проблема согласованности, а не производительности

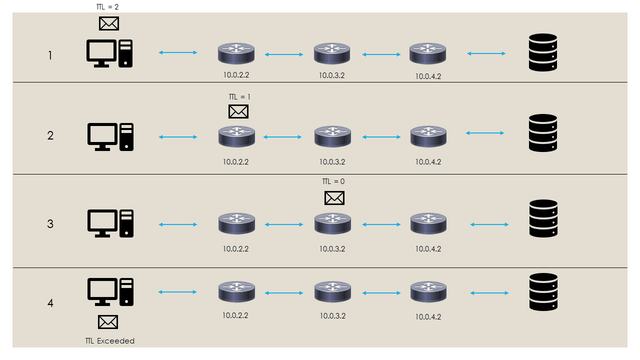

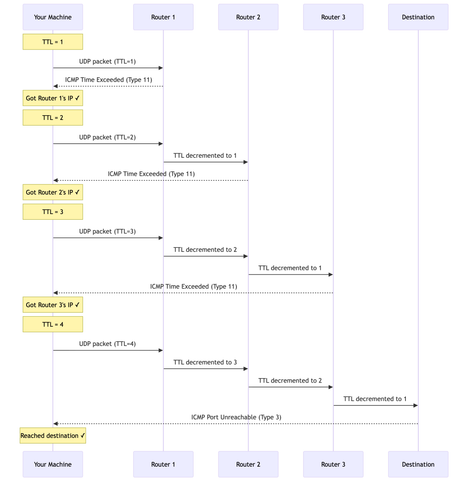

Кэш часто воспринимают как простой способ ускорить систему: положили данные ближе к приложению — получили быстрый ответ. Но на практике главная сложность начинается не с производительности, а с согласованности. Когда данные меняются, кэш может начать «врать»: показывать старые остатки, устаревшие статусы или разные версии одной и той же сущности разным пользователям. В статье разбираем, почему инвалидация кэша — это архитектурная проблема, как TTL, события, CDC и lease‑подходы влияют на консистентность и когда кэш лучше вообще не использовать.

https://habr.com/ru/companies/otus/articles/1033194/

#кэширование #инвалидация_кэша #согласованность_данных #распределённые_системы #Redis #PostgreSQL #CDC #Kafka #TTL #высоконагруженные_системы