中国の金属3Dプリンター「Aixway3D」、 精度10倍・後工程“不要”で量産対応

Fiz uma análise para o @outraspalavras.net de documento da Comissão de Análise Econômica e de Segurança EUA-China sobre como o país asiático escolheu disputar a corrida industrial por IA e o que o Sul Global pode aprender com isso.

https://outraspalavras.net/tecnologiaemdisputa/ia-como-a-china-esta-vencendo/

llmfit — one command to find which LLMs actually fit your hardware

https://github.com/AlexsJones/llmfit

Detects your RAM/GPU, scores hundreds of models, works with Ollama, LM Studio, llama.cpp...

Written in Rust of course 🙌

Handy when you're trying to optimize for SLMs like I do with @silex MCP => https://www.silex.me/ai/

Have you tried local models (Ollama, LM Studio, llama.cpp...)?

How did they perform, let me know 👇

Yes, for code

Yes, for something else

I didn't know it's a thing

Not interested (yet)

자는 동안 700번 실험, Karpathy 오픈소스 AI 연구 자동화 도구 autoresearch

Karpathy가 공개한 autoresearch는 AI 에이전트가 자율로 ML 실험을 반복하며 모델을 개선하는 도구. 700번 실험으로 GPT-2 학습 11% 단축, Shopify는 절반 크기 모델로 기존 모델 성능을 능가했습니다.Truth is coming and cannot be stopped – In Manchester, UK

On Facebook. “Truth is coming and cannot be stopped” – By SLM and D7606 in support of Edward Snowden. In Manchester, UK.https://streetartutopia.com/2013/08/26/truth-is-coming-and-cannot-be-stopped-in-manchester-uk/

In my journey to make @silex AI-native and optimized for free #OpenSource local models

I just released a grapesjs-ai-capabilities plugin, inspired by #WordPress new capability API: https://github.com/silexlabs/grapesjs-ai-capabilities

Now I'll refactor all the #GrapeJs plugins I maintain to expose capabilities as #MCP tools, with minimal prompts and very specific errors for #SLM

Then I’ll benchmark different models and maybe experiment with fine-tuning

#GrapesJS #AI #LocalAI #NoCode #BuildInPublic #FOSS #MCP #LLM

GitHub - silexlabs/grapesjs-ai-capabilities: Lightweight discovery layer on top of GrapesJS commands, allowing plugins to declare structured, machine-readable capabilities that builders can expose as MCP tools

Lightweight discovery layer on top of GrapesJS commands, allowing plugins to declare structured, machine-readable capabilities that builders can expose as MCP tools - silexlabs/grapesjs-ai-capabili...

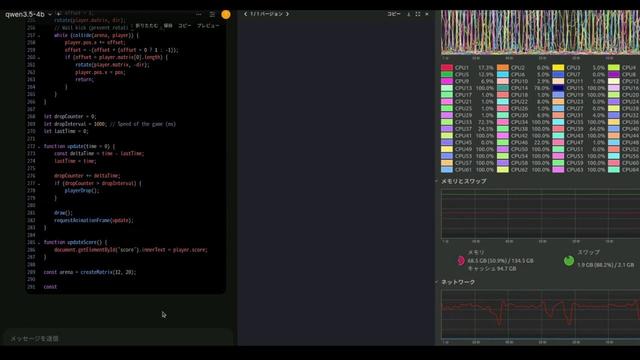

AISatoshi (@AiXsatoshi)

Qwen3.5-4B-Q4을 TR7975 CPU에서 추론했을 때 약 15 token/s를 기록했다고 보고. 특히 4B-4bit 구성의 SLM으로 테트리스 테스트를 통과한 점에 대해 놀라움을 표함.

AISatoshi (@AiXsatoshi)

Qwen3.5-4B-Q4가 테트리스 생성 테스트에서 80% 이상의 성공률을 기록했다고 보고. 해당 파라미터 규모(4B)에서 보기 드문 높은 정확도로 평가되며, 게시자는 하이브리드 어텐션 SLM이 새로운 시대를 열고 있다고 언급함.