У вас скорее всего не получится сделать статистически обоснованный подбор личных жизненных привычек и БАДов

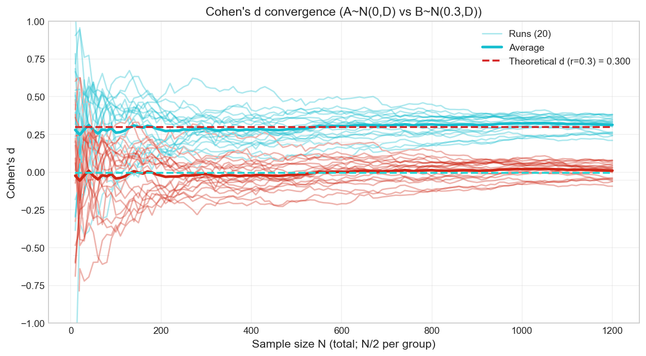

Допустим, вас не устраивает ваше качество сна. Вы перестали делать очевидно вредные вещи (убрали кофе на ночь), и сон улучшился, но хотелось бы поработать над ним ещё. Коллега по работе даёт вам смесь трав со зверобоем и лавандой. Вы пробуете пить его на ночь вместо кофе, и иногда сон действительно становится глубже. Но иногда нет. Вы готовы экспериментировать, но как бы проверить, действительно ли травы работают или это просто случайный разброс? Или допустим, вы не очень довольны вашей продуктивностью на работе. По заветам из "Atomic Habits" и книг по эргономике вы внедрили несколько полезных микропривычек. Но что делать, когда низковисящие фрукты закончились? Время ограничено - всего, что кто-то называет полезным, не сделать. Некоторые привычки ещё и взаимоисключающие: невозможно за обедом одновременно и общаться с кем-то и сидеть в одиночестве в тишине. Или например, вы хотите достичь более хороших показателей на рыболовном поприще... вы поняли идею. "Не недооценивайте силу малых вещей, взятых в большом количестве", - мысль мудрая, но как бы понять, какие именно малые вещи действуют конкретно в вашей ситуации? Если вы проходили курс статистики, то у вас в голове есть набросок ответа. Выделить целевую метрику, собрать историю данных, затем собрать набор данных после выбранного вмешательства, сравнить средние значения метрики до и после - и готов научно обоснованный ответ. Проблема в том, что если ввязаться в подобный проект без основательного плана, вы в итоге окажетесь с ворохом бесполезных цифр в таблице. Почему именно эта затея не для слабых духом мне бы и хотелось рассказать в этой статье.

https://habr.com/ru/articles/1009762/

#статистика #бад #gtd #привычки #pvalue #сбор_данных #эксперимент