Ivan Fioravanti ᯅ (@ivanfioravanti)

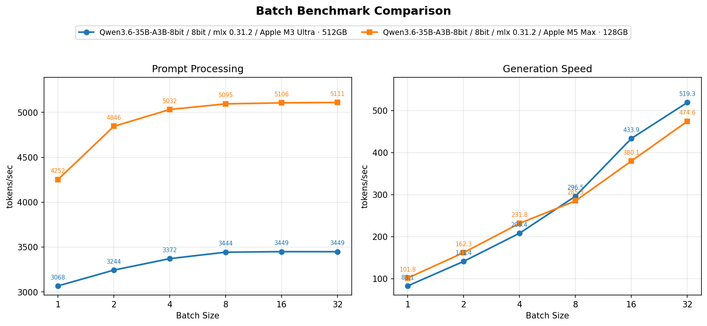

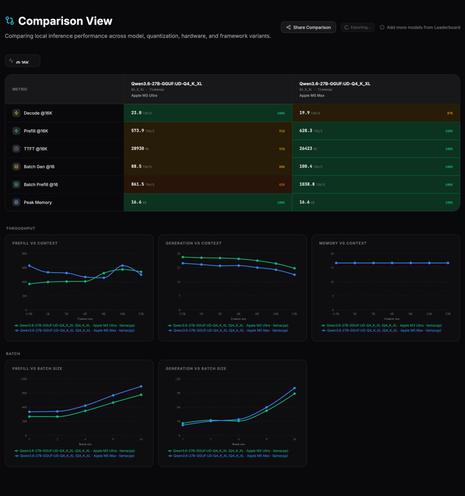

M3 Ultra와 M5 Max에서 llamacpp를 활용해 작업 중이며, Neural Accelerators는 프롬프트 처리에 도움이 되지만 텍스트 생성에서는 M3 Ultra가 더 낫다고 언급합니다. batch inference에서 -np 설정이 성능에 큰 영향을 주고 이상한 결과도 관찰했다고 공유합니다.

Ivan Fioravanti ᯅ (@ivanfioravanti) on X

Working more and more on llamacpp on my M3 Ultra and M5 Max. Neural Accelerators help on prompt processing, but on text generation M3 Ultra wins. Still fighting on the batch inference, -np has dramatic impact on it and I get very strange results.