Why Sora Failed: $15M/day inference cost vs. $2.1M lifetime revenue

https://www.revolutioninai.com/2026/03/%20chatgpt-gpt-54-mini-silent-switch-march-2026.html

#HackerNews #SoraFailure #InferenceCost #RevenueChallenges #AIInsights

Why Sora Failed: $15M/day inference cost vs. $2.1M lifetime revenue

https://www.revolutioninai.com/2026/03/%20chatgpt-gpt-54-mini-silent-switch-march-2026.html

#HackerNews #SoraFailure #InferenceCost #RevenueChallenges #AIInsights

Avi Chawla (@_avichawla)

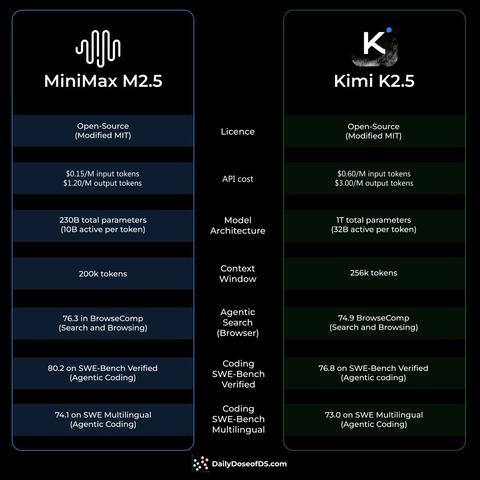

Opus 4.6 수준의 성능을 가진 오픈소스 LLM이 등장했고, 추론 비용은 20배 저렴하다고 주장하는 소식입니다. Kimi K2.5와 MiniMax M2.5는 모두 MoE(혼합 전문가) 구조의 오픈소스 모델로 Anthropic 같은 상용 모델과 직접 경쟁한다고 소개되며, Kimi K2.5는 총 1조 파라미터에 토큰당 활성 320억(32B)이라고 명시되어 있습니다.

Finally, an open-source LLM as good as Opus 4.6! And it has 20 times cheaper inference cost! Kimi K2.5 and MiniMax M2.5 are both open-source MoE models that compete directly with proprietary offerings (like Anthropic). Kimi K2.5: - 1T total parameters - 32B active per token.

dax (@thdxr)

어떤 모델을 소비자용 하드웨어에서 구동하는 데 약 2만 달러가 들었고 성능이 매우 우수하다는 언급이 나왔다. 많은 기업이 개발자당 연간 1만~2만 달러를 클라우드 추론에 지출하고 있다는 점을 들어, AI 인프라 비용 부담과 경제적 전환이 심화되고 있음을 지적한다.

https://x.com/thdxr/status/2016547406247002381

#inferencecost #consumerhardware #cloudinference #infrastructure

Rohan Paul (@rohanpaul_ai)

해당 논문은 소규모 기업이 RTX 50 계열 GPU로 프라이빗 LLM을 저비용으로 운용할 수 있음을 제시합니다. 전력 비용만 계산하면 100만 토큰당 약 $0.001~$0.04 수준으로, 예산형 클라우드 API 대비 약 40~200배 저렴하다고 보고합니다. 다만 클라우드 기반 LLM은 데이터 노출 위험 등 다른 문제가 존재한다고 지적합니다.

This paper shows small firms can run private LLMs on RTX 50 GPUs at low cost. Electricity-only inference lands around $0.001-$0.04 per 1M tokens, about 40-200x cheaper than budget cloud application programming interfaces (APIs). The problem is that cloud LLMs can expose

OpenAI just rolled out a script that scores prompt complexity, letting developers trim unnecessary tokens and slash inference costs for upcoming models like gpt‑5.1. If you write Python prompts, this could save you money and boost performance. Curious how it works? Dive into the details and see the code in action. #OpenAI #LLM #InferenceCost #gpt51

🔗 https://aidailypost.com/news/openai-script-rates-question-complexity-reduce-llm-inference-costs