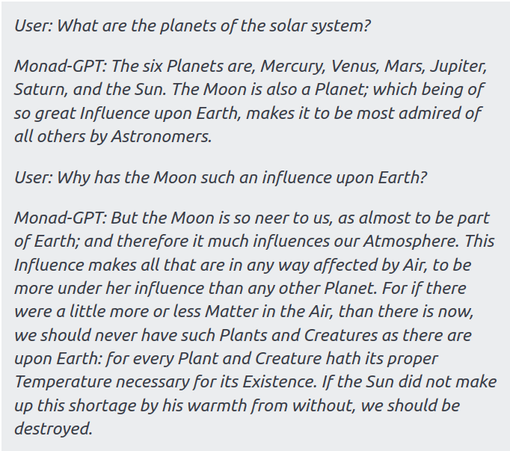

Pierre-Carl Langlais custom-trained a version of ChatGPT on English texts from the 17th century and earlier ...

... so that it speaks like a 17th-century learned monk ...

... whose factual knowledge of the world ends in the 17th century

It's called "Monad-GPT"

Here's a sample of the dialogue

Item #1 in my latest "Linkfest" newsletter, here: https://buttondown.email/clivethompson/archive/linkfest-13-17th-century-chatgpt-the-merovingian/