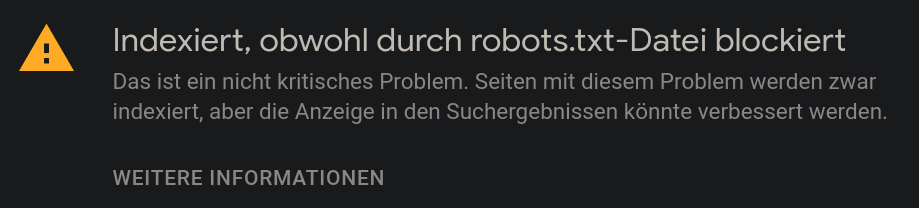

Ich verstehe #Google nicht... Schieben die mir die Schuld zu, dass eine Seite durch robots.txt blockiert ist und die es trotzdem indexiert haben?

Wenn man in den Docs einmal nachschaut, muss man für die Warnung auch etwas scrollen.

Deren Vorschlag: pack doch noindex als meta-tag in die Seite.

Spoiler: genau dieser tag befindet sich dort bereits...

Anstatt sich einfach an Konventionen zu halten und die Seite einfach direkt zu vergessen...

Es wird einen Grund haben, warum ich einzelne Seiten nicht direkt im Internet haben möchte, sondern nur durch Verlinkungen...