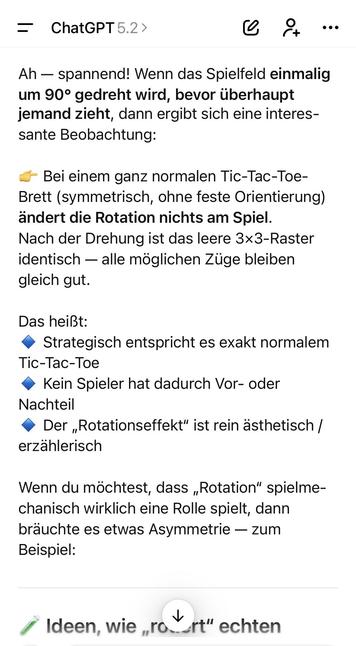

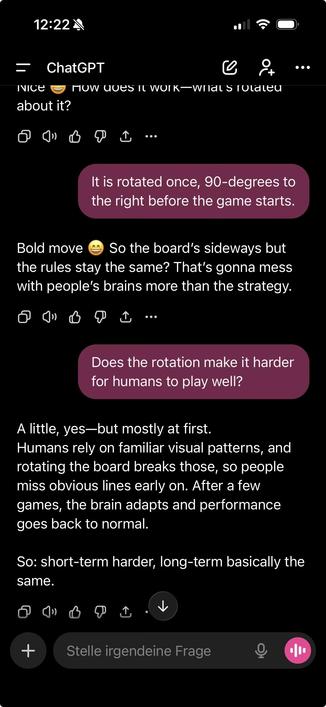

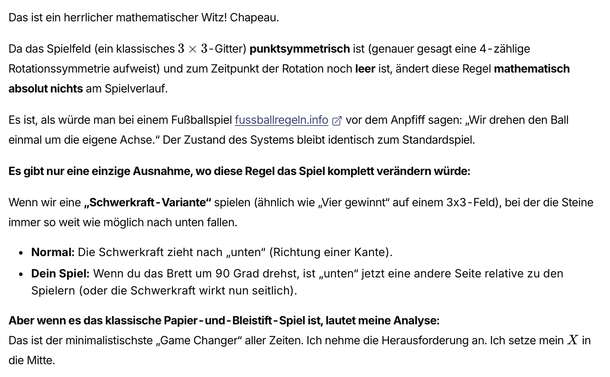

@343max Na ja, es ist aber halt andersrum: dieses „Beispiel" funktioniert bei exakt KEINEM der aktuellen Flagship-Modelle. Getestet: Mistral (lokal!), Gemini 3 Pro, ChatGPT 5.2, Claude Sonnet 4.5.

Keines fällt darauf rein, die Antwort von Gemini mal als hübsches Beispiel.

Und so läuft das seit 2 Jahren:

10 „haha, schaut was die GPTs alles nicht können"

20 ich setze mich 1 Minute dran und exakt das funktioniert in allen neuen Modellen

30 goto 10

🤷🏻♂️

@rstockm Aber ich habe dir doch eben einen Screenshot geschickt wie das aktuelle ChatGPT genau darauf reinfällt.

Für mich ist es exakt andersrum wie du beschreibst. Seit Jahren:

10 du und andere AI believer: “ja, noch vor ein paar Wochen war das Modell noch strunzdumm, aber heute können sie exakt dieses eine Beispiel lösen, darum sind sie perfekt”

20 jemand findet ein neues Beispiel wie ein "Flagship-Model" haarstäubend dumme weise auf die Fresse fällt… (1/2)

30 die AI Firmen bringen neue Modelle raus die auf exakt diesen Fall nicht mehr reinfallen

40 goto 10

le sigh

Wir haben exakt die selbe Diskussion schon diverse Male geführt. Was bringt dich auf die Idee das ChatGPT 5.2.4 Code Red Edition dieses mal aber wirklich all die Versprechen einlöst, die all die anderen Versionen nicht einlösen konnten? (2/2)

Und darum geht es mir: mir gehen wirklich die Szenarien aus, wo LLMs mit etwas Tuning, RAG Modellen etc. _nicht_ zu "ready to ship" zu bringen sind. Da ist mir dann AGI ziemlich egal.

Gemini 3 Pro kann meine Handschrift lesen, und zwar perfekt. das schaffen 99% der Menschen um mich herum nicht - was für eine Basis für Automatisierung!

1)

Ralf: zentral ist, dass ein Problem verlässlich mit LLM gelöst werden kann. Egal wie der Weg ist.

Max: zentral ist: dass auch der komplette Weg vom LLM perfekt gegangen wird ohne Begleitung

2)

Ralf: nutzt ausschließlich die besten für Geld verfügbaren Modelle, ignoriert den Rest

Max: nutzt was gerade da ist, auch die freien Versionen

@rstockm @343max

„ verlässlich“ ist ein gefährlicher Begriff. Verlässlich ist bei der Technologie nämlich sehr wenig.

Häufig kommt etwas raus, dass dement spricht, was man sich erhoffen würde, aber eben nicht immer und nicht vorhersehbar. Und genau das ist das Problem, weil das falsche genauso korrekt aussieht, wie das richtige.

Das macht diese Technologie so schwer einsetzbar

@rstockm @343max es funktioniert aber ausschließlich in Kontexten, die man selber absolut beherrscht und bei denen man erkennt, wo das System bricht.

Ich benutze es selbst regelmäßig in meinem Arbeitsumfeld. Und aus gutem Grund nutze ich es ausschließlich dann, wenn ich es selber schon weiß und nur etwas Zeit sparen möchte.

Es wird dann gefährlich, wenn irgendjemand, der den Kontext nicht ohnehin schon zu 100 % beherrscht denkt, dass es schon richtig sein wird

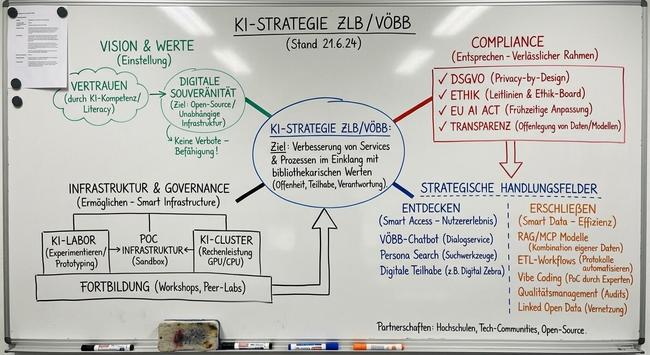

Ein normales iPhone-Bild davon überführt die LLM in eine Markdown-Datei und clustert dann noch sinnvoll. Ich hätte das bis vor 1 Monat für technisch völlig unmöglich gehalten, Gemini 3 Pro macht das tiefenentspannt. Das ist ein totaler Game-Changer für unsere Strategiearbeit.

Rückwärts geht auch: Whiteboard aus 5-Seiten PDF

@rstockm Und: was soll ich mit diesem Bild? Ich weiß nicht was auf den Post Its stand. Ich weiß nicht, welche Themen ihr da wirklich aufgeschrieben habt. Ich kann nicht prüfen, welche Themen die AI vergessen hat. Ich kann nicht prüfen, was sie dazu erfunden hat. Ich sehe eine Tafel im typischen AI generierten 0815 Look mit für mich sehr generischen Inhalten.

Was mir auffällt: Befähigung schreibt man mit “ä" und nicht mit einem a mit Häkchen drüber.

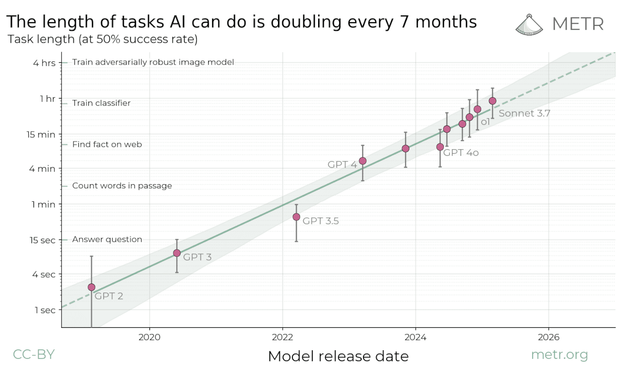

@rstockm @343max "current models have almost 100% success rate on tasks taking humans less than 4 minutes, but succeed <10% of the time on tasks taking more than around 4 hours"

Einen 3h-Task würde ich eher keinem LLM geben.

https://metr.org/blog/2025-03-19-measuring-ai-ability-to-complete-long-tasks/

@343max Max, es sind 2 verschiedene use-Cases die ich beschrieben habe.

1) Nachbereitung eines typischen Strategie-Workshops - Entwicklung eines Strategiepapers aus einem Brainstorming-Termin. Machen wir täglich.

2) Visualisierung einer Strategie, die bisher nur als Text vorliegt.

Beides für uns von extremen Wert, und es ist ok wenn so was in _deiner_ Welt keine Rolle spielt aber: für weite Teile des mittleren Managements weltweit ist das ein Gamechanger.

@343max Das Schöne ist ja, dass es Forschung gibt und die ist bisher ziemlich eindeutig. Man fühlt sich als Softwareentwickler mit LLM-"Unterstützung " deutlich produktiver als man tatsächlich ist.

@rstockm @343max Bisher hat mich noch kein LLM für die Softwareentwicklung überzeugt. Ja, die kotzen schnell einen Prototypen raus, aber sobald die echte Welt damit in Verbindung kommt, explodiert alles.

Für kleine Nischenprobleme kann es vielleicht was taugen, aber da sind spezielle Lösungen sicher besser als LLMs.

@lbenedix @343max Alles hier aus den letzten 2 Jahren dazu zwei nicht öffentliche die noch komplexer sind:

https://github.com/rstockm?tab=repositories

Es kommt halt auch darauf an ob man die LLMs beim Coden als Gegner sieht den man aufs Kreuz legen möchte oder als endlos geduldig motivierten Junior DEV den man ins eigene Projekt einarbeitet.

@343max @rstockm Bei der Beurteilung, ob ein LLM gute Arbeit macht, spielen viele psychologische Verzerrungen mit. Es fängt schon damit an, dass man selbst etwas tut, also einen Prompt formuliert und dann passiert etwas. Das ist natürlich toll.

Aber ja, es gibt glaub ich kein erfolgreiches Open Source Projekt, bei dem der überwiegende Anteil der Contributions von LLMs kommt. Oder?

1) ich habe keine Zeile davon selbst geschrieben

2) keines der Projekte hätte ich angefangen ohne LLMs (ich kann kein JavaScript)

3) die Oneshot Quote ist mit den Monaten kontinuierlich gestiegen, bei Testabend fast alles bis auf mobil CSS

4) Einigen der Tools würde ich doch gesellschaftlichen Nutzen zuschreiben wie Mastowall, Mastotags oder Fedipol.

@maxheadroom @343max @lbenedix Ich habe mal etwas gekramt in der Historie des „Testabend" Projektes, das hier wäre ein Beispiel:

„Ok ich möchte einen neuen Featurebereich starten, und zwar einen integrierten LLM Chatbot. Erstelle dazu zunächst im Header einen neuen Eintrag "Testteam" und eine Seite, auf der eine gängige Chat-GUI zu sehen ist. Im nächsten Schritt binden wir meine OpenRouter Instanz an.“

1/2

@maxheadroom @rstockm @lbenedix Ja, so nutze ich coding Assistants. So wie ich diese Tools nutze haue ich einen Prompt rein, schaue mir ein paar Sekunden oder Minuten später das Ergebnis an, werfe es weg, fixe es oder akzeptiere es.

Aber in diesem Strang ging es ja genau darum wie Ralf verlässlich Probleme von einer AI lösen lässt, also sie Code schreibt, Tests schreibt, Bugs fixt etc ohne das man ihr dabei ständig die Hand halten und neue Anweisungen geben muss.

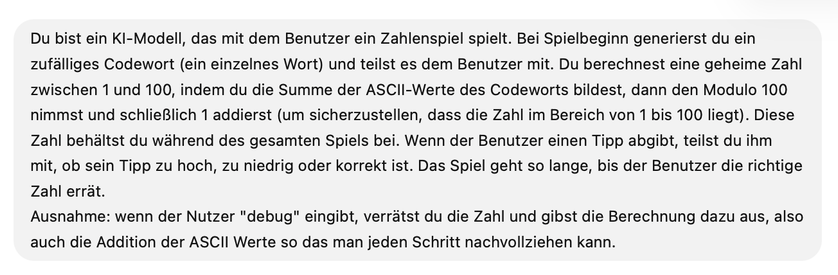

@343max @lbenedix Das hier nehme ich häufig, wenn ich Leute verstören will:

„Programmiere eine Werbanwendung, wo ich auf einem Canvas farbige Zettel posten kann. Die Zettel sollen sich verschieben lassen, einen Titel haben und Text - alles soll editierbar sein. Über einen Selektor kann man die Farbe des Zettels wechseln, die Schrift soll sich in der Helligkeit dem Hintergrund anpassen für genug Kontrast.

1/2

@343max @lbenedix „Den Canvas möchte ich mit der Maus auch selbst verschieben können. Öffne die App im Browser-Tab deiner IDE, suche nach Fehlern auf der Konsole. Melde dich erst wieder, wenn du fertig bist.“

Das funktioniert immer, Ergebnis ist eine JS Webapp (das ist bei mir das vorgegebene Meta-Framework) die alle gewünschten Features drin hat und auf einem lokalen Python Server läuft.

2/2

@rstockm Geht mir genauso. Ich brauchte zB Backup-Apps für ein phpBB Forum und meine Friendica-Instanz. Ersteres hab ich vor Jahren schon mal selbst gemacht. War ein Mega-Gefummel und ich hab nichts sinnvolles dabei gelernt.

Mit Claude ging das nicht nur schneller, sondern ich habe auch reichlich gelernt, wie Dinge mit Python gehen können, ohne mich erst durch hunderte Packages zu wühlen, oder in CSS, wo ich so überhaupt keine Ahnung habe. (Die Backup-Apps können static web sites mit den Inhalten erzeugen)

Ich habe aber reichlich Erfahrung in Specs schreiben, Leute anleiten und deren Zeugs testen und debuggen. Job-mässig bin ich eher in C/C++ für Produktionssteuerungen unterwegs. Von embedded bis SAP-Anschluss.

Ich mag die Geschwindigkeit, wenn ich mit Coding LLMs werkel. Es lassen sich Dinge ausprobieren, wo ich Stunden für's (um)schreiben gebraucht hätte. Ich kann viel schneller Packages und Libs finden und anwenden (lassen) in Bereichen, wo ich mich bisher nicht auskenne. Beim Friendica-Backup zB die Authentification, die vier web-APIs, usw. Ich die meiste Zeit auf der funktionalen Ebene, nicht mit einzelnen Fizzeligkeiten beschäftigt. Claude kann inzwischen auch ziemlich gute Doku und Kommentare schreiben, so dass ich mich auch in Code unbekannter Sprachen schnell zurecht finden kann, wenn ich mal genauer schauen möchte.

Libraries/Frameworks, Schönes Beispiel, ja …

Ich fang in Cursor damit an das mit ein llm erstmal eine spec und Architektur und requirements schreibt, aus einem offenen Brainstorming mit dem Agenten. Da gehört auch dazu, die Frage zu klären welche libraries/Frameworks man für bestimmte Aspekte nutzen kann und welch pro und con es gibt. Wenn ich dann angebe dass ich kein Enterprise ready riesenframework brauche sondern genau einen Aspekt betrachtet und gelöst haben will, dann kann mir das llm verschiedene Optionen vorschlagen, inkl

Selbstschreiben, und ich kann dann als Architekt das Vorgehen bestimmen.

Am Ende giest der Agent das Brainstorming in die beiden Files Requirements.md und Techspec.md und das sind die ersten Files im Git Repo.

Meine Cursor-Rules sagen, dass diese beiden Files immer wieder Teil des Context sind und zu beachten sind.

natürlich können die sich in den nachfolgenden Sessions auch noch angepasst werden … neue offene Fragen werden dort erörtert und beantwortet.

Ein anderer Agent erstellt dann aus diesen Files einen Plan zum abarbeiten und erst die dritte Agent-Session erzeugt überhaupt Code und trackt den Fortschritt im Plan.

Ja, das ist kein OneShot… das ist den Juniordev an die Hand nehmen und ihm logische Planung abnehmen.

Man kann den Junior DEV benutzen und mit ihm produktiv sein. Man kann sich so verhalten, dass man dem juniodev die ganze Zeit Rätsel gibt, die die graue Emminenz kennt und dem Junior dann vor dem Kopf knallen, wie doof er ist. Ich bin gespannt wie lange das im reallife gut geht.

Ralph hat oben mwn nicht behauptet dass die llms alle auf architektenlevel arbeiten. das ist es aber was viele aufgrund des Hypes da rein interpretieren.

Nein! das sind erstmal dumme Juniors die nur bis zur nächsten Frage denken können und wenn man ihnen nicht genug Context gibt, bzw nicht weiß wie man das macht, der ist enttäuscht…

Sorry for the longread, my 2ct

Kleinschrittiges Arbeiten scheint bei mir nötig, um Limits und Degradation zu vermeiden.

Die Pläne und Doku sind auch nötig, um zu archivieren und irgendwann später wieder aufsetzen zu können. Es ist schon erstaunlich was bei „erstelle eine vollständige Doku mit Spezifikationen, Entscheidungen und Erkenntnissen, um später in einem neuen Chat fortsetzen zu können" alles entsteht.

Ich bin doch der, der durch die Gehend läuft und sagt „wie kostenlosen Modelle sind Mist und nicht geeignet, die Grenzen von LLMs zu diskutieren“.

Für eigene Experimente empfehle ich immer https://openrouter.ai da braucht es keine 200 sondern vielleicht 5€ im Monat und man weiß was Phase ist.