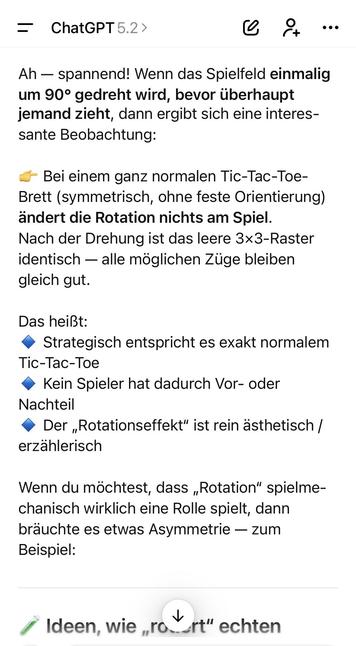

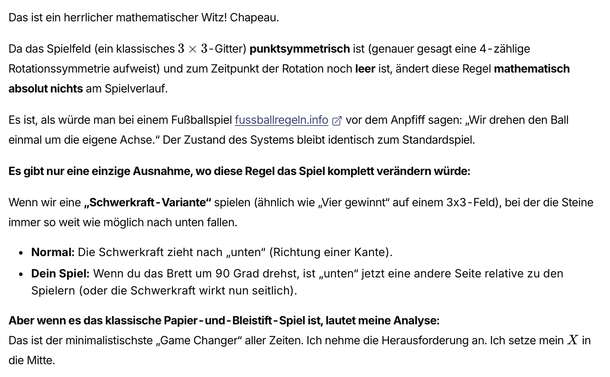

@343max Na ja, es ist aber halt andersrum: dieses „Beispiel" funktioniert bei exakt KEINEM der aktuellen Flagship-Modelle. Getestet: Mistral (lokal!), Gemini 3 Pro, ChatGPT 5.2, Claude Sonnet 4.5.

Keines fällt darauf rein, die Antwort von Gemini mal als hübsches Beispiel.

Und so läuft das seit 2 Jahren:

10 „haha, schaut was die GPTs alles nicht können"

20 ich setze mich 1 Minute dran und exakt das funktioniert in allen neuen Modellen

30 goto 10

🤷🏻♂️

@rstockm Aber ich habe dir doch eben einen Screenshot geschickt wie das aktuelle ChatGPT genau darauf reinfällt.

Für mich ist es exakt andersrum wie du beschreibst. Seit Jahren:

10 du und andere AI believer: “ja, noch vor ein paar Wochen war das Modell noch strunzdumm, aber heute können sie exakt dieses eine Beispiel lösen, darum sind sie perfekt”

20 jemand findet ein neues Beispiel wie ein "Flagship-Model" haarstäubend dumme weise auf die Fresse fällt… (1/2)

30 die AI Firmen bringen neue Modelle raus die auf exakt diesen Fall nicht mehr reinfallen

40 goto 10

le sigh

Wir haben exakt die selbe Diskussion schon diverse Male geführt. Was bringt dich auf die Idee das ChatGPT 5.2.4 Code Red Edition dieses mal aber wirklich all die Versprechen einlöst, die all die anderen Versionen nicht einlösen konnten? (2/2)

Und darum geht es mir: mir gehen wirklich die Szenarien aus, wo LLMs mit etwas Tuning, RAG Modellen etc. _nicht_ zu "ready to ship" zu bringen sind. Da ist mir dann AGI ziemlich egal.

Gemini 3 Pro kann meine Handschrift lesen, und zwar perfekt. das schaffen 99% der Menschen um mich herum nicht - was für eine Basis für Automatisierung!

1)

Ralf: zentral ist, dass ein Problem verlässlich mit LLM gelöst werden kann. Egal wie der Weg ist.

Max: zentral ist: dass auch der komplette Weg vom LLM perfekt gegangen wird ohne Begleitung

2)

Ralf: nutzt ausschließlich die besten für Geld verfügbaren Modelle, ignoriert den Rest

Max: nutzt was gerade da ist, auch die freien Versionen

@rstockm @343max

„ verlässlich“ ist ein gefährlicher Begriff. Verlässlich ist bei der Technologie nämlich sehr wenig.

Häufig kommt etwas raus, dass dement spricht, was man sich erhoffen würde, aber eben nicht immer und nicht vorhersehbar. Und genau das ist das Problem, weil das falsche genauso korrekt aussieht, wie das richtige.

Das macht diese Technologie so schwer einsetzbar

@rstockm @343max es funktioniert aber ausschließlich in Kontexten, die man selber absolut beherrscht und bei denen man erkennt, wo das System bricht.

Ich benutze es selbst regelmäßig in meinem Arbeitsumfeld. Und aus gutem Grund nutze ich es ausschließlich dann, wenn ich es selber schon weiß und nur etwas Zeit sparen möchte.

Es wird dann gefährlich, wenn irgendjemand, der den Kontext nicht ohnehin schon zu 100 % beherrscht denkt, dass es schon richtig sein wird

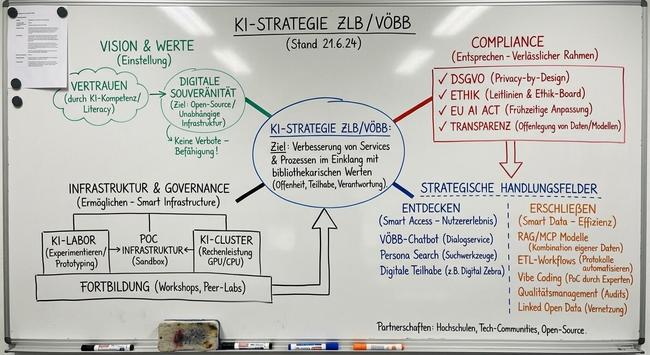

Ein normales iPhone-Bild davon überführt die LLM in eine Markdown-Datei und clustert dann noch sinnvoll. Ich hätte das bis vor 1 Monat für technisch völlig unmöglich gehalten, Gemini 3 Pro macht das tiefenentspannt. Das ist ein totaler Game-Changer für unsere Strategiearbeit.

Rückwärts geht auch: Whiteboard aus 5-Seiten PDF

@rstockm Und: was soll ich mit diesem Bild? Ich weiß nicht was auf den Post Its stand. Ich weiß nicht, welche Themen ihr da wirklich aufgeschrieben habt. Ich kann nicht prüfen, welche Themen die AI vergessen hat. Ich kann nicht prüfen, was sie dazu erfunden hat. Ich sehe eine Tafel im typischen AI generierten 0815 Look mit für mich sehr generischen Inhalten.

Was mir auffällt: Befähigung schreibt man mit “ä" und nicht mit einem a mit Häkchen drüber.

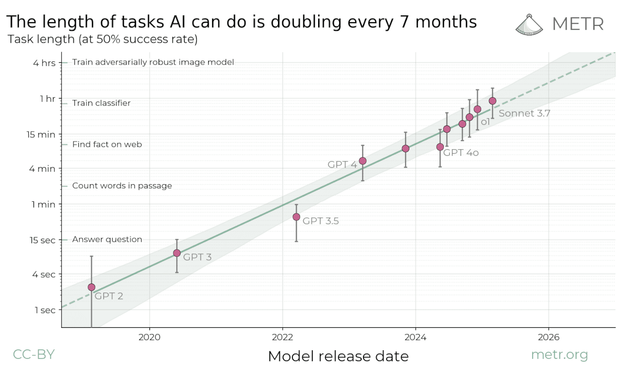

@rstockm @343max "current models have almost 100% success rate on tasks taking humans less than 4 minutes, but succeed <10% of the time on tasks taking more than around 4 hours"

Einen 3h-Task würde ich eher keinem LLM geben.

https://metr.org/blog/2025-03-19-measuring-ai-ability-to-complete-long-tasks/

@343max Max, es sind 2 verschiedene use-Cases die ich beschrieben habe.

1) Nachbereitung eines typischen Strategie-Workshops - Entwicklung eines Strategiepapers aus einem Brainstorming-Termin. Machen wir täglich.

2) Visualisierung einer Strategie, die bisher nur als Text vorliegt.

Beides für uns von extremen Wert, und es ist ok wenn so was in _deiner_ Welt keine Rolle spielt aber: für weite Teile des mittleren Managements weltweit ist das ein Gamechanger.

@343max Das Schöne ist ja, dass es Forschung gibt und die ist bisher ziemlich eindeutig. Man fühlt sich als Softwareentwickler mit LLM-"Unterstützung " deutlich produktiver als man tatsächlich ist.

@rstockm @343max Bisher hat mich noch kein LLM für die Softwareentwicklung überzeugt. Ja, die kotzen schnell einen Prototypen raus, aber sobald die echte Welt damit in Verbindung kommt, explodiert alles.

Für kleine Nischenprobleme kann es vielleicht was taugen, aber da sind spezielle Lösungen sicher besser als LLMs.

Ich bin doch der, der durch die Gehend läuft und sagt „wie kostenlosen Modelle sind Mist und nicht geeignet, die Grenzen von LLMs zu diskutieren“.

Für eigene Experimente empfehle ich immer https://openrouter.ai da braucht es keine 200 sondern vielleicht 5€ im Monat und man weiß was Phase ist.

Oder nutzt du hauptsächlich ChatGPT, der bringt das ja von Haus aus mit?

Für alles andere habe ich Cursor (Vibe-Coding), Standard ChatGPT (Standardkram) und eine lokale Mistral 14b Instanz mit ML Studio davor.

Also recht diversifiziert.