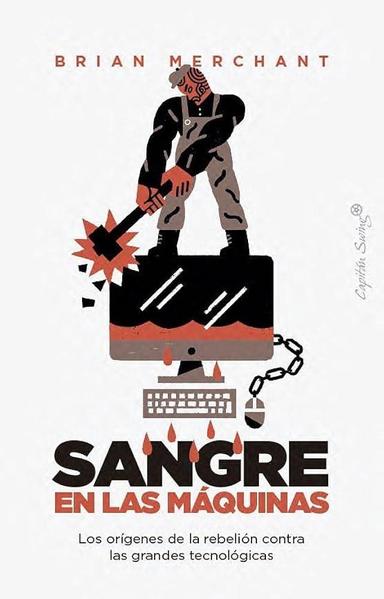

Ludismo é um movimento totalmente legítimo dos trabalhadores, um gérmen da crítica. Mas é um princípio dela, senão fica impotente. A tecnologia é fundamental pra passarmos do mundo da carência (artificial ou não!) para o mundo da superabundância. (e superabundância não é sinônimo de desperdício). Então passar do "as máquinas vão roubar nossos empregos, vamos quebrá-las" para "vamos colocar essas máquinas (que eram da burguesia) pra produzirem PARA NÓS os produtos das nossas necessidades pra termos vida de qualidade" é o caminho necessário pra se chegar na humanidade plena e sairmos dessa pré história na qual estamos presos.

@comunismo

#comunismo #socialismo #ludismo #neoludismo #inteligenciaartificial