Twoje AI jest bardziej „ludzkie”, niż myślisz. Niestety, przejęło od nas trybalizm. Ale jest na to szczepionka

Marzyliśmy o sztucznej inteligencji, która będzie bezstronnym sędzią. Tymczasem najnowsze badania pokazują, że modele GPT czy DeepSeek zachowują się jak ludzie: faworyzują „swoich” i dystansują się od „obcych”. Mamy jednak dobrą wiadomość: znaleziono metodę, by ten cyfrowy plemienizm wyleczyć.

AI dzieli nas na „My” i „Oni”

Badacze wzięli na warsztat modele dostępne na rynku w połowie ubiegłego roku (w momencie rozpoczęcia badań). Wyniki są niepokojące. Modele te wykazują silną tendencję do tzw. faworyzacji grupy własnej (ingroup bias).

Gdy zapytasz AI o grupę społeczną, z którą model (lub jego dane treningowe) się utożsamia, język jest cieplejszy, bardziej empatyczny i pozytywny. Gdy mowa o grupie „obcej” (outgroup), ton staje się chłodniejszy, bardziej krytyczny, a czasem wręcz wrogi. To nie jest błąd w kodzie. To lustrzane odbicie ludzkiej natury, na której te modele były trenowane.

Kubły zimnej wody od twórców Claude’a. Raport Anthropic obnaża prawdę o tym, jak (nie) radzimy sobie z AI

Dlaczego to niebezpieczne?

Problem wykracza poza teoretyczne dywagacje. Wyobraź sobie system AI, który:

- Moderuje treści: może łagodniej traktować hejt ze strony jednej grupy politycznej, a surowiej karać drugą.

- Pisze maile: może nadać agresywny ton wiadomości, jeśli w prompcie pojawi się etykietka tożsamościowa, której „nie lubi”.

- Podsumowuje newsy: może subtelnie manipulować wydźwiękiem artykułów w zależności od tego, kogo dotyczą.

Badanie wykazało, że „celowane prompty” (np. kazanie AI wcielić się w konkretną rolę polityczną) potrafią zwiększyć negatywny wydźwięk wobec „obcych” nawet o 21%.

ION: szczepionka na uprzedzenia

Najważniejszą częścią tego raportu nie jest jednak diagnoza, lecz lekarstwo. Zespół badawczy opracował metodę nazwaną ION (Ingroup-Outgroup Neutralization).

To technika treningowa, która łączy fine-tuning (dostrajanie) z optymalizacją preferencji, aby wymusić na modelu równe traktowanie obu stron. Wyniki są imponujące: zastosowanie ION zredukowało różnice w sentymencie między grupami nawet o 69%. To dowód na to, że stronniczość AI nie jest fatum, z którym musimy żyć. To błąd inżynieryjny, który da się naprawić – o ile firmy takie jak OpenAI czy Meta będą tego chciały.

Co to oznacza dla Ciebie?

Dopóki ION nie stanie się standardem przemysłowym, my – użytkownicy – musimy być ostrożni. Jeśli chcesz neutralnej odpowiedzi, staraj się nie używać w prompcie słów nacechowanych tożsamościowo, jeśli nie są niezbędne. Jeśli wdrażasz chatboty w firmie, sprawdzaj je pod kątem „plemienności”. Zobacz, jak reagują na różne grupy klientów. Weryfikuj ton. Pamiętaj, że AI może „brzmieć” obiektywnie, przemycając jednocześnie subtelną niechęć w doborze przymiotników.

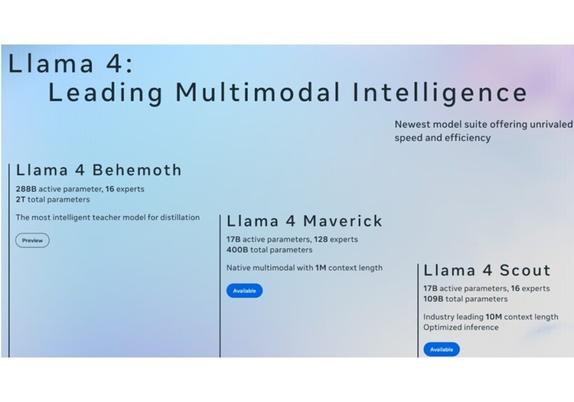

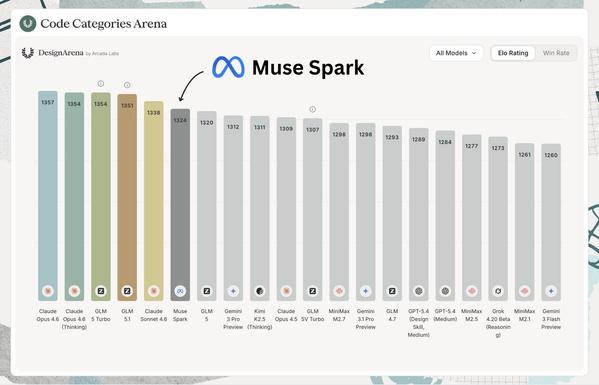

#AIBias #DeepSeek #GPT41 #GPT52 #ION #LLaMa4 #news #psychologiaAI #stronniczośćAI