Show HN: Wispr Flow but free, 100% on-device, and open source (macOS)

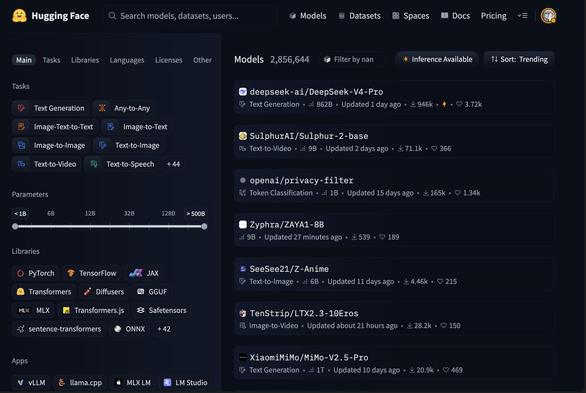

Wispr Flow의 오픈소스 macOS용 음성 인식 도구가 공개되었다. 이 도구는 Apple Neural Engine과 CoreML을 활용해 완전 온디바이스에서 초고속 음성 인식을 지원하며, 클라우드나 계정 없이도 작동한다. macOS 14 이상과 Apple Silicon에서 사용 가능하며, 첫 단어 인식 지연이 300ms 이하로 매우 빠르다. Swift로 네이티브 구현되어 경량화와 빠른 반응성을 제공한다.